您好,登錄后才能下訂單哦!

您好,登錄后才能下訂單哦!

這篇文章主要介紹了Python深度學習神經網絡基本原理的示例分析,具有一定借鑒價值,感興趣的朋友可以參考下,希望大家閱讀完這篇文章之后大有收獲,下面讓小編帶著大家一起了解一下。

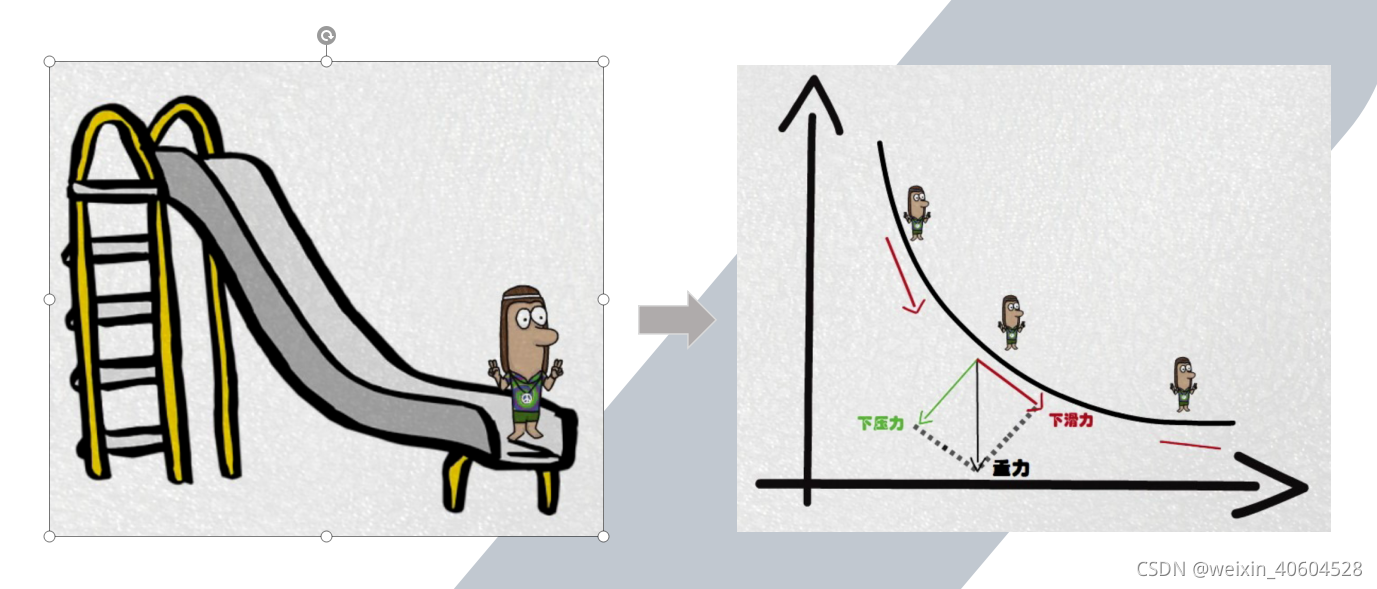

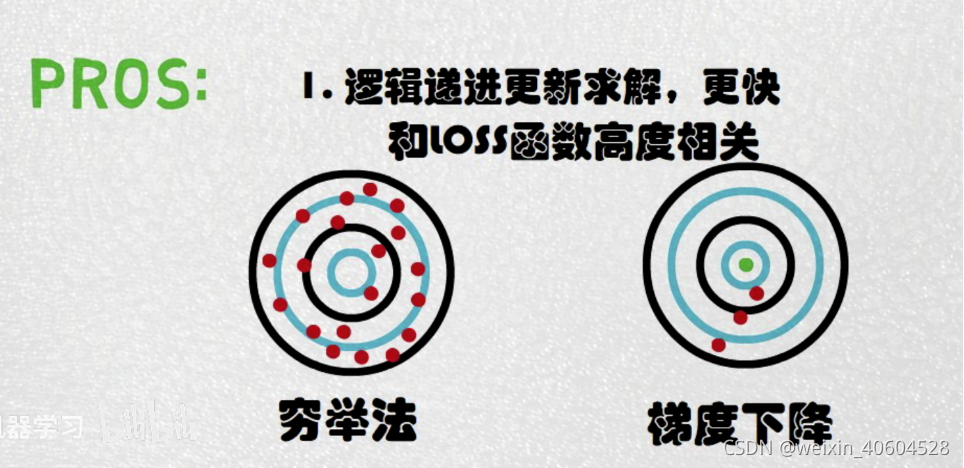

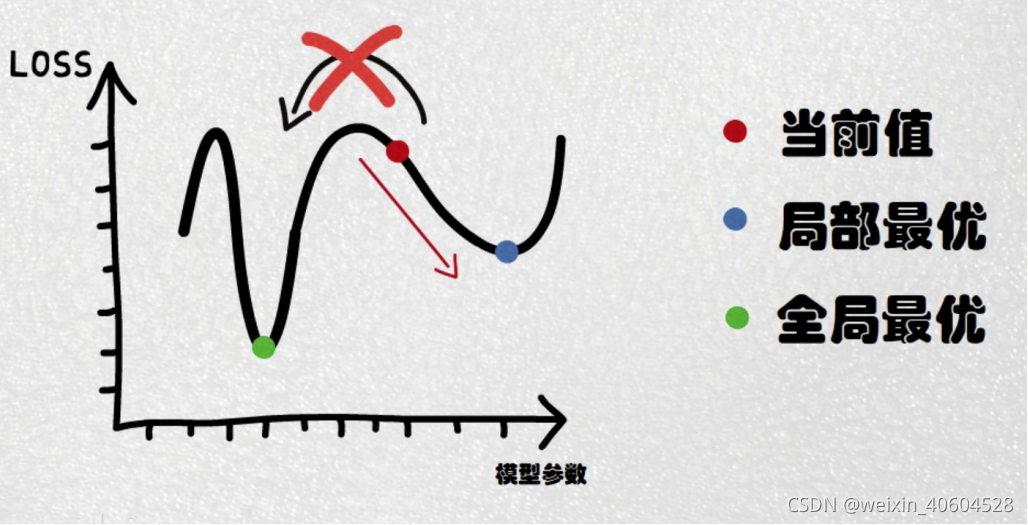

在詳細了解梯度下降的算法之前,我們先看看相關的一些概念。

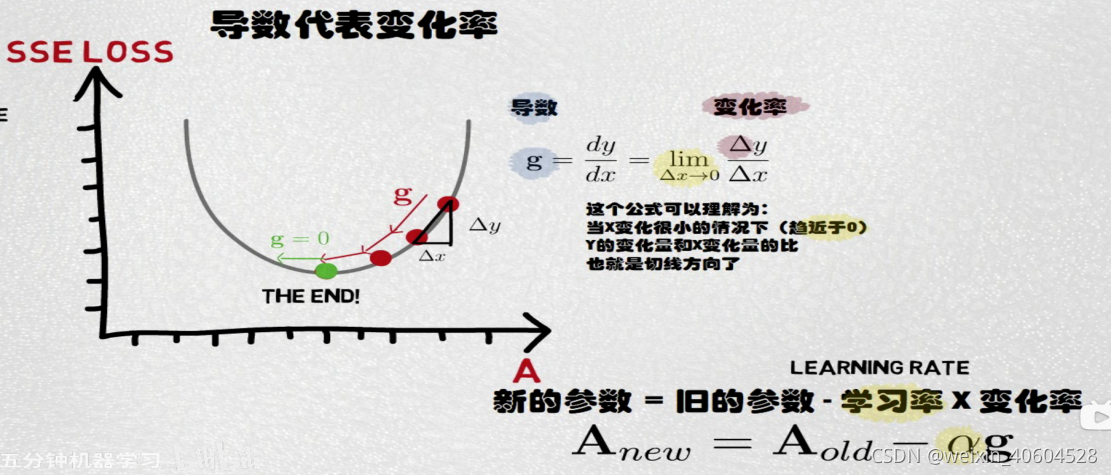

1. 步長(Learning rate):步長決定了在梯度下降迭代的過程中,每一步沿梯度負方向前進的長度。用上面下山的例子,步長就是在當前這一步所在位置沿著最陡峭最易下山的位置走的那一步的長度。

2.特征(feature):指的是樣本中輸入部分,比如2個單特征的樣本(x(0),y(0)),(x(1),y(1))(x(0),y(0)),(x(1),y(1)),則第一個樣本特征為x(0)x(0),第一個樣本輸出為y(0)y(0)。

3. 假設函數(hypothesis function):在監督學習中,為了擬合輸入樣本,而使用的假設函數,記為hθ(x)hθ(x)。比如對于單個特征的m個樣本(x(i),y(i))(i=1,2,...m)(x(i),y(i))(i=1,2,...m),可以采用擬合函數如下: hθ(x)=θ0+θ1xhθ(x)=θ0+θ1x。

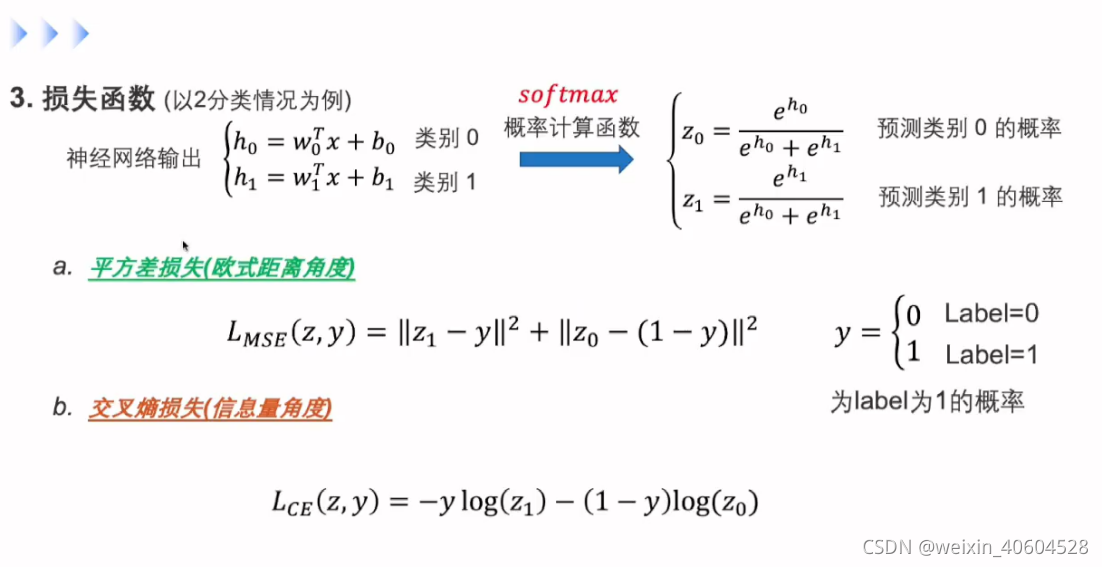

4. 損失函數(loss function):為了評估模型擬合的好壞,通常用損失函數來度量擬合的程度。損失函數極小化,意味著擬合程度最好,對應的模型參數即為最優參數。在線性回歸中,損失函數通常為樣本輸出和假設函數的差取平方。比如對于m個樣本(xi,yi)(i=1,2,...m)(xi,yi)(i=1,2,...m),采用線性回歸,損失函數為:

J(θ0,θ1)=∑i=1m(hθ(xi)?yi)2J(θ0,θ1)=∑i=1m(hθ(xi)?yi)2

其中xixi表示第i個樣本特征,yiyi表示第i個樣本對應的輸出,hθ(xi)hθ(xi)為假設函數。

感謝你能夠認真閱讀完這篇文章,希望小編分享的“Python深度學習神經網絡基本原理的示例分析”這篇文章對大家有幫助,同時也希望大家多多支持億速云,關注億速云行業資訊頻道,更多相關知識等著你來學習!

免責聲明:本站發布的內容(圖片、視頻和文字)以原創、轉載和分享為主,文章觀點不代表本網站立場,如果涉及侵權請聯系站長郵箱:is@yisu.com進行舉報,并提供相關證據,一經查實,將立刻刪除涉嫌侵權內容。