您好,登錄后才能下訂單哦!

您好,登錄后才能下訂單哦!

這篇文章給大家介紹PIFuHD中如何使用AI從2D圖像生成人的3D高分辨率重建,內容非常詳細,感興趣的小伙伴們可以參考借鑒,希望對大家能有所幫助。

首先,讓我們看看他們是如何做到的。

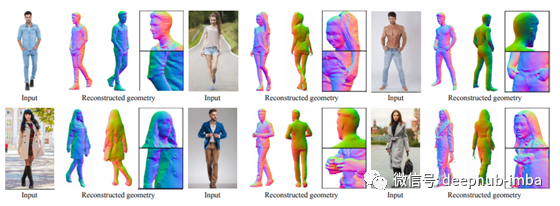

Facebook和南加州大學的研究人員最近推出了一篇名為“ PIFuHD: Multi-Level Pixel-Aligned Implicit Function for High-Resolution 3D Human Digitization”的新論文。簡而言之,它使用某人的2D圖像來重構該人的3D高分辨率版本。我們的主要目標是對穿著衣服的人進行高保真3d重建,并獲得詳細信息,例如手指,面部特征和衣服褶皺,正如我們在此圖中看到的那樣。因為的原因,目前的方法沒有使用全高分辨率圖像,所以它們降低了圖像的尺寸,并丟失了在3D中創建高分辨率細節的重要信息,但是看起來還是不錯的。

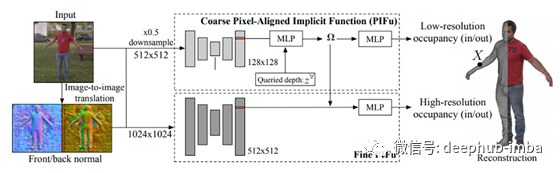

PiFuHD通過兩步解決問題來實現這一目標。首先,以較低的分辨率(縮小比例)對模型進行訓練,以專注于整體推理。這樣,它可以覆蓋圖片的更大空間背景上下文。然后,使用這些上下文信息,模型通過觀察圖像和更高分辨率的第一個輸出來估計人的詳細幾何形狀。粗略層通過對圖像進行下采樣并將其輸入到PIFu模型中來捕獲全局3D結構,而高分辨率的詳細信息是通過在相似的輕量級PIFu網絡中使用這些第一個3D輸出作為高分辨率輸入來添加的。由于精細層級將第一層級的特征作為3d嵌入,因此不需要以更高的分辨率查看整個圖像,從而可以在沒有背景的情況下提供此人的高分辨率圖像。具有較低分辨率的背景信息和較高分辨率的模型解決了先前方法遇到的計算時間問題。

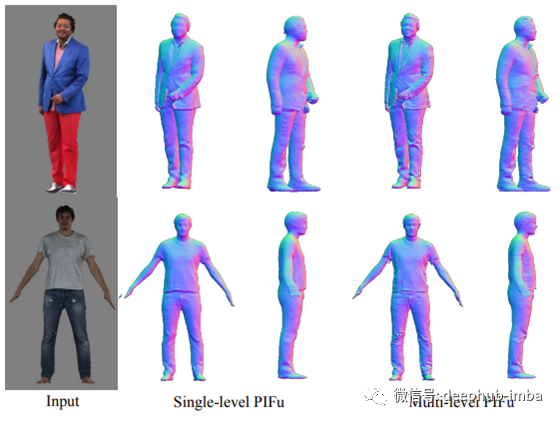

正像圖中展示的,需要多層PIFu才能獲得高分辨率3D模型,但是使用單層PIFu可以更快地創建準確的模型。這種新方法是精確的,并且使用這種雙向模型使它在現階段的內存限制下可以成功運行。下面是使用這種技術取得的一些更令人印象深刻的結果……

他們做了一個公開演示,在那里你可以簡單地上傳你的圖片并在谷歌colab上看到結果!只需要一分鐘左右。

關于PIFuHD中如何使用AI從2D圖像生成人的3D高分辨率重建就分享到這里了,希望以上內容可以對大家有一定的幫助,可以學到更多知識。如果覺得文章不錯,可以把它分享出去讓更多的人看到。

免責聲明:本站發布的內容(圖片、視頻和文字)以原創、轉載和分享為主,文章觀點不代表本網站立場,如果涉及侵權請聯系站長郵箱:is@yisu.com進行舉報,并提供相關證據,一經查實,將立刻刪除涉嫌侵權內容。