您好,登錄后才能下訂單哦!

您好,登錄后才能下訂單哦!

這篇文章將為大家詳細講解有關Python機器學習之AdaBoost算法的示例分析,小編覺得挺實用的,因此分享給大家做個參考,希望大家閱讀完這篇文章后可以有所收獲。

AdaBoost 是英文 Adaptive Boosting(自適應增強)的縮寫,由 Yoav Freund 和Robert Schapire 在1995年提出。

AdaBoost 的自適應在于前一個基本分類器分類錯誤的樣本的權重會得到加強,加強后的全體樣本再次被用來訓練下一個基本分類器。同時,在每一輪訓練中加入一個新的弱分類器,直到達到某個預定的足夠小的錯誤率或達到預先指定的最大迭代次數時停止訓練。

AdaBoost 算法是一種集成學習的算法,其核心思想就是對多個機器學習模型進行組合形成一個精度更高的模型,參與組合的模型稱為弱學習器。

AdaBoost 的核心思想是針對同一訓練集訓練不同的分類器(弱分類器),然后把這些弱分類器集合起來,構成一個更強大的最終分類器(強分類器)。也 就是通過一些手段獲得多個弱分類器,將它們集成起來構成強分類器,綜合所有分類器的預測得出最終的結果。

AdaBoost 算法本身是通過改變數據分布來實現的,它根據每次訓練集中每個樣本的分類是否正確,以及上次的總體分類的準確率,來確定每個樣本的權值。將修改過權值的新數據集送給下層分類器進行訓練,最后將每次訓練得到的分類器最后融合起來,作為最后的決策分類器。

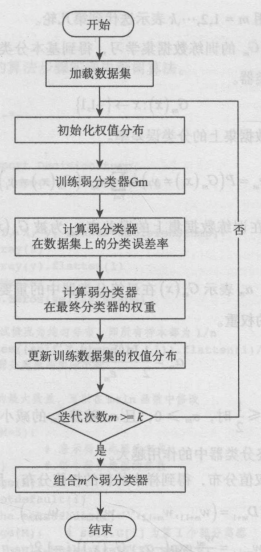

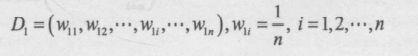

1.初始化訓練數據的權值分布,每一個訓練樣本最開始時都被賦予相同的權值 1/n

2.進行多輪迭代,用 m = 1,2,…,k 表示迭代到第幾輪

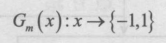

3.使用具有權值分布 Gm 的訓練數據集學習,得到基本分類器

4.計算 Gm(x) 在訓練數據集上的分類誤差率

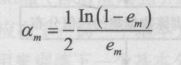

5.計算 Gm(x) 的系數,am表示 Gm(x) 在最終分類器中的重要程度

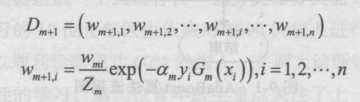

6.更新訓練數據集的權值分布,得到樣本的新的權值分布,用于下一輪迭代

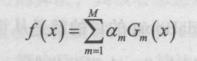

7.組合各個弱分類器

from numpy import *

import matplotlib.pyplot as plt

# 加載數據集

def loadDataSet(fileName):

numFeat = len(open(fileName).readline().split('\t'))

dataMat = []

labelMat = []

fr = open(fileName)

for line in fr.readlines():

lineArr = []

curLine = line.strip().split('\t')

for i in range(numFeat - 1):

lineArr.append(float(curLine[i]))

dataMat.append(lineArr)

labelMat.append(float(curLine[-1]))

return dataMat, labelMat

# 返回分類預測結果 根據閾值所以有兩種返回情況

def stumpClassify(dataMatrix, dimen, threshVal, threshIneq):

retArray = ones((shape(dataMatrix)[0], 1))

if threshIneq == 'lt':

retArray[dataMatrix[:, dimen] <= threshVal] = -1.0

else:

retArray[dataMatrix[:, dimen] > threshVal] = -1.0

return retArray

# 返回 該弱分類器單層決策樹的信息 更新D向量的錯誤率 更新D向量的預測目標

def buildStump(dataArr, classLabels, D):

dataMatrix = mat(dataArr)

labelMat = mat(classLabels).T

m, n = shape(dataMatrix)

numSteps = 10.0

bestStump = {} # 字典用于保存每個分類器信息

bestClasEst = mat(zeros((m, 1)))

minError = inf # 初始化最小誤差最大

for i in range(n): # 特征循環 (三層循環,遍歷所有的可能性)

rangeMin = dataMatrix[:, i].min()

rangeMax = dataMatrix[:, i].max()

stepSize = (rangeMax - rangeMin) / numSteps # (大-小)/分割數 得到最小值到最大值需要的每一段距離

for j in range(-1, int(numSteps) + 1): # 遍歷步長 最小值到最大值的需要次數

for inequal in ['lt', 'gt']: # 在大于和小于之間切換

threshVal = (rangeMin + float(j) * stepSize) # 最小值+次數*步長 每一次從最小值走的長度

predictedVals = stumpClassify(dataMatrix, i, threshVal,

inequal) # 最優預測目標值 用于與目標值比較得到誤差

errArr = mat(ones((m, 1)))

errArr[predictedVals == labelMat] = 0

weightedError = D.T * errArr

if weightedError < minError: # 選出最小錯誤的那個特征

minError = weightedError # 最小誤差 后面用來更新D權值的

bestClasEst = predictedVals.copy() # 最優預測值

bestStump['dim'] = i # 特征

bestStump['thresh'] = threshVal # 到最小值的距離 (得到最優預測值的那個距離)

bestStump['ineq'] = inequal # 大于還是小于 最優距離為-1

return bestStump, minError, bestClasEst

# 循環構建numIt個弱分類器

def adaBoostTrainDS(dataArr, classLabels, numIt=40):

weakClassArr = [] # 保存弱分類器數組

m = shape(dataArr)[0]

D = mat(ones((m, 1)) / m) # D向量 每條樣本所對應的一個權重

aggClassEst = mat(zeros((m, 1))) # 統計類別估計累積值

for i in range(numIt):

bestStump, error, classEst = buildStump(dataArr, classLabels, D)

alpha = float(0.5 * log((1.0 - error) / max(error, 1e-16)))

bestStump['alpha'] = alpha

weakClassArr.append(bestStump) # 加入單層決策樹

# 得到運算公式中的向量+/-α,預測正確為-α,錯誤則+α。每條樣本一個α

# multiply對應位置相乘 這里很聰明,用-1*真實目標值*預測值,實現了錯誤分類則-,正確則+

expon = multiply(-1 * alpha * mat(classLabels).T, classEst)

D = multiply(D, exp(expon)) # 這三步為更新概率分布D向量 拆分開來了,每一步與公式相同

D = D / D.sum()

# 計算停止條件錯誤率=0 以及計算每次的aggClassEst類別估計累計值

aggClassEst += alpha * classEst

# 很聰明的計算方法 計算得到錯誤的個數,向量中為1則錯誤值

aggErrors = multiply(sign(aggClassEst) != mat(classLabels).T, ones((m, 1))) # sign返回數值的正負符號,以1、-1表示

errorRate = aggErrors.sum() / m # 錯誤個數/總個數

# print("錯誤率:", errorRate)

if errorRate == 0.0:

break

return weakClassArr, aggClassEst

# 預測 累加 多個弱分類器獲得預測值*該alpha 得到結果

def adaClassify(datToClass, classifierArr): # classifierArr是元組,所以在取值時需要注意

dataMatrix = mat(datToClass)

m = shape(dataMatrix)[0]

aggClassEst = mat(zeros((m, 1)))

# 循環所有弱分類器

for i in range(len(classifierArr[0])):

# 獲得預測結果

classEst = stumpClassify(dataMatrix, classifierArr[0][i]['dim'], classifierArr[0][i]['thresh'],

classifierArr[0][i]['ineq'])

# 該分類器α*預測結果 用于累加得到最終的正負判斷條件

aggClassEst += classifierArr[0][i]['alpha'] * classEst # 這里就是集合所有弱分類器的意見,得到最終的意見

return sign(aggClassEst) # 提取數據符號

# ROC曲線,類別累計值、目標標簽

def plotROC(predStrengths, classLabels):

cur = (1.0, 1.0) # 每次畫線的起點游標點

ySum = 0.0 # 用于計算AUC的值 矩形面積的高度累計值

numPosClas = sum(array(classLabels) == 1.0) # 所有真實正例 確定了在y坐標軸上的步進數目

yStep = 1 / float(numPosClas) # 1/所有真實正例 y軸上的步長

xStep = 1 / float(len(classLabels) - numPosClas) # 1/所有真實反例 x軸上的步長

sortedIndicies = predStrengths.argsort() # 獲得累計值向量從小到大排序的下表index [50,88,2,71...]

fig = plt.figure()

fig.clf()

ax = plt.subplot(111)

# 循環所有的累計值 從小到大

for index in sortedIndicies.tolist()[0]:

if classLabels[index] == 1.0:

delX = 0 # 若為一個真正例,則沿y降一個步長,即不斷降低真陽率;

delY = yStep # 若為一個非真正例,則沿x退一個步長,尖笑陽率

else:

delX = xStep

delY = 0

ySum += cur[1] # 向下移動一次,則累計一個高度。寬度不變,我們只計算高度

ax.plot([cur[0], cur[0] - delX], [cur[1], cur[1] - delY], c='b') # 始終會有一個點是沒有改變的

cur = (cur[0] - delX, cur[1] - delY)

ax.plot([0, 1], [0, 1], 'b--')

plt.xlabel('False positive rate')

plt.ylabel('True positive rate')

plt.title('ROC curve for AdaBoost horse colic detection system')

ax.axis([0, 1, 0, 1])

plt.show()

print("the Area Under the Curve is: ", ySum * xStep) # AUC面積我們以 高*低 的矩形來計算

# 測試正確率

datArr, labelArr = loadDataSet('horseColicTraining2.txt')

classifierArr = adaBoostTrainDS(datArr, labelArr, 15)

testArr, testLabelArr = loadDataSet('horseColicTest2.txt')

prediction10 = adaClassify(testArr, classifierArr)

errArr = mat(ones((67, 1))) # 一共有67個樣本

cnt = errArr[prediction10 != mat(testLabelArr).T].sum()

print(cnt / 67)

# 畫出ROC曲線

datArr, labelArr = loadDataSet('horseColicTraining2.txt')

classifierArray, aggClassEst = adaBoostTrainDS(datArr, labelArr, 10)

plotROC(aggClassEst.T, labelArr)權值更新方法的改進

在實際訓練過程中可能存在正負樣本失衡的問題,分類器會過于關注大容量樣本,導致分類器不能較好地完成區分小樣本的目的。此時可以適度增大小樣本的權重使重心達到平衡。在實際訓練中還會出現困難樣本權重過高而發生過擬合的問題,因此有必要設置困難樣本分類的權值上限。

訓練方法的改進

AdaBoost算法由于其多次迭代訓練分類器的原因,訓練時間一般會比別的分類器長。對此一般可以采用實現AdaBoost的并行計算或者訓練過程中動態剔除掉權重偏小的樣本以加速訓練過程。

多算法結合的改進

除了以上算法外,AdaBoost還可以考慮與其它算法結合產生新的算法,如在訓練過程中使用SVM算法加速挑選簡單分類器來替代原始AdaBoost中的窮舉法挑選簡單的分類器。

python的五大特點:1.簡單易學,開發程序時,專注的是解決問題,而不是搞明白語言本身。2.面向對象,與其他主要的語言如C++和Java相比, Python以一種非常強大又簡單的方式實現面向對象編程。3.可移植性,Python程序無需修改就可以在各種平臺上運行。4.解釋性,Python語言寫的程序不需要編譯成二進制代碼,可以直接從源代碼運行程序。5.開源,Python是 FLOSS(自由/開放源碼軟件)之一。

關于“Python機器學習之AdaBoost算法的示例分析”這篇文章就分享到這里了,希望以上內容可以對大家有一定的幫助,使各位可以學到更多知識,如果覺得文章不錯,請把它分享出去讓更多的人看到。

免責聲明:本站發布的內容(圖片、視頻和文字)以原創、轉載和分享為主,文章觀點不代表本網站立場,如果涉及侵權請聯系站長郵箱:is@yisu.com進行舉報,并提供相關證據,一經查實,將立刻刪除涉嫌侵權內容。