您好,登錄后才能下訂單哦!

您好,登錄后才能下訂單哦!

這篇文章主要介紹python如何爬取壁紙網站,文中介紹的非常詳細,具有一定的參考價值,感興趣的小伙伴們一定要看完!

本次爬蟲用到的網址是:

http://www.netbian.com/index.htm: 彼岸桌面.里面有很多的好看壁紙,而且都是可以下載高清無損的,還比較不錯,所以我就拿這個網站練練手。

作為一個初學者,剛開始的時候,無論的代碼的質量如何,總之代碼只要能夠被正確完整的運行那就很能夠讓自己開心的,如同我們的游戲一樣,能在短時間內得到正向的反饋,我們就會更有興趣去玩。

學習也是如此,只要我們能夠在短期內得到學習帶來的反饋,那么我們的對于學習的欲望也是強烈的。

作為一個菜雞,能夠完整的完整此次爬蟲程序的編寫,那便是一個最大的收貨,但其實我在此次過程中的收獲遠不止此。

好的代碼其實應該具有以下特性

能夠滿足最關鍵的需求

容易理解

有充分的注釋

使用規范的命名

沒有明顯的安全問題

經過充分的測試

就以充分的測試為例,經常寫代碼的就應該知道,盡管多數時候你的代碼沒有BUG,但那僅僅說明只是大多數情況下是穩定的,但是在某些條件下就會出錯(達到出錯條件,存在邏輯問題的時候等)。這是肯定的。至于什么原因,不同的代碼有不同的原因。如果代碼程序都是一次就能完善的,那么我們使用的軟件的軟件就不會經常更新了。其他其中的道理就不一 一道說了,

久而自知

好的代碼一般具有的5大特性

1.便于維護

2.可復用

3.可擴展

4.強靈活性

5.健壯性

經過我的代碼運行我發現時間復雜度比較大,因此這是我將要改進的地方,但也不止于此。也有很多利用得不合理的地方,至于存在的不足的地方就待我慢慢提升改進吧!

路過的大佬歡迎留下您寶貴的代碼修改意見,

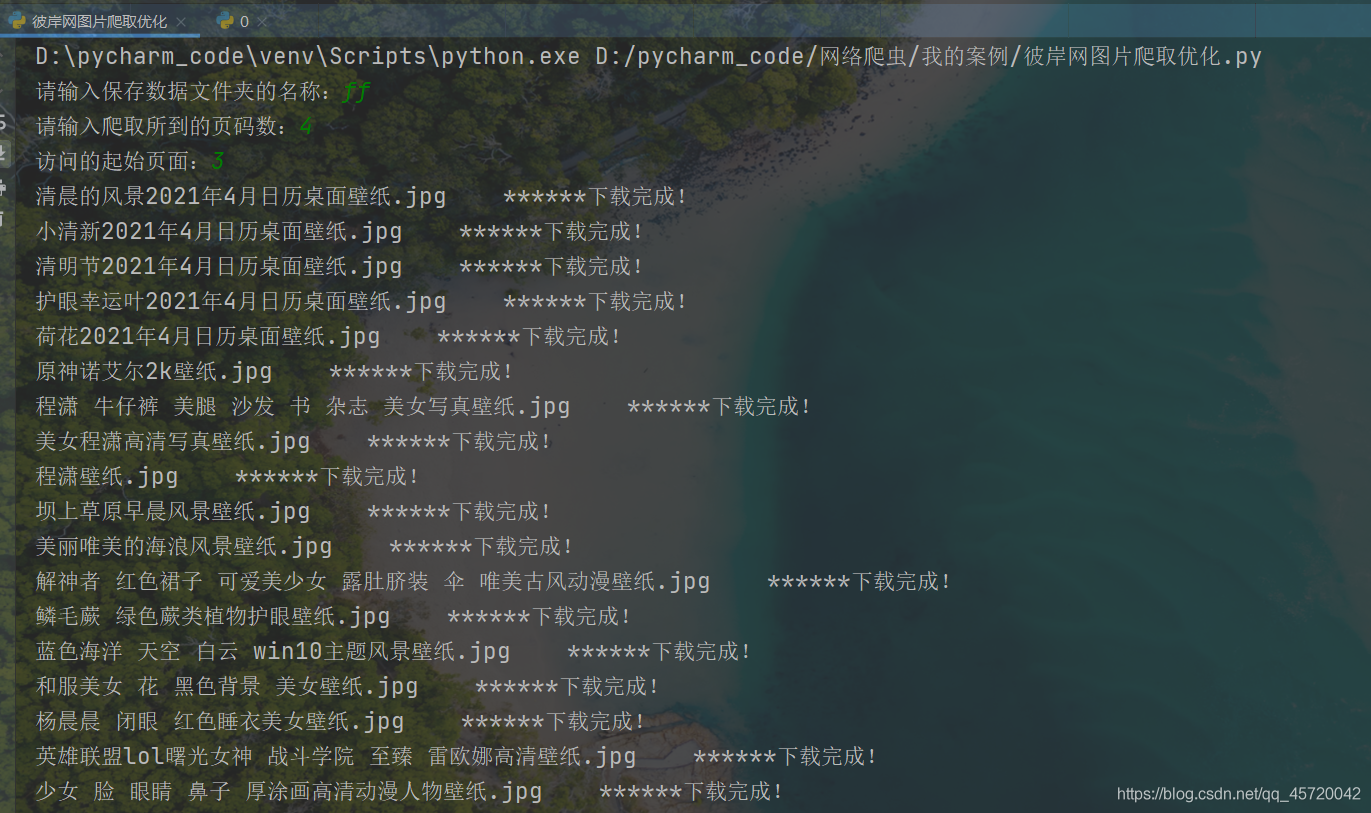

import os import bs4 import re import time import requests from bs4 import BeautifulSoup def getHTMLText(url, headers): """向目標服務器發起請求并返回響應""" try: r = requests.get(url=url, headers=headers) r.encoding = r.apparent_encoding soup = BeautifulSoup(r.text, "html.parser") return soup except: return "" def CreateFolder(): """創建存儲數據文件夾""" flag = True while flag == 1: file = input("請輸入保存數據文件夾的名稱:") if not os.path.exists(file): os.mkdir(file) flag = False else: print('該文件已存在,請重新輸入') flag = True # os.path.abspath(file) 獲取文件夾的絕對路徑 path = os.path.abspath(file) + "\\" return path def fillUnivList(ulist, soup): """獲取每一張圖片的原圖頁面""" # [0]使得獲得的ul是 <class 'bs4.BeautifulSoup'> 類型 div = soup.find_all('div', 'list')[0] for a in div('a'): if isinstance(a, bs4.element.Tag): hr = a.attrs['href'] href = re.findall(r'/desk/[1-9]\d{4}.htm', hr) if bool(href) == True: ulist.append(href[0]) return ulist def DownloadPicture(left_url,list,path): for right in list: url = left_url + right r = requests.get(url=url, timeout=10) r.encoding = r.apparent_encoding soup = BeautifulSoup(r.text,"html.parser") tag = soup.find_all("p") # 獲取img標簽的alt屬性,給保存圖片命名 name = tag[0].a.img.attrs['alt'] img_name = name + ".jpg" # 獲取圖片的信息 img_src = tag[0].a.img.attrs['src'] try: img_data = requests.get(url=img_src) except: continue img_path = path + img_name with open(img_path,'wb') as fp: fp.write(img_data.content) print(img_name, " ******下載完成!") def PageNumurl(urls): num = int(input("請輸入爬取所到的頁碼數:")) for i in range(2,num+1): u = "http://www.netbian.com/index_" + str(i) + ".htm" urls.append(u) return urls if __name__ == "__main__": uinfo = [] left_url = "http://www.netbian.com" urls = ["http://www.netbian.com/index.htm"] headers = { "User-Agent": "Mozilla/5.0 (Windows NT 10.0; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/89.0.4389.90 Safari/537.36" } start = time.time() # 1.創建保存數據的文件夾 path = CreateFolder() # 2. 確定要爬取的頁面數并返回每一頁的鏈接 PageNumurl(urls) n = int(input("訪問的起始頁面:")) for i in urls[n-1:]: # 3.獲取每一個頁面的首頁數據文本 soup = getHTMLText(i, headers) # 4.訪問原圖所在頁鏈接并返回圖片的鏈接 page_list = fillUnivList(uinfo, soup) # 5.下載原圖 DownloadPicture(left_url, page_list, path) print("全部下載完成!", "共" + str(len(os.listdir(path))) + "張圖片") end = time.time() print("共耗時" + str(end-start) + "秒")

以上是“python如何爬取壁紙網站”這篇文章的所有內容,感謝各位的閱讀!希望分享的內容對大家有幫助,更多相關知識,歡迎關注億速云行業資訊頻道!

免責聲明:本站發布的內容(圖片、視頻和文字)以原創、轉載和分享為主,文章觀點不代表本網站立場,如果涉及侵權請聯系站長郵箱:is@yisu.com進行舉報,并提供相關證據,一經查實,將立刻刪除涉嫌侵權內容。