您好,登錄后才能下訂單哦!

您好,登錄后才能下訂單哦!

前幾天,楊超越編程大賽火了,大家都在報名參加,而我也是其中的一員。

在我們的項目中,我負責的是數據爬取這塊,我主要是把對于楊超越 的每一條評論的相關信息。

數據格式:{"name":評論人姓名,"comment_time":評論時間,"comment_info":評論內容,"comment_url":評論人的主頁}

以上就是我們需要的信息。

爬蟲前的分析:

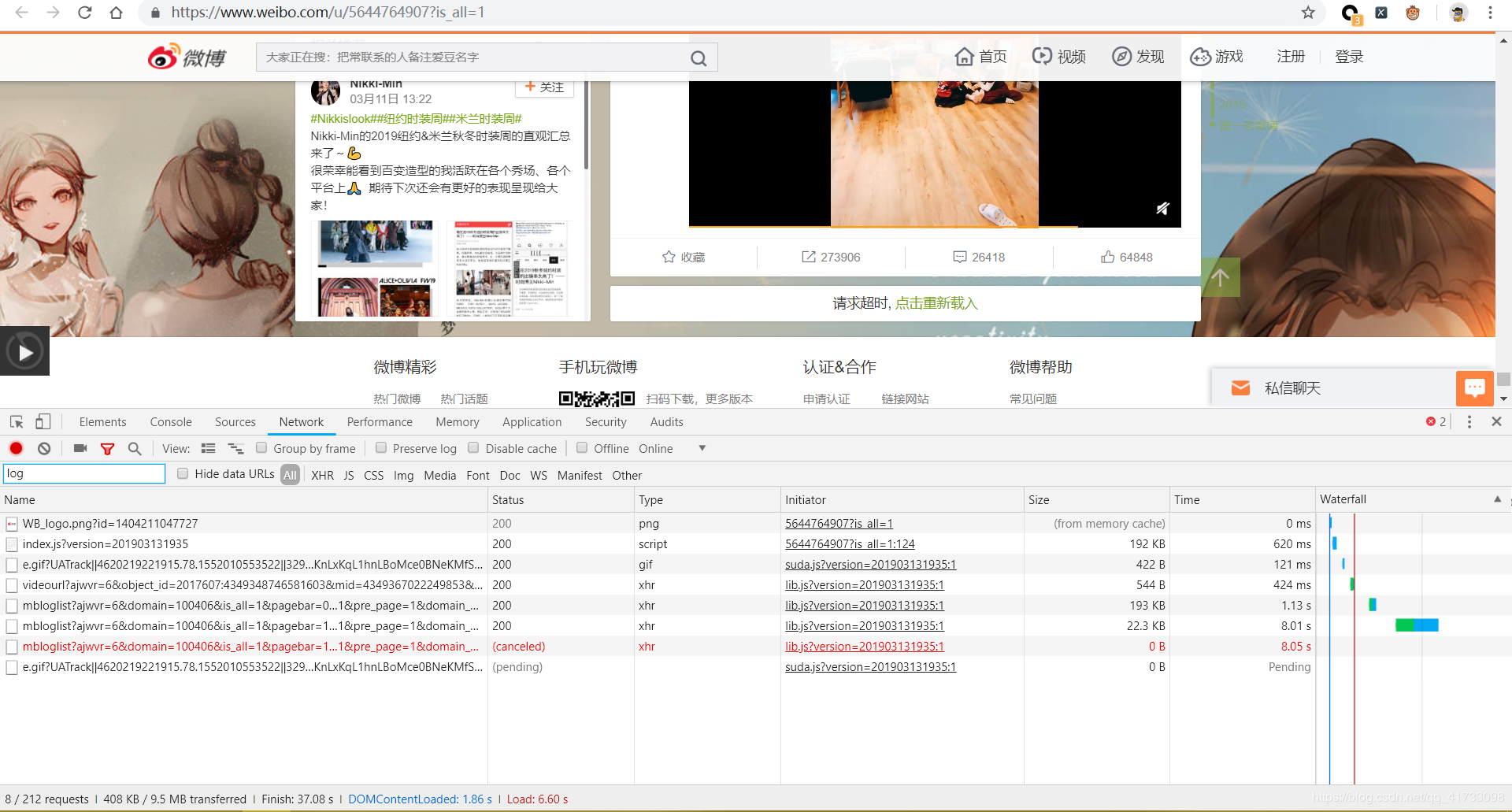

以上是楊超越的微博主頁,這是我們首先需要獲取到的內容。

因為我們需要等到這個主頁內這些微博詳情頁 的鏈接,但是我們向下刷新,會發現微博的主頁信息是ajax動態加載出來的,

這張圖片就是我們向下刷新獲取到 的新的鏈接,這個就是我們需要獲取到的信息頁面信息。

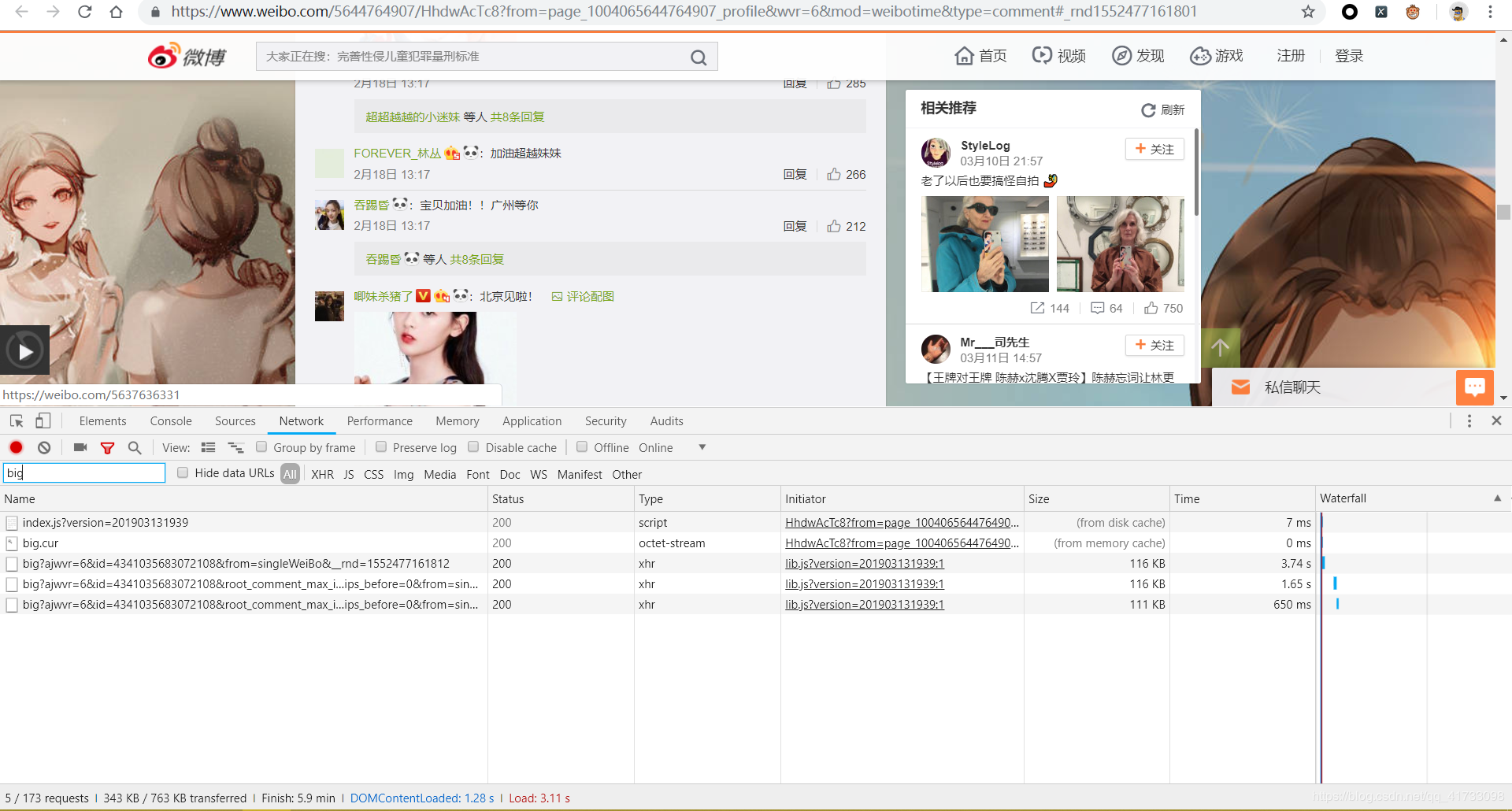

接下來 就是獲取詳情頁面的信息,詳情頁中含有評論的相關信息,通過向下刷新,我們也會發現,相關的評論信息也是通過ajax加載出來的 ,

ok,以上就是我們針對整個流程大致的一個分析過程。

具體操作流程:

我們首相將主頁獲取完成以后,我們就會發現,其中 的內容帶有相關的反爬措施,獲取到的源碼中的信息含有很多的轉義符“\”,并且其中的相關“<”和“>”是通過html的語言直接編寫的,這樣會導致我們的頁面解析出現一定的問題,我們可以用replace方法直接將這些轉義符全部去掉,然后我們就可以對這個頁面進行正則處理,同時我也嘗試過用其他的解析方法,但是其中遇到了很多 的問題,所以我就不過多的介紹了。

當我們獲取到了每一篇微博的鏈接以后,還需要獲取一個很關鍵的值 id ,這個值有什么用呢,其主要的作用就是在評論頁面的ajax頁面的拼接地址上需要使用到。接下來就是需要尋找出我們找到的這兩個ajax的url有什么特點或者是規律:

當我們從這些ajax中找到規律以后,不難發現,這個爬蟲差不多大功告成了。

下面我就展示一下我的代碼:

注意:請在headers中添加自己的cookie

# -*- coding: utf-8 -*-

# Created : 2018/8/26 18:33

# author :GuoLi

import requests

import json

import time

from lxml import etree

import html

import re

from bs4 import BeautifulSoup

class Weibospider:

def __init__(self):

# 獲取首頁的相關信息:

self.start_url = 'https://weibo.com/u/5644764907?page=1&is_all=1'

self.headers = {

"accept": "text/html,application/xhtml+xml,application/xml;q=0.9,image/webp,image/apng,*/*;q=0.8",

"accept-encoding": "gzip, deflate, br",

"accept-language": "zh-CN,zh;q=0.9,en;q=0.8",

"cache-control": "max-age=0",

"cookie": 使用自己本機的cookie,

"referer": "https://www.weibo.com/u/5644764907?topnav=1&wvr=6&topsug=1",

"upgrade-insecure-requests": "1",

"user-agent": "Mozilla/5.0 (Windows NT 10.0; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/72.0.3626.96 Safari/537.36",

}

self.proxy = {

'HTTP': 'HTTP://180.125.70.78:9999',

'HTTP': 'HTTP://117.90.4.230:9999',

'HTTP': 'HTTP://111.77.196.229:9999',

'HTTP': 'HTTP://111.177.183.57:9999',

'HTTP': 'HTTP://123.55.98.146:9999',

}

def parse_home_url(self, url): # 處理解析首頁面的詳細信息(不包括兩個通過ajax獲取到的頁面)

res = requests.get(url, headers=self.headers)

response = res.content.decode().replace("\\", "")

# every_url = re.compile('target="_blank" href="(/\d+/\w+\?from=\w+&wvr=6&mod=weibotime)" rel="external nofollow" ', re.S).findall(response)

every_id = re.compile('name=(\d+)', re.S).findall(response) # 獲取次級頁面需要的id

home_url = []

for id in every_id:

base_url = 'https://weibo.com/aj/v6/comment/big?ajwvr=6&id={}&from=singleWeiBo'

url = base_url.format(id)

home_url.append(url)

return home_url

def parse_comment_info(self, url): # 爬取直接發表評論的人的相關信息(name,info,time,info_url)

res = requests.get(url, headers=self.headers)

response = res.json()

count = response['data']['count']

html = etree.HTML(response['data']['html'])

name = html.xpath("http://div[@class='list_li S_line1 clearfix']/div[@class='WB_face W_fl']/a/img/@alt") # 評論人的姓名

info = html.xpath("http://div[@node-type='replywrap']/div[@class='WB_text']/text()") # 評論信息

info = "".join(info).replace(" ", "").split("\n")

info.pop(0)

comment_time = html.xpath("http://div[@class='WB_from S_txt2']/text()") # 評論時間

name_url = html.xpath("http://div[@class='WB_face W_fl']/a/@href") # 評論人的url

name_url = ["https:" + i for i in name_url]

comment_info_list = []

for i in range(len(name)):

item = {}

item["name"] = name[i] # 存儲評論人的網名

item["comment_info"] = info[i] # 存儲評論的信息

item["comment_time"] = comment_time[i] # 存儲評論時間

item["comment_url"] = name_url[i] # 存儲評論人的相關主頁

comment_info_list.append(item)

return count, comment_info_list

def write_file(self, path_name, content_list):

for content in content_list:

with open(path_name, "a", encoding="UTF-8") as f:

f.write(json.dumps(content, ensure_ascii=False))

f.write("\n")

def run(self):

start_url = 'https://weibo.com/u/5644764907?page={}&is_all=1'

start_ajax_url1 = 'https://weibo.com/p/aj/v6/mblog/mbloglist?ajwvr=6&domain=100406&is_all=1&page={0}&pagebar=0&pl_name=Pl_Official_MyProfileFeed__20&id=1004065644764907&script_uri=/u/5644764907&pre_page={0}'

start_ajax_url2 = 'https://weibo.com/p/aj/v6/mblog/mbloglist?ajwvr=6&domain=100406&is_all=1&page={0}&pagebar=1&pl_name=Pl_Official_MyProfileFeed__20&id=1004065644764907&script_uri=/u/5644764907&pre_page={0}'

for i in range(12): # 微博共有12頁

home_url = self.parse_home_url(start_url.format(i + 1)) # 獲取每一頁的微博

ajax_url1 = self.parse_home_url(start_ajax_url1.format(i + 1)) # ajax加載頁面的微博

ajax_url2 = self.parse_home_url(start_ajax_url2.format(i + 1)) # ajax第二頁加載頁面的微博

all_url = home_url + ajax_url1 + ajax_url2

for j in range(len(all_url)):

print(all_url[j])

path_name = "第{}條微博相關評論.txt".format(i * 45 + j + 1)

all_count, comment_info_list = self.parse_comment_info(all_url[j])

self.write_file(path_name, comment_info_list)

for num in range(1, 10000):

if num * 15 < int(all_count) + 15:

comment_url = all_url[j] + "&page={}".format(num + 1)

print(comment_url)

try:

count, comment_info_list = self.parse_comment_info(comment_url)

self.write_file(path_name, comment_info_list)

except Exception as e:

print("Error:", e)

time.sleep(60)

count, comment_info_list = self.parse_comment_info(comment_url)

self.write_file(path_name, comment_info_list)

del count

time.sleep(0.2)

print("第{}微博信息獲取完成!".format(i * 45 + j + 1))

if __name__ == '__main__':

weibo = Weibospider()

weibo.run()

以上所述是小編給大家介紹的python爬蟲爬取微博評論詳解整合,希望對大家有所幫助,如果大家有任何疑問請給我留言,小編會及時回復大家的。在此也非常感謝大家對億速云網站的支持!

免責聲明:本站發布的內容(圖片、視頻和文字)以原創、轉載和分享為主,文章觀點不代表本網站立場,如果涉及侵權請聯系站長郵箱:is@yisu.com進行舉報,并提供相關證據,一經查實,將立刻刪除涉嫌侵權內容。