溫馨提示×

您好,登錄后才能下訂單哦!

點擊 登錄注冊 即表示同意《億速云用戶服務條款》

您好,登錄后才能下訂單哦!

本文實例為大家分享了Tensorflow酸奶銷量預測分析的具體代碼,供大家參考,具體內容如下

# coding:utf-8

# 酸奶成本為1元,利潤為9元

# 預測少了相應的損失較大,故不要預測少

# 導入相應的模塊

import tensorflow as tf

import numpy as np

import matplotlib.pyplot as plt

BATCH_SIZE=8

SEED=23455

COST=3

PROFIT=4

rdm=np.random.RandomState(SEED)

X=rdm.randn(100,2)

Y_=[[x1+x2+(rdm.rand()/10.0-0.05)] for (x1,x2) in X]

# 定義神經網絡的輸入、參數和輸出,定義向前傳播過程

x=tf.placeholder(tf.float32,shape=(None,2))

y_=tf.placeholder(tf.float32,shape=(None,1))

w1=tf.Variable(tf.random_normal([2,1],stddev=1,seed=1))

y=tf.matmul(x,w1)

# 定義損失函數和反向傳播過程

loss=tf.reduce_sum(tf.where(tf.greater(y,y_),(y-y_)*COST,(y_-y)*PROFIT)) #損失函數要根據不同的模型進行變換

train_step=tf.train.GradientDescentOptimizer(0.001).minimize(loss)

# sess=tf.Session()

# STEPS=20000

# init_op=tf.global_variables_initializer()

# sess.run(init_op)

# for i in range(STEPS):

# start=(i*BATCH_SIZE)%32

# end=start+BATCH_SIZE

# sess.run(train_step,feed_dict={x:X[start:end],y_:Y[start:end]})

# if i%500==0:

#

# print("After %d steps,w1 is %f",(i,sess.run(w1)))

sess=tf.Session()

init_op=tf.global_variables_initializer()

sess.run(init_op)

STEPS=20000

for i in range(STEPS):

start=(i*BATCH_SIZE)%100

end=start+BATCH_SIZE

sess.run(train_step,feed_dict={x:X[start:end],y_:Y_[start:end]})

if i%500==0:

print("After %d steps"%(i))

# print(sess.run(loss_mse))

# print("Loss is:%f",sess.run(loss_mse,feed_dict={y_:Y_,y:Y_}))

print("w1 is:",sess.run(w1))

print("Final is :",sess.run(w1))

xx,yy=np.mgrid[-3:3:.01,-3:3:.01]

grid=np.c_[xx.ravel(),yy.ravel()]

probs=sess.run(y,feed_dict={x:grid})

probs=probs.reshape(xx.shape)

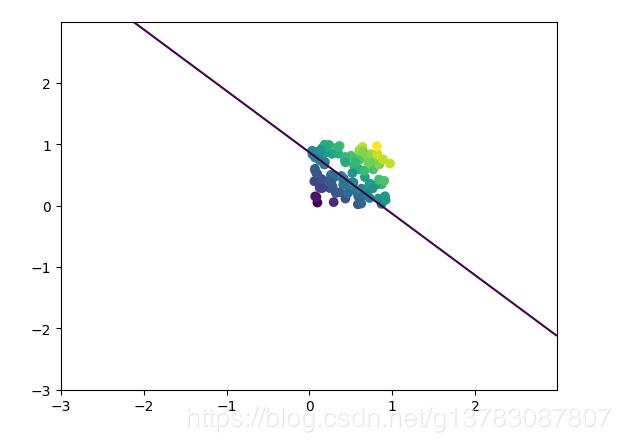

plt.scatter(X[:,0],X[:,1],c=np.squeeze(Y_))

plt.contour(xx,yy,probs,[.9])

plt.show()

通過改變COST和PROFIT的值近而可以得出,當COST=1,PROFIT=9時,基于損失函數,模型的w1=1.02,w2=1.03說明模型會往多了預測;當COST=9,PROFIT=1時模型的w1=0.96,w2=0.97說明模型在往少了預測。

以上就是本文的全部內容,希望對大家的學習有所幫助,也希望大家多多支持億速云。

免責聲明:本站發布的內容(圖片、視頻和文字)以原創、轉載和分享為主,文章觀點不代表本網站立場,如果涉及侵權請聯系站長郵箱:is@yisu.com進行舉報,并提供相關證據,一經查實,將立刻刪除涉嫌侵權內容。