您好,登錄后才能下訂單哦!

您好,登錄后才能下訂單哦!

這篇文章主要講解了“Apache Avro數據怎么生成”,文中的講解內容簡單清晰,易于學習與理解,下面請大家跟著小編的思路慢慢深入,一起來研究和學習“Apache Avro數據怎么生成”吧!

avro是一個數據序列化系統

提供了:

豐富的數據結構

緊湊的,快速的,二進制的數據格式

一種文件格式,用于存儲持久化數據

遠程過程調用系統(RPC)

和動態語言的簡單交互。并不需要為數據文件讀寫產生代碼,也不需要使用或實現RPC協議。代碼生成是一種優化方式,但是只對于靜態語言有意義。

隨著互聯網高速的發展,云計算、大數據、人工智能AI、物聯網等前沿技術已然成為當今時代主流的高新技術,諸如電商網站、人臉識別、無人駕駛、智能家居、智慧城市等等,不僅方面方便了人們的衣食住行,背后更是時時刻刻有大量的數據在經過各種各樣的系統平臺的采集、清晰、分析,而保證數據的低時延、高吞吐、安全性就顯得尤為重要,Apache Avro本身通過Schema的方式序列化后進行二進制傳輸,一方面保證了數據的高速傳輸,另一方面保證了數據安全性,avro當前在各個行業的應用越來越廣泛,如何對avro數據進行處理解析應用就格外重要,本文將演示如果序列化生成avro數據,并使用FlinkSQL進行解析。

本文是avro解析的demo,當前FlinkSQL僅適用于簡單的avro數據解析,復雜嵌套avro數據暫時不支持。

本文主要介紹以下三個重點內容:

如何序列化生成Avro數據

如何反序列化解析Avro數據

如何使用FlinkSQL解析Avro數據

了解avro是什么,可參考apache avro官網快速入門指南

了解avro應用場景

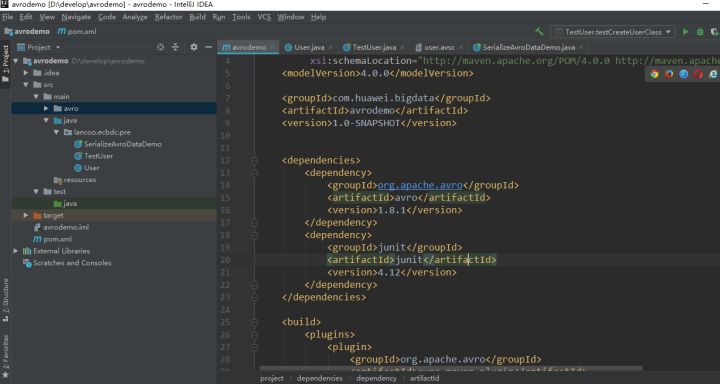

1、新建avro maven工程項目,配置pom依賴

pom文件內容如下:

<?xml version="1.0" encoding="UTF-8"?>

<project xmlns="http://maven.apache.org/POM/4.0.0"

xmlns:xsi="http://www.w3.org/2001/XMLSchema-instance"

xsi:schemaLocation="http://maven.apache.org/POM/4.0.0 http://maven.apache.org/xsd/maven-4.0.0.xsd">

<modelVersion>4.0.0</modelVersion>

<groupId>com.huawei.bigdata</groupId>

<artifactId>avrodemo</artifactId>

<version>1.0-SNAPSHOT</version>

<dependencies>

<dependency>

<groupId>org.apache.avro</groupId>

<artifactId>avro</artifactId>

<version>1.8.1</version>

</dependency>

<dependency>

<groupId>junit</groupId>

<artifactId>junit</artifactId>

<version>4.12</version>

</dependency>

</dependencies>

<build>

<plugins>

<plugin>

<groupId>org.apache.avro</groupId>

<artifactId>avro-maven-plugin</artifactId>

<version>1.8.1</version>

<executions>

<execution>

<phase>generate-sources</phase>

<goals>

<goal>schema</goal>

</goals>

<configuration>

<sourceDirectory>${project.basedir}/src/main/avro/</sourceDirectory>

<outputDirectory>${project.basedir}/src/main/java/</outputDirectory>

</configuration>

</execution>

</executions>

</plugin>

<plugin>

<groupId>org.apache.maven.plugins</groupId>

<artifactId>maven-compiler-plugin</artifactId>

<configuration>

<source>1.6</source>

<target>1.6</target>

</configuration>

</plugin>

</plugins>

</build>

</project>注意:以上pom文件配置了自動生成類的路徑,即${project.basedir}/src/main/avro/和${project.basedir}/src/main/java/,這樣配置之后,在執行mvn命令的時候,這個插件就會自動將此目錄下的avsc schema生成類文件,并放到后者這個目錄下。如果沒有生成avro目錄,手動創建一下即可。

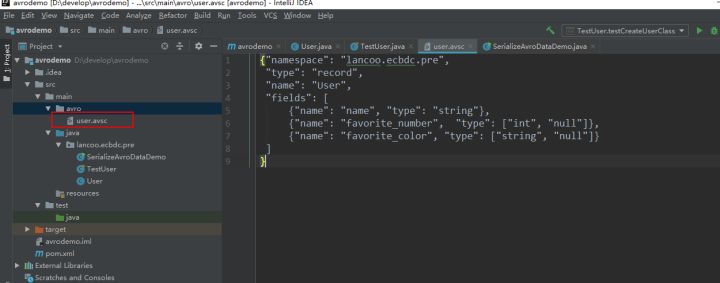

2、定義schema

使用JSON為Avro定義schema。schema由基本類型(null,boolean, int, long, float, double, bytes 和string)和復雜類型(record, enum, array, map, union, 和fixed)組成。例如,以下定義一個user的schema,在main目錄下創建一個avro目錄,然后在avro目錄下新建文件 user.avsc :

{"namespace": "lancoo.ecbdc.pre",

"type": "record",

"name": "User",

"fields": [

{"name": "name", "type": "string"},

{"name": "favorite_number", "type": ["int", "null"]},

{"name": "favorite_color", "type": ["string", "null"]}

]

}

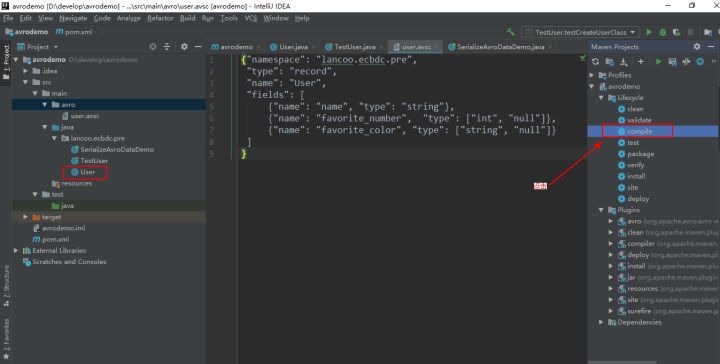

3、編譯schema

點擊maven projects項目的compile進行編譯,會自動在創建namespace路徑和User類代碼

4、序列化

創建TestUser類,用于序列化生成數據

User user1 = new User();

user1.setName("Alyssa");

user1.setFavoriteNumber(256);

// Leave favorite col or null

// Alternate constructor

User user2 = new User("Ben", 7, "red");

// Construct via builder

User user3 = User.newBuilder()

.setName("Charlie")

.setFavoriteColor("blue")

.setFavoriteNumber(null)

.build();

// Serialize user1, user2 and user3 to disk

DatumWriter<User> userDatumWriter = new SpecificDatumWriter<User>(User.class);

DataFileWriter<User> dataFileWriter = new DataFileWriter<User>(userDatumWriter);

dataFileWriter.create(user1.getSchema(), new File("user_generic.avro"));

dataFileWriter.append(user1);

dataFileWriter.append(user2);

dataFileWriter.append(user3);

dataFileWriter.close();執行序列化程序后,會在項目的同級目錄下生成avro數據

user_generic.avro內容如下:

Objavro.schema?{"type":"record","name":"User","namespace":"lancoo.ecbdc.pre","fields":[{"name":"name","type":"string"},{"name":"favorite_number","type":["int","null"]},{"name":"favorite_color","type":["string","null"]}]}

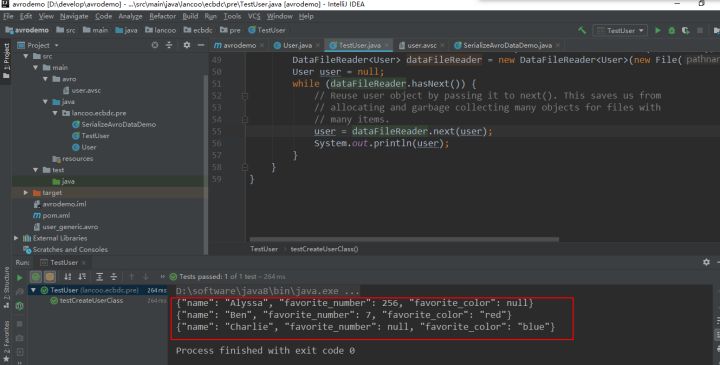

5、反序列化

通過反序列化代碼解析avro數據

// Deserialize Users from disk

DatumReader<User> userDatumReader = new SpecificDatumReader<User>(User.class);

DataFileReader<User> dataFileReader = new DataFileReader<User>(new File("user_generic.avro"), userDatumReader);

User user = null;

while (dataFileReader.hasNext()) {

// Reuse user object by passing it to next(). This saves us from

// allocating and garbage collecting many objects for files with

// many items.

user = dataFileReader.next(user);

System.out.println(user);

}執行反序列化代碼解析user_generic.avro

avro數據解析成功。

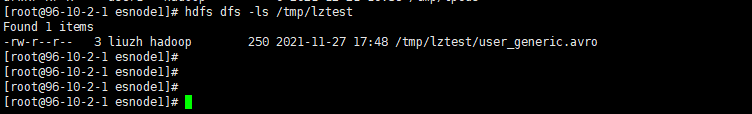

6、將user_generic.avro上傳至hdfs路徑

hdfs dfs -mkdir -p /tmp/lztest/ hdfs dfs -put user_generic.avro /tmp/lztest/

7、配置flinkserver

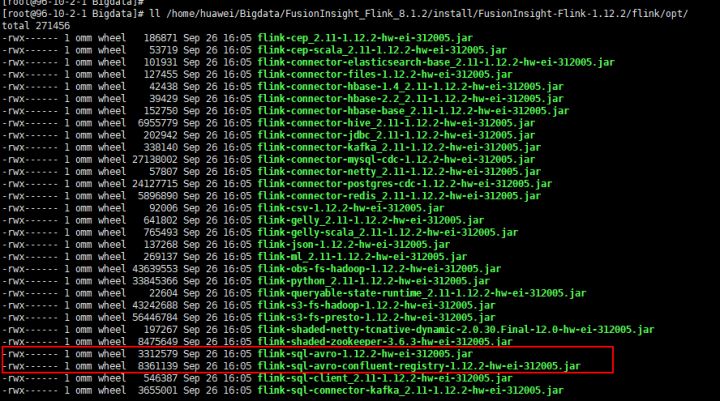

準備avro jar包

將flink-sql-avro-*.jar、flink-sql-avro-confluent-registry-*.jar放入flinkserver lib,將下面的命令在所有flinkserver節點執行

cp /opt/huawei/Bigdata/FusionInsight_Flink_8.1.2/install/FusionInsight-Flink-1.12.2/flink/opt/flink-sql-avro*.jar /opt/huawei/Bigdata/FusionInsight_Flink_8.1.3/install/FusionInsight-Flink-1.12.2/flink/lib chmod 500 flink-sql-avro*.jar chown omm:wheel flink-sql-avro*.jar

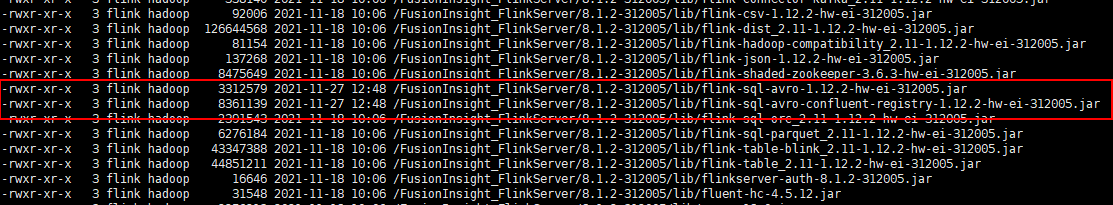

同時重啟FlinkServer實例,重啟完成后查看avro包是否被上傳

hdfs dfs -ls /FusionInsight_FlinkServer/8.1.2-312005/lib

8、編寫FlinkSQL

CREATE TABLE testHdfs( name String, favorite_number int, favorite_color String ) WITH( 'connector' = 'filesystem', 'path' = 'hdfs:///tmp/lztest/user_generic.avro', 'format' = 'avro' );CREATE TABLE KafkaTable ( name String, favorite_number int, favorite_color String ) WITH ( 'connector' = 'kafka', 'topic' = 'testavro', 'properties.bootstrap.servers' = '96.10.2.1:21005', 'properties.group.id' = 'testGroup', 'scan.startup.mode' = 'latest-offset', 'format' = 'avro' ); insert into KafkaTable select * from testHdfs;

保存提交任務

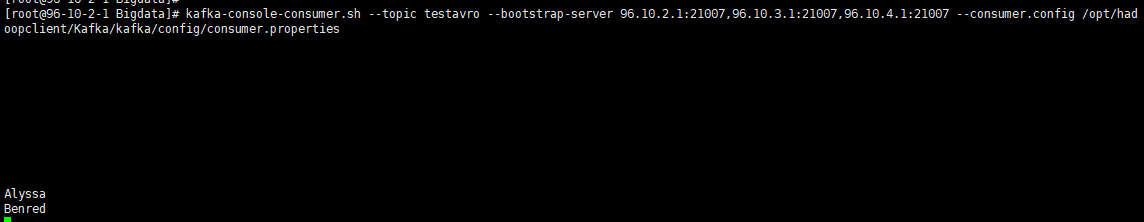

9、查看對應topic中是否有數據

FlinkSQL解析avro數據成功。

感謝各位的閱讀,以上就是“Apache Avro數據怎么生成”的內容了,經過本文的學習后,相信大家對Apache Avro數據怎么生成這一問題有了更深刻的體會,具體使用情況還需要大家實踐驗證。這里是億速云,小編將為大家推送更多相關知識點的文章,歡迎關注!

免責聲明:本站發布的內容(圖片、視頻和文字)以原創、轉載和分享為主,文章觀點不代表本網站立場,如果涉及侵權請聯系站長郵箱:is@yisu.com進行舉報,并提供相關證據,一經查實,將立刻刪除涉嫌侵權內容。