您好,登錄后才能下訂單哦!

您好,登錄后才能下訂單哦!

spark streaming窗口及聚合操作后怎么管理offset,針對這個問題,這篇文章詳細介紹了相對應的分析和解答,希望可以幫助更多想解決這個問題的小伙伴找到更簡單易行的方法。

spark streaming經過窗口的集合操作之后,再去管理offset呢?

對于spark streaming來說窗口操作之后,是無法管理offset的,因為offset的存儲于HasOffsetRanges,只有kafkaRDD繼承了該特質,經過轉化的其他RDD都不支持了。所以無法通過其他RDD轉化為HasOffsetRanges來獲取offset,以便自己管理。

kafkaRDD的繼承關系如下:

private[spark] class KafkaRDD[K, V]( sc: SparkContext, val kafkaParams: ju.Map[String, Object], val offsetRanges: Array[OffsetRange], val preferredHosts: ju.Map[TopicPartition, String], useConsumerCache: Boolean) extends RDD[ConsumerRecord[K, V]](sc, Nil) with Logging with HasOffsetRanges {

HasOffsetRanges只有kafkaRDD繼承了他,所以假如我們對KafkaRDD進行了轉化之后就無法再獲取offset了。

HasOffsetRanges就是一個OffsetRange的數組:

trait HasOffsetRanges { def offsetRanges: Array[OffsetRange]}

?

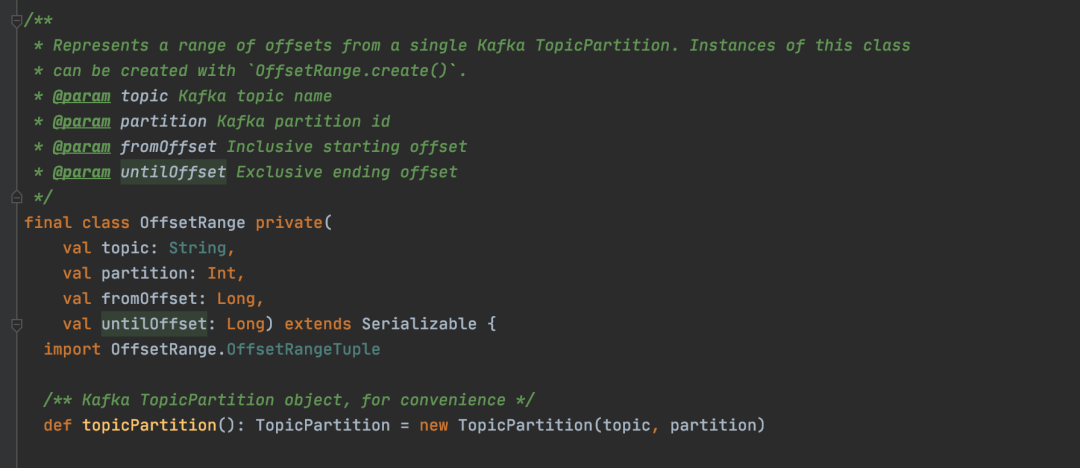

再看一下,OffsetRange的實現:

窗口操作會包含若干批次的RDD數據,窗口操作也往往帶有聚合操作,所以KafkaRDD肯定會被轉化為其他類型的RDD的,那么之后就無法轉化為hasoffsetranges了,也是管理offset變得很麻煩的。

實際上,無論是窗口是否有重疊和包含聚合,其實我們只關心本次處理窗口的kafkardds 的offset范圍[fromOffset, toOffset),由于fromOffset是上次提交成功的,那么本次處理完只需要提交的toOffset即可,即使處理失敗也可以從fromOffset開始重新處理。也就實現了數據的最少一次處理,假如能與結果一起管理,也可以實現僅一次處理。那么提交offset我們只需要提交最近的那個批次的kafkaRDD的toOffset即可。

那么如何獲取最新的kafkaRDD的toOffset呢?

其實,我們只需要在driver端記錄kafkardd轉化的hasoffsetrange存儲的offset即可。

回顧一下,對于spark 來說代碼執行位置分為driver和executor,我們希望再driver端獲取到offset,等處理完結果后,再提交offset到kafka或者直接與結果一起管理offset。

那么窗口操作之前獲取offset方法是什么呢?

就是利用transform操作,完成下面的步驟:

var A:mutable.HashMap[String,Array[OffsetRange]] = new mutable.HashMap()val offsetRanges = r.asInstanceOf[HasOffsetRanges].offsetRangesA += ("rdd1"->offsetRanges)

上述步驟就完成了,只記錄最新kafkardd的hasoffsetranges里存儲的offset功能。

總結一下:driver端通過使用transform獲取到offset信息,然后在輸出操作foreachrdd里面完成offset的提交操作。

package bigdata.spark.SparkStreaming.kafka010import java.util.Propertiesimport org.apache.kafka.clients.consumer.{Consumer, ConsumerRecord, KafkaConsumer}import org.apache.kafka.common.TopicPartitionimport org.apache.kafka.common.serialization.StringDeserializerimport org.apache.spark.rdd.RDDimport org.apache.spark.streaming.kafka010._import org.apache.spark.streaming.{Seconds, StreamingContext}import org.apache.spark.{SparkConf, TaskContext}import scala.collection.JavaConverters._import scala.collection.mutableobject kafka010NamedRDD {def main(args: Array[String]) {// 創建一個批處理時間是2s的context 要增加環境變量val sparkConf = new SparkConf().setAppName("DirectKafkaWordCount").setMaster("local[*]")val ssc = new StreamingContext(sparkConf, Seconds(5))ssc.checkpoint("/opt/checkpoint")// 使用broker和topic創建DirectStreamval topicsSet = "test".split(",").toSetval kafkaParams = Map[String, Object]("bootstrap.servers" -> "mt-mdh.local:9093","key.deserializer"->classOf[StringDeserializer],"value.deserializer"-> classOf[StringDeserializer],"group.id"->"test4","auto.offset.reset" -> "latest","enable.auto.commit"->(false: java.lang.Boolean))// 沒有接口提供 offsetval messages = KafkaUtils.createDirectStream[String, String](ssc,LocationStrategies.PreferConsistent,ConsumerStrategies.Subscribe[String, String](topicsSet, kafkaParams,getLastOffsets(kafkaParams ,topicsSet)))//var A:mutable.HashMap[String,Array[OffsetRange]] = new mutable.HashMap()val trans = messages.transform(r =>{val offsetRanges = r.asInstanceOf[HasOffsetRanges].offsetRangesA += ("rdd1"->offsetRanges)r}).countByWindow(Seconds(10), Seconds(5))trans.foreachRDD(rdd=>{if(!rdd.isEmpty()){val offsetRanges = A.get("rdd1").get//.asInstanceOf[HasOffsetRanges].offsetRangesrdd.foreachPartition { iter =>val o: OffsetRange = offsetRanges(TaskContext.get.partitionId)println(s"${o.topic} ${o.partition} ${o.fromOffset} ${o.untilOffset}")}println(rdd.count())println(offsetRanges)// 手動提交offset ,前提是禁止自動提交messages.asInstanceOf[CanCommitOffsets].commitAsync(offsetRanges)}// A.-("rdd1")})// 啟動流ssc.start()ssc.awaitTermination()}def getLastOffsets(kafkaParams : Map[String, Object],topics:Set[String]): Map[TopicPartition, Long] ={val props = new Properties()props.putAll(kafkaParams.asJava)val consumer = new KafkaConsumer[String, String](props)consumer.subscribe(topics.asJavaCollection)paranoidPoll(consumer)val map = consumer.assignment().asScala.map { tp =>println(tp+"---" +consumer.position(tp))tp -> (consumer.position(tp))}.toMapprintln(map)consumer.close()map}def paranoidPoll(c: Consumer[String, String]): Unit = {val msgs = c.poll(0)if (!msgs.isEmpty) {// position should be minimum offset per topicpartitionmsgs.asScala.foldLeft(Map[TopicPartition, Long]()) { (acc, m) =>val tp = new TopicPartition(m.topic, m.partition)val off = acc.get(tp).map(o => Math.min(o, m.offset)).getOrElse(m.offset)acc + (tp -> off)}.foreach { case (tp, off) =>c.seek(tp, off)}}}}

關于spark streaming窗口及聚合操作后怎么管理offset問題的解答就分享到這里了,希望以上內容可以對大家有一定的幫助,如果你還有很多疑惑沒有解開,可以關注億速云行業資訊頻道了解更多相關知識。

免責聲明:本站發布的內容(圖片、視頻和文字)以原創、轉載和分享為主,文章觀點不代表本網站立場,如果涉及侵權請聯系站長郵箱:is@yisu.com進行舉報,并提供相關證據,一經查實,將立刻刪除涉嫌侵權內容。