您好,登錄后才能下訂單哦!

您好,登錄后才能下訂單哦!

今天就跟大家聊聊有關一文教你使用scrapy-redis組件,可能很多人都不太了解,為了讓大家更加了解,小編給大家總結了以下內容,希望大家根據這篇文章可以有所收獲。

簡介

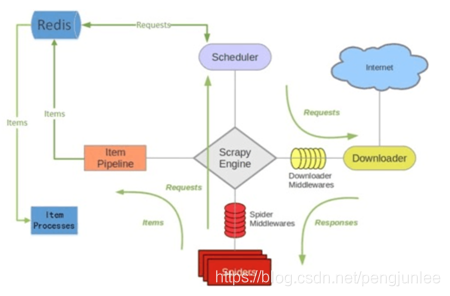

scrapy-redis是一個基于redis的scrapy組件,用于快速實現scrapy項目的分布式部署和數據爬取,其運行原理如下圖所示。

Scrapy-Redis特性

分布式爬取

你可以啟動多個共享同一redis隊列的爬蟲實例,多個爬蟲實例將各自提取到或者已請求的Requests在隊列中統一進行登記,使得Scheduler在請求調度時能夠對重復Requests進行過濾,即保證已經由某一個爬蟲實例請求過的Request將不會再被其他的爬蟲實例重復請求。

分布式數據處理

將scrapy爬取到的items匯聚到同一個redis隊列中,意味著你可以根據你的需要啟動盡可能多的共享這個items隊列的后處理程序。

Scrapy即插即用組件

Scheduler調度器 + Duplication重復過濾器、Item Pipeline、基礎Spider爬蟲

Scrapy-Redis示例

本文將以爬取京東所有圖書分類下的圖書信息為例對Scrapy-Redis的用法進行示例。

開發環境

下面列舉出了 Python 中 Scrapy-Redis 所需要的各個模塊及其版本:

在開發之前需要先安裝好以上模塊,以scrapy-redis-cluster模塊為例,使用pip進行安裝的命令如下:

pip install scrapy-redis-cluster # 安裝模塊 pip install scrapy-redis-cluster==0.4 # 安裝模塊時指定版本 pip install --upgrade scrapy-redis-cluster # 升級模塊版本

創建項目

在Windows命令行執行如下命令完成項目創建:

d:\scrapy>scrapy startproject jd_book

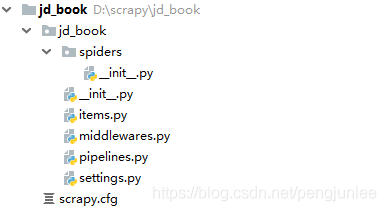

執行完該命令后,將會在當前目錄下創建包含下列內容的 jd_book 目錄:

定義Item

在items.py中把我們將要爬取的圖書字段預先定義好。

# -*- coding: utf-8 -*- import scrapy class JdBookItem(scrapy.Item): b_cate = scrapy.Field() # 圖書所屬一級分類名稱 s_cate = scrapy.Field() # 圖書所屬二級分類名稱 s_href = scrapy.Field() # 圖書所屬二級分類地址 book_name = scrapy.Field() # 名稱 book_img = scrapy.Field() # 封面圖片地址 book_author = scrapy.Field() # 作者 book_press = scrapy.Field() # 出版社 book_publish_date = scrapy.Field() # 出版日期 book_sku = scrapy.Field() # 商品編號 book_price = scrapy.Field() # 價格

創建Spider

在Windows命令行執行如下命令完成Spider創建:

d:\scrapy\jd_book>cd jd_book d:\scrapy\jd_book>scrapy genspider jdbook jd.com

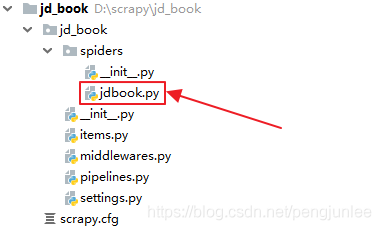

執行完該命令后,將會在 jd_book 的 spiders 目錄下生成一個 jdbook.py 文件 :

jdbook.py的完整爬蟲代碼如下。

# -*- coding: utf-8 -*-

import scrapy

import json

import urllib

from copy import deepcopy

from jd_book.items import JdBookItem

class JdbookSpider(scrapy.Spider):

name = 'jdbook'

allowed_domains = ['jd.com','3.cn']

start_urls = ['https://book.jd.com/booksort.html']

def parse(self, response): # 處理圖書分類頁

dt_list = response.xpath("//div[@class='mc']/dl/dt") # 提取一級分類元素

for dt in dt_list:

item = JdBookItem()

item["b_cate"] = dt.xpath("./a/text()").extract_first() # 提取一級分類名稱

em_list = dt.xpath("./following-sibling::dd[1]/em") # 提取二級分類元素

for em in em_list:

item["s_cate"] = em.xpath("./a/text()").extract_first() # 提取二級分類名稱

item["s_href"] = em.xpath("./a/@href").extract_first() # 提取二級分類地址

if item["s_href"] is not None:

item['s_href'] = "https:" + item['s_href'] # 補全二級分類地址

yield scrapy.Request(item['s_href'], callback=self.parse_book_list, meta={"item": deepcopy(item)})

def parse_book_list(self, response): # 處理二級分類下圖書列表頁

item = response.meta['item']

li_list = response.xpath("//div[@id='plist']/ul/li") # 提取所有的圖書元素

for li in li_list:

item["book_img"] = li.xpath(".//div[@class='p-img']//img/@data-lazy-img").extract_first()

if item["book_img"] is None:

item["book_img"] = li.xpath(".//div[@class='p-img']//img/@src").extract_first()

if item["book_img"] is not None:

item["book_img"] = "https:"+item["book_img"]

item["book_name"] = li.xpath(".//div[@class='p-name']/a/em/text()").extract_first().strip()

item["book_author"] = li.xpath(".//span[@class='author_type_1']/a/text()").extract()

item["book_press"] = li.xpath(".//span[@class='p-bi-store']/a/@title").extract_first()

item["book_publish_date"] = li.xpath(".//span[@class='p-bi-date']/text()").extract_first().strip()

item["book_sku"] = li.xpath("./div/@data-sku").extract_first()

price_url = "https://p.3.cn/prices/mgets?skuIds=j_{}".format(item["book_sku"]) # 提取圖書價格請求地址

yield scrapy.Request(price_url, callback=self.parse_book_price, meta={"item": deepcopy(item)})

# 提取列表頁下一頁地址

next_url = response.xpath("//a[@class='pn-next']/@href").extract_first()

if next_url is not None:

next_url = urllib.parse.urljoin(response.url, next_url)

# yield scrapy.Request(next_url,callback=self.parse_book_list,meta={"item":item})

def parse_book_price(self, response):

item = response.meta['item']

item["book_price"] = json.loads(response.body.decode())[0]["op"]

yield item修改配置

在settings.py 中增加Scrapy-Redis相關配置。

# -*- coding: utf-8 -*-

BOT_NAME = 'jd_book'

SPIDER_MODULES = ['jd_book.spiders']

NEWSPIDER_MODULE = 'jd_book.spiders'

# Crawl responsibly by identifying yourself (and your website) on the user-agent

USER_AGENT = 'Mozilla/5.0 (Windows NT 6.1; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/71.0.3578.98 Safari/537.36'

# Obey robots.txt rules

ROBOTSTXT_OBEY = False

######################################################

##############下面是Scrapy-Redis相關配置################

######################################################

# 指定Redis的主機名和端口

REDIS_HOST = 'localhost'

REDIS_PORT = 6379

# 調度器啟用Redis存儲Requests隊列

SCHEDULER = "scrapy_redis.scheduler.Scheduler"

# 確保所有的爬蟲實例使用Redis進行重復過濾

DUPEFILTER_CLASS = "scrapy_redis.dupefilter.RFPDupeFilter"

# 將Requests隊列持久化到Redis,可支持暫停或重啟爬蟲

SCHEDULER_PERSIST = True

# Requests的調度策略,默認優先級隊列

SCHEDULER_QUEUE_CLASS = 'scrapy_redis.queue.PriorityQueue'

# 將爬取到的items保存到Redis 以便進行后續處理

ITEM_PIPELINES = {

'scrapy_redis.pipelines.RedisPipeline': 300

}啟動爬蟲

至此京東圖書項目就算配置完成了,你可以將項目部署到多臺服務器中去,并使用如下命令來啟動爬蟲:

d:\scrapy\jd_book>scrapy crawl jdbook

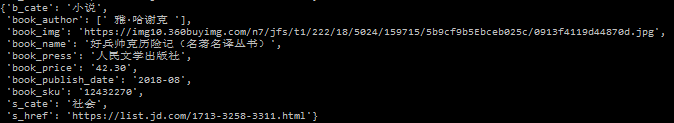

爬取到的圖書數據結構如下:

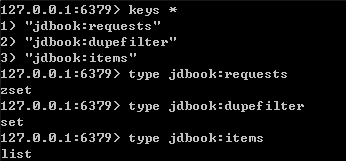

相應地,在Redis數據庫中同時生成了如下3個鍵:

其中,jdbook:requests 中保存了待爬取的Request對象;jdbook:dupefilter 中保存了已經爬取過的Request對象的指紋;jdbook:items中保存了爬取到的Item對象。

通過上述京東圖書項目不難看出,scrapy-redis項目與普通的scrapy項目相比,除了在settings.py配置時額外增加了一些scrapy-redis的專屬配置外,其他環節完全相同。

看完上述內容,你們對一文教你使用scrapy-redis組件有進一步的了解嗎?如果還想了解更多知識或者相關內容,請關注億速云行業資訊頻道,感謝大家的支持。

免責聲明:本站發布的內容(圖片、視頻和文字)以原創、轉載和分享為主,文章觀點不代表本網站立場,如果涉及侵權請聯系站長郵箱:is@yisu.com進行舉報,并提供相關證據,一經查實,將立刻刪除涉嫌侵權內容。