您好,登錄后才能下訂單哦!

您好,登錄后才能下訂單哦!

目標

嗯,我們知道搜索或瀏覽網站時會有很多精美、漂亮的圖片。

我們下載的時候,得鼠標一個個下載,而且還翻頁。

那么,有沒有一種方法,可以使用非人工方式自動識別并下載圖片。美美噠。

那么請使用python語言,構建一個抓取和下載網頁圖片的爬蟲。

當然為了提高效率,我們同時采用多線程并行方式。

思路分析

Python有很多的第三方庫,可以幫助我們實現各種各樣的功能。問題在于,我們弄清楚我們需要什么:

1)http請求庫,根據網站地址可以獲取網頁源代碼。甚至可以下載圖片寫入磁盤。

2)解析網頁源代碼,識別圖片連接地址。比如正則表達式,或者簡易的第三方庫。

3)支持構建多線程或線程池。

4)如果可能,需要偽造成瀏覽器,或繞過網站校驗。(嗯,網站有可能會防著爬蟲 ;-))

5)如果可能,也需要自動創建目錄,隨機數、日期時間等相關內容。

如此,我們開始搞事情。O(∩_∩)O~

環境配置

操作系統:windows 或 linux 皆可

Python版本:Python3.6 ( not Python 2.x 哦)

第三方庫

urllib.request

threading 或者 concurrent.futures 多線程或線程池(python3.2+)

re 正則表達式內置模塊

os 操作系統內置模塊

編碼過程

我們分解一下過程。完整源代碼在博文最終提供。

偽裝為瀏覽器

import urllib.request

# ------ 偽裝為瀏覽器 ---

def makeOpener(head={

'Connection': 'Keep-Alive',

'Accept': 'text/html, application/xhtml+xml, */*',

'Accept-Language': 'zh-CN,zh;q=0.8,zh-TW;q=0.7,zh-HK;q=0.5,en-US;q=0.3,en;q=0.2',

'Connection': 'keep-alive',

'User-Agent':'Mozilla/5.0 (Windows NT 6.1; WOW64; rv:57.0) Gecko/20100101 Firefox/57.0'

}):

cj = http.cookiejar.CookieJar()

opener = urllib.request.build_opener(urllib.request.HTTPCookieProcessor(cj))

header = []

for key, value in head.items():

elem = (key, value)

header.append(elem)

opener.addheaders = header

return opener

獲取網頁源代碼

# ------ 獲取網頁源代碼 ---

# url 網頁鏈接地址

def getHtml(url):

print('url='+url)

oper = makeOpener()

if oper is not None:

page = oper.open(url)

#print ('-----oper----')

else:

req=urllib.request.Request(url)

# 爬蟲偽裝瀏覽器

req.add_header('User-Agent','Mozilla/5.0 (Windows NT 6.1; WOW64; rv:57.0) Gecko/20100101 Firefox/57.0')

page = urllib.request.urlopen(req)

html = page.read()

if collectHtmlEnabled: #是否采集html

with open('html.txt', 'wb') as f:

f.write(html) # 采集到本地文件,來分析

# ------ 修改html對象內的字符編碼為UTF-8 ------

if chardetSupport:

cdt = chardet.detect(html)

charset = cdt['encoding'] #用chardet進行內容分析

else:

charset = 'utf8'

try:

result = html.decode(charset)

except:

result = html.decode('gbk')

return result

下載單個圖片

# ------ 根據圖片url下載圖片 ------

# folderPath 定義圖片存放的目錄 imgUrl 一個圖片的鏈接地址 index 索引,表示第幾個圖片

def downloadImg(folderPath, imgUrl, index):

# ------ 異常處理 ------

try:

imgContent = (urllib.request.urlopen(imgUrl)).read()

except urllib.error.URLError as e:

if printLogEnabled : print ('【錯誤】當前圖片無法下載')

return False

except urllib.error.HTTPError as e:

if printLogEnabled : print ('【錯誤】當前圖片下載異常')

return False

else:

imgeNameFromUrl = os.path.basename(imgUrl)

if printLogEnabled : print ('正在下載第'+str(index+1)+'張圖片,圖片地址:'+str(imgUrl))

# ------ IO處理 ------

isExists=os.path.exists(folderPath)

if not isExists: # 目錄不存在,則創建

os.makedirs( folderPath )

#print ('創建目錄')

# 圖片名命名規則,隨機字符串

imgName = imgeNameFromUrl

if len(imgeNameFromUrl) < 8:

imgName = random_str(4) + random_str(1,'123456789') + random_str(2,'0123456789')+"_" + imgeNameFromUrl

filename= folderPath + "\\"+str(imgName)+".jpg"

try:

with open(filename, 'wb') as f:

f.write(imgContent) # 寫入本地磁盤

# if printLogEnabled : print ('下載完成第'+str(index+1)+'張圖片')

except :

return False

return True

下載一批圖片(多線程/線程池模式皆支持)

# ------ 批量下載圖片 ------

# folderPath 定義圖片存放的目錄 imgList 多個圖片的鏈接地址

def downloadImgList(folderPath, imgList):

index = 0

# print ('poolSupport='+str(poolSupport))

if not poolSupport:

#print ('多線程模式')

# ------ 多線程編程 ------

threads = []

for imgUrl in imgList:

# if printLogEnabled : print ('準備下載第'+str(index+1)+'張圖片')

threads.append(threading.Thread(target=downloadImg,args=(folderPath,imgUrl,index,)))

index += 1

for t in threads:

t.setDaemon(True)

t.start()

t.join() #父線程,等待所有線程結束

if len(imgList) >0 : print ('下載結束,存放圖片目錄:' + str(folderPath))

else:

#print ('線程池模式')

# ------ 線程池編程 ------

futures = []

# 創建一個最大可容納N個task的線程池 thePoolSize 為 全局變量

with concurrent.futures.ThreadPoolExecutor(max_workers=thePoolSize) as pool:

for imgUrl in imgList:

# if printLogEnabled : print ('準備下載第'+str(index+1)+'張圖片')

futures.append(pool.submit(downloadImg, folderPath, imgUrl, index))

index += 1

result = concurrent.futures.wait(futures, timeout=None, return_when='ALL_COMPLETED')

suc = 0

for f in result.done:

if f.result(): suc +=1

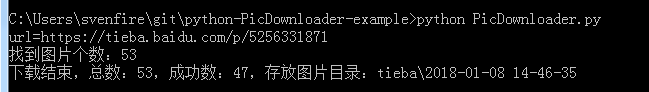

print('下載結束,總數:'+str(len(imgList))+',成功數:'+str(suc)+',存放圖片目錄:' + str(folderPath))

調用例子

如百度貼吧為例

# ------ 下載百度帖子內所有圖片 ------

# folderPath 定義圖片存放的目錄 url 百度貼吧鏈接

def downloadImgFromBaidutieba(folderPath='tieba', url='https://tieba.baidu.com/p/5256331871'):

html = getHtml(url)

# ------ 利用正則表達式匹配網頁內容找到圖片地址 ------

#reg = r'src="(.*?\.jpg)"'

reg = r'src="(.*?/sign=.*?\.jpg)"'

imgre = re.compile(reg);

imgList = re.findall(imgre, html)

print ('找到圖片個數:' + str(len(imgList)))

# 下載圖片

if len(imgList) >0 : downloadImgList(folderPath, imgList)

# 程序入口

if __name__ == '__main__':

now = datetime.datetime.now().strftime('%Y-%m-%d %H-%M-%S')

# 下載百度帖子內所有圖片

downloadImgFromBaidutieba('tieba\\'+now, 'https://tieba.baidu.com/p/5256331871')

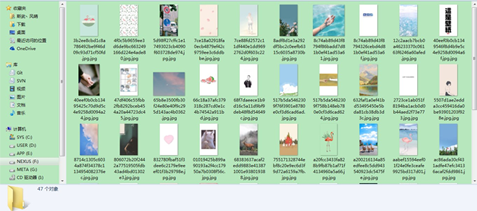

效果

完整源碼請見

我的github:https://github.com/SvenAugustus/PicDownloader-example

以上就是本文的全部內容,希望對大家的學習有所幫助,也希望大家多多支持億速云。

免責聲明:本站發布的內容(圖片、視頻和文字)以原創、轉載和分享為主,文章觀點不代表本網站立場,如果涉及侵權請聯系站長郵箱:is@yisu.com進行舉報,并提供相關證據,一經查實,將立刻刪除涉嫌侵權內容。