您好,登錄后才能下訂單哦!

您好,登錄后才能下訂單哦!

項目描述:

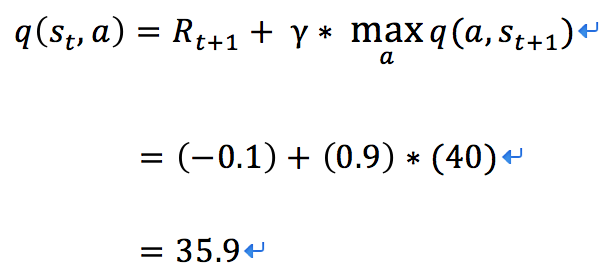

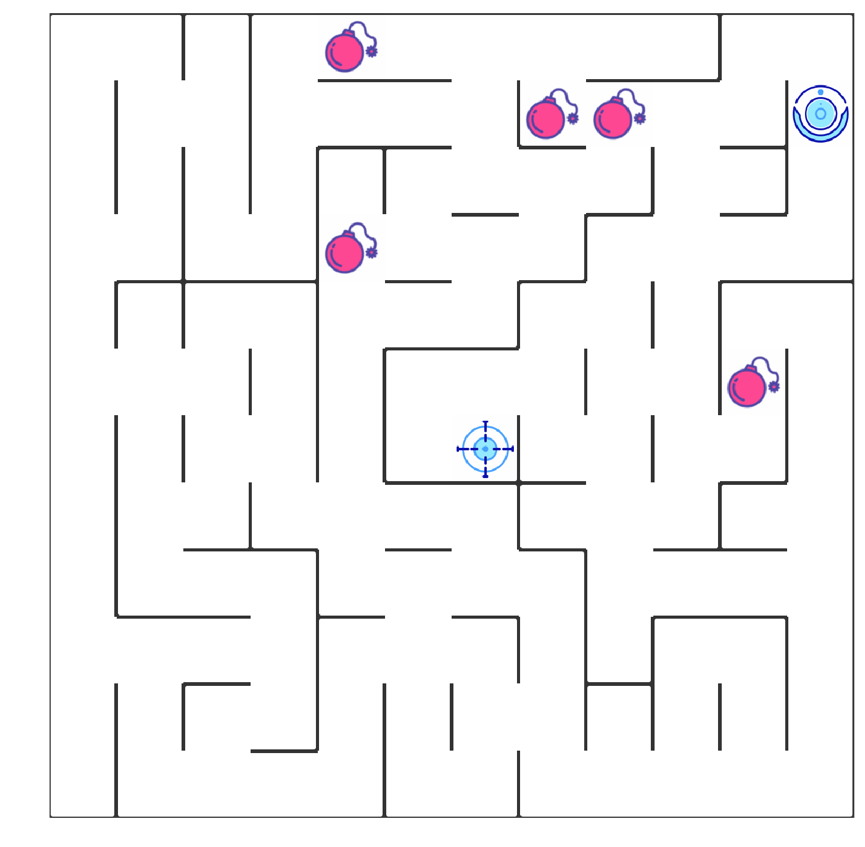

在該項目中,你將使用強化學習算法,實現一個自動走迷宮機器人。

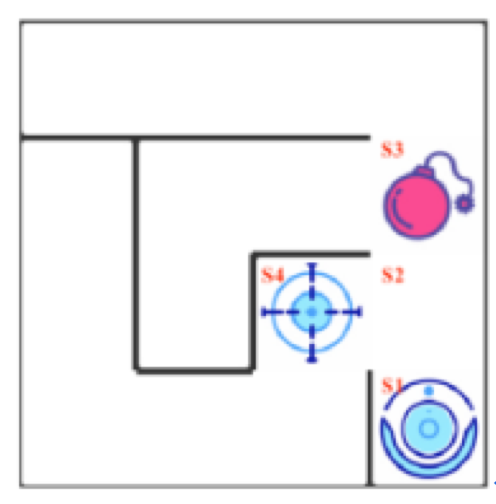

如上圖所示,智能機器人顯示在右上角。在我們的迷宮中,有陷阱(紅色×××)及終點(藍色的目標點)兩種情景。機器人要盡量避開陷阱、盡快到達目的地。

小車可執行的動作包括:向上走 u、向右走 r、向下走 d、向左走l。

執行不同的動作后,根據不同的情況會獲得不同的獎勵,具體而言,有以下幾種情況。

我們需要通過修改 robot.py 中的代碼,來實現一個 Q Learning 機器人,實現上述的目標。

Section 1 算法理解

1.1 強化學習總覽

強化學習作為機器學習算法的一種,其模式也是讓智能體在“訓練”中學到“經驗”,以實現給定的任務。但不同于監督學習與非監督學習,在強化學習的框架中,我們更側重通過智能體與環境的交互來學習。通常在監督學習和非監督學習任務中,智能體往往需要通過給定的訓練集,輔之以既定的訓練目標(如最小化損失函數),通過給定的學習算法來實現這一目標。然而在強化學習中,智能體則是通過其與環境交互得到的獎勵進行學習。這個環境可以是虛擬的(如虛擬的迷宮),也可以是真實的(自動駕駛汽車在真實道路上收集數據)。

在強化學習中有五個核心組成部分,它們分別是:環境(Environment)、智能體(Agent)、狀態(State)、動作(Action)和獎勵(Reward)。在某一時間節點t:

智能體在從環境中感知其所處的狀態

智能體根據某些準則選擇動作

環境根據智能體選擇的動作,向智能體反饋獎勵

通過合理的學習算法,智能體將在這樣的問題設置下,成功學到一個在狀態  選擇動作

選擇動作  的策略

的策略  。

。

1.2 計算Q值

在我們的項目中,我們要實現基于 Q-Learning 的強化學習算法。Q-Learning 是一個值迭代(Value Iteration)算法。與策略迭代(Policy Iteration)算法不同,值迭代算法會計算每個”狀態“或是”狀態-動作“的值(Value)或是效用(Utility),然后在執行動作的時候,會設法最大化這個值。因此,對每個狀態值的準確估計,是我們值迭代算法的核心。通常我們會考慮最大化動作的長期獎勵,即不僅考慮當前動作帶來的獎勵,還會考慮動作長遠的獎勵。

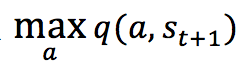

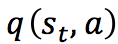

在 Q-Learning 算法中,我們把這個長期獎勵記為 Q 值,我們會考慮每個 ”狀態-動作“ 的 Q 值,具體而言,它的計算公式為:

也就是對于當前的“狀態-動作”  ,我們考慮執行動作

,我們考慮執行動作  后環境給我們的獎勵

后環境給我們的獎勵 ,以及執行動作

,以及執行動作  到達

到達  后,執行任意動作能夠獲得的最大的Q值

后,執行任意動作能夠獲得的最大的Q值 ,

, 為折扣因子。

為折扣因子。

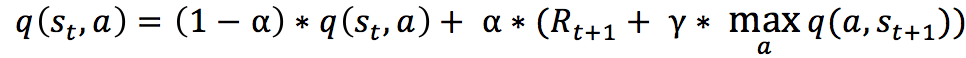

不過一般地,我們使用更為保守地更新 Q 表的方法,即引入松弛變量 alpha,按如下的公式進行更新,使得 Q 表的迭代變化更為平緩。

根據已知條件求 。

。

已知:如上圖,機器人位于 s1,行動為 u,行動獲得的獎勵與題目的默認設置相同。在 s2 中執行各動作的 Q 值為:u: -24,r: -13,d: -0.29、l: +40,γ取0.9。

1.3 如何選擇動作

在強化學習中,「探索-利用」問題是非常重要的問題。具體來說,根據上面的定義,我們會盡可能地讓機器人在每次選擇最優的決策,來最大化長期獎勵。但是這樣做有如下的弊端:

因此我們需要一種辦法,來解決如上的問題,增加機器人的探索。由此我們考慮使用 epsilon-greedy 算法,即在小車選擇動作的時候,以一部分的概率隨機選擇動作,以一部分的概率按照最優的 Q 值選擇動作。同時,這個選擇隨機動作的概率應當隨著訓練的過程逐步減小。

在如下的代碼塊中,實現 epsilon-greedy 算法的邏輯,并運行測試代碼。

import random

import operator

actions = ['u','r','d','l']

qline = {'u':1.2, 'r':-2.1, 'd':-24.5, 'l':27}

epsilon = 0.3 # 以0.3的概率進行隨機選擇

def choose_action(epsilon):

action = None

if random.uniform(0,1.0) <= epsilon: # 以某一概率

action = random.choice(actions)# 實現對動作的隨機選擇

else:

action = max(qline.items(), key=operator.itemgetter(1))[0] # 否則選擇具有最大 Q 值的動作

return action

range(100): res += choose_action(epsilon) print(res) res = '' for i in range(100): res += choose_action(epsilon) print(res) ldllrrllllrlldlldllllllllllddulldlllllldllllludlldllllluudllllllulllllllllllullullllllllldlulllllrlr

Section 2 代碼實現

2.1 Maze 類理解

我們首先引入了迷宮類 Maze,這是一個非常強大的函數,它能夠根據你的要求隨機創建一個迷宮,或者根據指定的文件,讀入一個迷宮地圖信息。

Maze("file_name") 根據指定文件創建迷宮,或者使用 Maze(maze_size=(height, width))來隨機生成一個迷宮。trap number 參數,在創建迷宮的時候,設定迷宮中陷阱的數量。g=Maze("xx.txt"),那么直接輸入 g 即可。在如下的代碼塊中,創建你的迷宮并展示。

from Maze import Maze %matplotlib inline %confer InlineBackend.figure_format = 'retina' ## to-do: 創建迷宮并展示 g=Maze(maze_size=(6,8), trap_number=1) g Maze of size (12, 12 )

你可能已經注意到,在迷宮中我們已經默認放置了一個機器人。實際上,我們為迷宮配置了相應的 API,來幫助機器人的移動與感知。其中你隨后會使用的兩個 API 為 maze.sense_robot() 及 maze.move_robot() 。

maze.sense_robot() 為一個無參數的函數,輸出機器人在迷宮中目前的位置。maze.move_robot(direction) 對輸入的移動方向,移動機器人,并返回對應動作的獎勵值。隨機移動機器人,并記錄下獲得的獎勵,展示出機器人最后的位置。

rewards = [] ## 循環、隨機移動機器人10次,記錄下獎勵 for i in range(10): res = g.move_robot(random. Choice(actions)) rewards.append(res) ## 輸出機器人最后的位置 print(g.sense_robot()) ## 打印迷宮,觀察機器人位置 g (0,9)

2.2 Robot 類實現

Robot 類是我們需要重點實現的部分。在這個類中,我們需要實現諸多功能,以使得我們成功實現一個強化學習智能體。總體來說,之前我們是人為地在環境中移動了機器人,但是現在通過實現 Robot 這個類,機器人將會自己移動。通過實現學習函數,Robot 類將會學習到如何選擇最優的動作,并且更新強化學習中對應的參數。

首先 Robot 有多個輸入,其中 alpha=0.5, gamma=0.9, epsilon0=0.5 表征強化學習相關的各個參數的默認值,這些在之前你已經了解到,Maze 應為機器人所在迷宮對象。

隨后觀察 Robot.update 函數,它指明了在每次執行動作時,Robot 需要執行的程序。按照這些程序,各個函數的功能也就明了了。

運行如下代碼檢查效果(記得將 maze 變量修改為你創建迷宮的變量名)。

import random

import operator

class Robot(object):

def __init__(self, maze, alpha=0.5, gamma=0.9, epsilon0=0.5):

self. Maze = maze

self.valid_actions = self.maze.valid_actions

self.state = None

self.action = None

# Set Parameters of the Learning Robot

self.alpha = alpha

self.gamma = gamma

self.epsilon0 = epsilon0

self. Epsilon = epsilon0

self.t = 0

self.Qtable = {}

self. Reset()

def. reset(self):

"""

Reset the robot

"""

self.state = self.sense_state()

self.create_Qtable_line(self.state)

def. set status(self, learning=False, testing=False):

"""

Determine whether the robot is learning its q table, or

executing the testing procedure.

"""

self. Learning = learning

self.testing = testing

def. update_parameter(self):

"""

Some of the paramters of the q learning robot can be altered,

update these parameters when necessary.

"""

if self.testing:

# TODO 1. No random choice when testing

self. Epsilon = 0

else:

# TODO 2. Update parameters when learning

self. Epsilon *= 0.95

return self. Epsilon

def. sense_state(self):

"""

Get the current state of the robot. In this

"""

# TODO 3. Return robot's current state

return self.maze.sense_robot()

def. create_Qtable_line(self, state):

"""

Create the qtable with the current state

"""

# TODO 4. Create qtable with current state

# Our qtable should be a two level dict,

# Qtable[state] ={'u':xx, 'd':xx, ...}

# If Qtable[state] already exits, then do

# not change it.

self.Qtable.setdefault(state, {a: 0.0 for a in self.valid_actions})

def. choose_action(self):

"""

Return an action according to given rules

"""

def. is_random_exploration():

# TODO 5. Return whether do random choice

# hint: generate a random number, and compare

# it with epsilon

return random.uniform(0, 1.0) <= self. Epsilon

if self. Learning:

if is_random_exploration():

# TODO 6. Return random choose aciton

return random. Choice(self.valid_actions)

else:

# TODO 7. Return action with highest q value

return max(self.Qtable[self.state].items(), key=operator.itemgetter(1))[0]

elif self.testing:

# TODO 7. choose action with highest q value

return max(self.Qtable[self.state].items(), key=operator.itemgetter(1))[0]

else:

# TODO 6. Return random choose aciton

return random. Choice(self.valid_actions)

def. update_Qtable(self, r, action, next_state):

"""

Update the qtable according to the given rule.

"""

if self. Learning:

# TODO 8. When learning, update the q table according

# to the given rules

self.Qtable[self.state][action] = (1 - self.alpha) * self.Qtable[self.state][action] + self.alpha * (

r + self.gamma * max(self.Qtable[next_state].values()))

def. update(self):

"""

Describle the procedure what to do when update the robot.

Called every time in every epoch in training or testing.

Return current action and reward.

"""

self.state = self.sense_state() # Get the current state

self.create_Qtable_line(self.state) # For the state, create q table line

action = self.choose_action() # choose action for this state

reward = self.maze.move_robot(action) # move robot for given action

next_state = self.sense_state() # get next state

self.create_Qtable_line(next_state) # create q table line for next state

if self. Learning and not self.testing:

self.update_Qtable(reward, action, next_state) # update q table

self.update_parameter() # update parameters

return action, reward

# from Robot import Robot

# g=Maze(maze_size=(6,12), trap_number=2)

g=Maze("test_world\maze_01.txt")

robot = Robot(g) # 記得將 maze 變量修改為你創建迷宮的變量名

robot.set_status(learning=True,testing=False)

print(robot.update())

g

('d', -0.1)

Maze of size (12, 12)

2.3 用 Runner 類訓練 Robot

在完成了上述內容之后,我們就可以開始對我們 Robot 進行訓練并調參了。我們準備了又一個非常棒的類 Runner ,來實現整個訓練過程及可視化。使用如下的代碼,你可以成功對機器人進行訓練。并且你會在當前文件夾中生成一個名為 filename 的視頻,記錄了整個訓練的過程。通過觀察該視頻,你能夠發現訓練過程中的問題,并且優化你的代碼及參數。

嘗試利用下列代碼訓練機器人,并進行調參。可選的參數包括:

epochepsilon0 (epsilon 初值)epsilon 衰減(可以是線性、指數衰減,可以調整衰減的速度),你需要在 Robot.py 中調整alphagammafrom Runner import Runner g = Maze(maze_size=maze_size,trap_number=trap_number) r = Robot(g,alpha=alpha, epsilon0=epsilon0, gamma=gamma) r.set_status(learning=True) runner = Runner(r, g) runner.run_training(epoch, display_direction=True) #runner.generate_movie(filename = "final1.mp4") # 你可以注釋該行代碼,加快運行速度,不過你就無法觀察到視頻了。 g

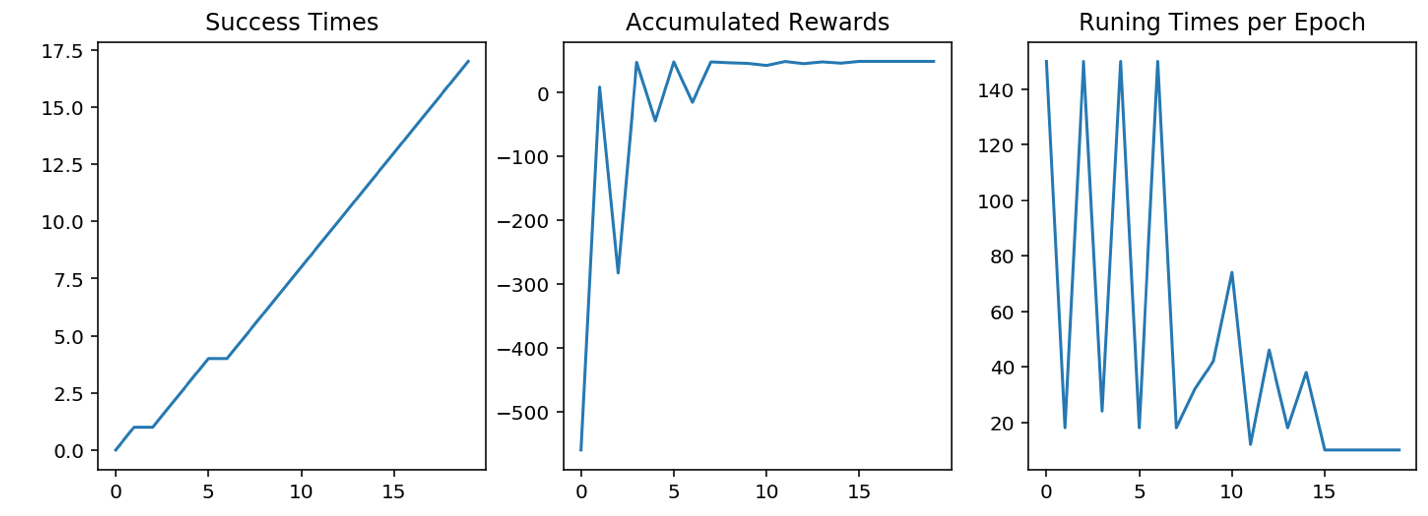

使用 runner.plot_results() 函數,能夠打印機器人在訓練過程中的一些參數信息。

使用 runner.plot_results() 輸出訓練結果

runner.plot_results()

以上就是本文的全部內容,希望對大家的學習有所幫助,也希望大家多多支持億速云。

免責聲明:本站發布的內容(圖片、視頻和文字)以原創、轉載和分享為主,文章觀點不代表本網站立場,如果涉及侵權請聯系站長郵箱:is@yisu.com進行舉報,并提供相關證據,一經查實,將立刻刪除涉嫌侵權內容。