您好,登錄后才能下訂單哦!

您好,登錄后才能下訂單哦!

這篇文章將為大家詳細講解有關PHP結合redis實現大文件去重的方法,小編覺得挺實用的,因此分享給大家做個參考,希望大家閱讀完這篇文章后可以有所收獲。

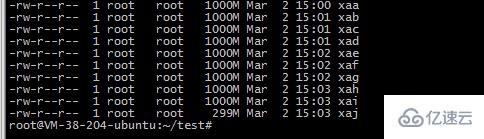

1.對一個大文件比如我的文件為

-rw-r--r-- 1 ubuntu ubuntu 9.1G Mar 1 17:53 2018-12-awk-uniq.txt

2.使用split命令切割成10個小文件

split -b 1000m 2018-12-awk-uniq.txt -b 按照字節切割 , 支持單位m和k

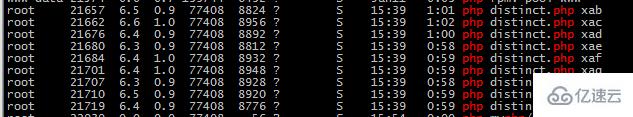

3.使用10個php進程讀取文件 , 插入redis的有序集合結構中 , 重復的是插不進去的 ,因此可以起到去重的作用

<?php

$file=$argv[1];

//守護進程

umask(0); //把文件掩碼清0

if (pcntl_fork() != 0){ //是父進程,父進程退出

exit();

}

posix_setsid();//設置新會話組長,脫離終端

if (pcntl_fork() != 0){ //是第一子進程,結束第一子進程

exit();

}

$start=memory_get_usage();

$redis=new Redis();

$redis->connect('127.0.0.1', 6379);

$handle = fopen("./{$file}", 'rb');

while (feof($handle)===false) {

$line=fgets($handle);

$email=str_replace("\n","",$line);

$redis->zAdd('emails', 1, $email);

}

4. redis中查看獲取的數據

zcard emails 獲取元素個數

取一定范圍的元素 , 比如從100000開始 到 100100結束

zrange emails 100000 100100 WITHSCORES

關于PHP結合redis實現大文件去重的方法就分享到這里了,希望以上內容可以對大家有一定的幫助,可以學到更多知識。如果覺得文章不錯,可以把它分享出去讓更多的人看到。

免責聲明:本站發布的內容(圖片、視頻和文字)以原創、轉載和分享為主,文章觀點不代表本網站立場,如果涉及侵權請聯系站長郵箱:is@yisu.com進行舉報,并提供相關證據,一經查實,將立刻刪除涉嫌侵權內容。