您好,登錄后才能下訂單哦!

您好,登錄后才能下訂單哦!

今天小編給大家分享一下Python圖片存儲和訪問的三種方式是什么的相關知識點,內容詳細,邏輯清晰,相信大部分人都還太了解這方面的知識,所以分享這篇文章給大家參考一下,希望大家閱讀完這篇文章后有所收獲,下面我們一起來了解一下吧。

ImageNet 是一個著名的公共圖像數據庫,用于訓練對象分類、檢測和分割等任務的模型,它包含超過 1400 萬張圖像。

在 Python 中處理圖像數據的時候,例如應用卷積神經網絡(也稱CNN)等算法可以處理大量圖像數據集,這里就需要學習如何用最簡單的方式存儲、讀取數據。

對于圖像數據處理應該有有個定量的比較方式,讀取和寫入文件需要多長時間,以及將使用多少磁盤內存。

分別用不同的方式去處理、解決圖像的存儲、性能優化的問題。

我們熟知的圖像數據集 CIFAR-10,由 60000 個 32x32 像素的彩色圖像組成,這些圖像屬于不同的對象類別,例如狗、貓和飛機。相對而言 CIFAR 不是一個非常大的數據集,但如使用完整的 TinyImages 數據集,那么將需要大約 400GB 的可用磁盤空間。

文中的代碼應用的數據集下載地址 CIFAR-10 數據集 。

這份數據是使用cPickle進行了序列化和批量保存。pickle模塊可以序列化任何 Python 對象,而無需進行任何額外的代碼或轉換。但是有一個潛在的嚴重缺點,即在處理大量數據時會帶來安全風險無法評估。

圖像加載到 NumPy 數組中

import numpy as np

import pickle

from pathlib import Path

# 文件路徑

data_dir = Path("data/cifar-10-batches-py/")

# 解碼功能

def unpickle(file):

with open(file, "rb") as fo:

dict = pickle.load(fo, encoding="bytes")

return dict

images, labels = [], []

for batch in data_dir.glob("data_batch_*"):

batch_data = unpickle(batch)

for i, flat_im in enumerate(batch_data[b"data"]):

im_channels = []

# 每個圖像都是扁平化的,通道按 R, G, B 的順序排列

for j in range(3):

im_channels.append(

flat_im[j * 1024 : (j + 1) * 1024].reshape((32, 32))

)

# 重建原始圖像

images.append(np.dstack((im_channels)))

# 保存標簽

labels.append(batch_data[b"labels"][i])

print("加載 CIFAR-10 訓練集:")

print(f" - np.shape(images) {np.shape(images)}")

print(f" - np.shape(labels) {np.shape(labels)}")安裝三方庫 Pillow 用于圖像處理 。

pip install Pillow

LMDB 也稱為“閃電數據庫”,代表閃電內存映射數據庫,因為速度快并且使用內存映射文件。它是鍵值存儲,而不是關系數據庫。

安裝三方庫 lmdb 用于圖像處理 。

pip install lmdb

HDF5 代表 Hierarchical Data Format,一種稱為 HDF4 或 HDF5 的文件格式。起源于美國國家超級計算應用中心,是一種可移植、緊湊的科學數據格式。

安裝三方庫 h6py 用于圖像處理 。

pip install h6py

3種不同的方式進行數據讀取操作

from pathlib import Path

disk_dir = Path("data/disk/")

lmdb_dir = Path("data/lmdb/")

hdf5_dir = Path("data/hdf5/")同時加載的數據可以創建文件夾分開保存

disk_dir.mkdir(parents=True, exist_ok=True) lmdb_dir.mkdir(parents=True, exist_ok=True) hdf5_dir.mkdir(parents=True, exist_ok=True)

使用 Pillow 完成輸入是一個單一的圖像 image,在內存中作為一個 NumPy 數組,并且使用唯一的圖像 ID 對其進行命名image_id。

單個圖像保存到磁盤

from PIL import Image

import csv

def store_single_disk(image, image_id, label):

""" 將單個圖像作為 .png 文件存儲在磁盤上。

參數:

---------------

image 圖像數組, (32, 32, 3) 格式

image_id 圖像的整數唯一 ID

label 圖像標簽

"""

Image.fromarray(image).save(disk_dir / f"{image_id}.png")

with open(disk_dir / f"{image_id}.csv", "wt") as csvfile:

writer = csv.writer(

csvfile, delimiter=" ", quotechar="|", quoting=csv.QUOTE_MINIMAL

)

writer.writerow([label])LMDB 是一個鍵值對存儲系統,其中每個條目都保存為一個字節數組,鍵將是每個圖像的唯一標識符,值將是圖像本身。

鍵和值都應該是字符串。 常見的用法是將值序列化為字符串,然后在讀回時將其反序列化。

用于重建的圖像尺寸,某些數據集可能包含不同大小的圖像會使用到這個方法。

class CIFAR_Image: def __init__(self, image, label): self.channels = image.shape[2] self.size = image.shape[:2] self.image = image.tobytes() self.label = label def get_image(self): """ 將圖像作為 numpy 數組返回 """ image = np.frombuffer(self.image, dtype=np.uint8) return image.reshape(*self.size, self.channels)

單個圖像保存到 LMDB

import lmdb

import pickle

def store_single_lmdb(image, image_id, label):

""" 將單個圖像存儲到 LMDB

參數:

---------------

image 圖像數組, (32, 32, 3) 格式

image_id 圖像的整數唯一 ID

label 圖像標簽

"""

map_size = image.nbytes * 10

# Create a new LMDB environment

env = lmdb.open(str(lmdb_dir / f"single_lmdb"), map_size=map_size)

# Start a new write transaction

with env.begin(write=True) as txn:

# All key-value pairs need to be strings

value = CIFAR_Image(image, label)

key = f"{image_id:08}"

txn.put(key.encode("ascii"), pickle.dumps(value))

env.close()一個 HDF5 文件可以包含多個數據集。可以創建兩個數據集,一個用于圖像,一個用于元數據。

import h6py

def store_single_hdf5(image, image_id, label):

""" 將單個圖像存儲到 HDF5 文件

參數:

---------------

image 圖像數組, (32, 32, 3) 格式

image_id 圖像的整數唯一 ID

label 圖像標簽

"""

# 創建一個新的 HDF5 文件

file = h6py.File(hdf5_dir / f"{image_id}.h6", "w")

# 在文件中創建數據集

dataset = file.create_dataset(

"image", np.shape(image), h6py.h6t.STD_U8BE, data=image

)

meta_set = file.create_dataset(

"meta", np.shape(label), h6py.h6t.STD_U8BE, data=label

)

file.close()將保存單個圖像的所有三個函數放入字典中。

_store_single_funcs = dict( disk=store_single_disk, lmdb=store_single_lmdb, hdf5=store_single_hdf5 )

以三種不同的方式存儲保存 CIFAR 中的第一張圖像及其對應的標簽。

from timeit import timeit

store_single_timings = dict()

for method in ("disk", "lmdb", "hdf5"):

t = timeit(

"_store_single_funcs[method](image, 0, label)",

setup="image=images[0]; label=labels[0]",

number=1,

globals=globals(),

)

store_single_timings[method] = t

print(f"存儲方法: {method}, 使用耗時: {t}")來一個表格看看對比。

| 存儲方法 | 存儲耗時 | 使用內存 |

|---|---|---|

| Disk | 2.1 ms | 8 K |

| LMDB | 1.7 ms | 32 K |

| HDF5 | 8.1 ms | 8 K |

同單個圖像存儲方法類似,修改代碼進行多個圖像數據的存儲。

將多個圖像保存為.png文件就可以理解為多次調用 store_single_method() 這樣。但這不適用于 LMDB 或 HDF5,因為每個圖像都有不同的數據庫文件。

將一組圖像存儲到磁盤

store_many_disk(images, labels):

""" 參數:

---------------

images 圖像數組 (N, 32, 32, 3) 格式

labels 標簽數組 (N,1) 格式

"""

num_images = len(images)

# 一張一張保存所有圖片

for i, image in enumerate(images):

Image.fromarray(image).save(disk_dir / f"{i}.png")

# 將所有標簽保存到 csv 文件

with open(disk_dir / f"{num_images}.csv", "w") as csvfile:

writer = csv.writer(

csvfile, delimiter=" ", quotechar="|", quoting=csv.QUOTE_MINIMAL

)

for label in labels:

writer.writerow([label])將一組圖像存儲到 LMDB

def store_many_lmdb(images, labels):

""" 參數:

---------------

images 圖像數組 (N, 32, 32, 3) 格式

labels 標簽數組 (N,1) 格式

"""

num_images = len(images)

map_size = num_images * images[0].nbytes * 10

# 為所有圖像創建一個新的 LMDB 數據庫

env = lmdb.open(str(lmdb_dir / f"{num_images}_lmdb"), map_size=map_size)

# 在一個事務中寫入所有圖像

with env.begin(write=True) as txn:

for i in range(num_images):

# 所有鍵值對都必須是字符串

value = CIFAR_Image(images[i], labels[i])

key = f"{i:08}"

txn.put(key.encode("ascii"), pickle.dumps(value))

env.close()將一組圖像存儲到 HDF5

def store_many_hdf5(images, labels):

""" 參數:

---------------

images 圖像數組 (N, 32, 32, 3) 格式

labels 標簽數組 (N,1) 格式

"""

num_images = len(images)

# 創建一個新的 HDF5 文件

file = h6py.File(hdf5_dir / f"{num_images}_many.h6", "w")

# 在文件中創建數據集

dataset = file.create_dataset(

"images", np.shape(images), h6py.h6t.STD_U8BE, data=images

)

meta_set = file.create_dataset(

"meta", np.shape(labels), h6py.h6t.STD_U8BE, data=labels

)

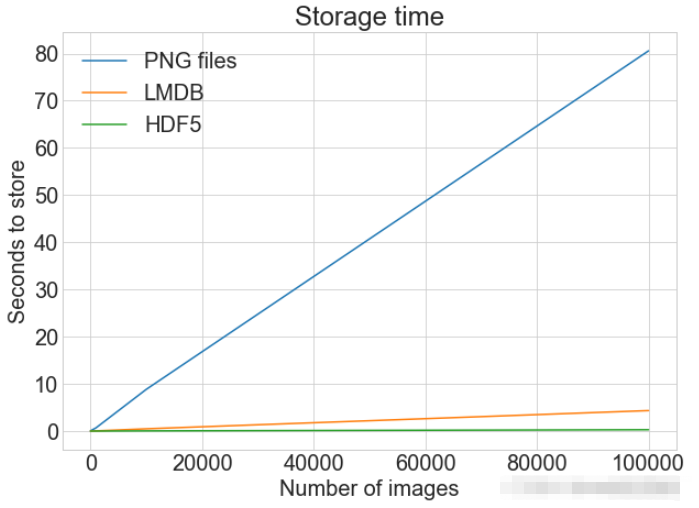

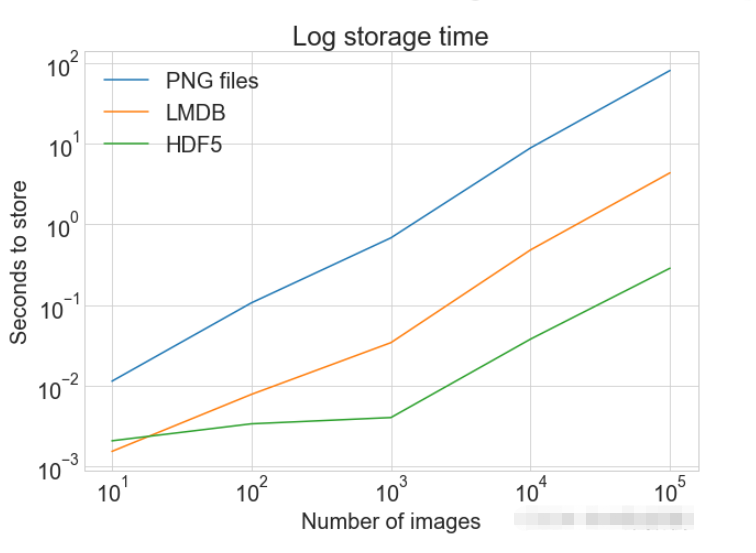

file.close()使用 100000 個圖像進行測試

cutoffs = [10, 100, 1000, 10000, 100000] images = np.concatenate((images, images), axis=0) labels = np.concatenate((labels, labels), axis=0) # 確保有 100,000 個圖像和標簽 print(np.shape(images)) print(np.shape(labels))

創建一個計算方式進行對比

_store_many_funcs = dict(

disk=store_many_disk, lmdb=store_many_lmdb, hdf5=store_many_hdf5

)

from timeit import timeit

store_many_timings = {"disk": [], "lmdb": [], "hdf5": []}

for cutoff in cutoffs:

for method in ("disk", "lmdb", "hdf5"):

t = timeit(

"_store_many_funcs[method](images_, labels_)",

setup="images_=images[:cutoff]; labels_=labels[:cutoff]",

number=1,

globals=globals(),

)

store_many_timings[method].append(t)

# 打印出方法、截止時間和使用時間

print(f"Method: {method}, Time usage: {t}")PLOT 顯示具有多個數據集和匹配圖例的單個圖

import matplotlib.pyplot as plt

def plot_with_legend(

x_range, y_data, legend_labels, x_label, y_label, title, log=False

):

""" 參數:

--------------

x_range 包含 x 數據的列表

y_data 包含 y 值的列表

legend_labels 字符串圖例標簽列表

x_label x 軸標簽

y_label y 軸標簽

"""

plt.style.use("seaborn-whitegrid")

plt.figure(figsize=(10, 7))

if len(y_data) != len(legend_labels):

raise TypeError(

"數據集的數量與標簽的數量不匹配"

)

all_plots = []

for data, label in zip(y_data, legend_labels):

if log:

temp, = plt.loglog(x_range, data, label=label)

else:

temp, = plt.plot(x_range, data, label=label)

all_plots.append(temp)

plt.title(title)

plt.xlabel(x_label)

plt.ylabel(y_label)

plt.legend(handles=all_plots)

plt.show()

# Getting the store timings data to display

disk_x = store_many_timings["disk"]

lmdb_x = store_many_timings["lmdb"]

hdf5_x = store_many_timings["hdf5"]

plot_with_legend(

cutoffs,

[disk_x, lmdb_x, hdf5_x],

["PNG files", "LMDB", "HDF5"],

"Number of images",

"Seconds to store",

"Storage time",

log=False,

)

plot_with_legend(

cutoffs,

[disk_x, lmdb_x, hdf5_x],

["PNG files", "LMDB", "HDF5"],

"Number of images",

"Seconds to store",

"Log storage time",

log=True,

)

def read_single_disk(image_id):

""" 參數:

---------------

image_id 圖像的整數唯一 ID

返回結果:

---------------

images 圖像數組 (N, 32, 32, 3) 格式

labels 標簽數組 (N,1) 格式

"""

image = np.array(Image.open(disk_dir / f"{image_id}.png"))

with open(disk_dir / f"{image_id}.csv", "r") as csvfile:

reader = csv.reader(

csvfile, delimiter=" ", quotechar="|", quoting=csv.QUOTE_MINIMAL

)

label = int(next(reader)[0])

return image, labeldef read_single_lmdb(image_id):

""" 參數:

---------------

image_id 圖像的整數唯一 ID

返回結果:

---------------

images 圖像數組 (N, 32, 32, 3) 格式

labels 標簽數組 (N,1) 格式

"""

# 打開 LMDB 環境

env = lmdb.open(str(lmdb_dir / f"single_lmdb"), readonly=True)

# 開始一個新的事務

with env.begin() as txn:

# 進行編碼

data = txn.get(f"{image_id:08}".encode("ascii"))

# 加載的 CIFAR_Image 對象

cifar_image = pickle.loads(data)

# 檢索相關位

image = cifar_image.get_image()

label = cifar_image.label

env.close()

return image, labeldef read_single_hdf5(image_id):

""" 參數:

---------------

image_id 圖像的整數唯一 ID

返回結果:

---------------

images 圖像數組 (N, 32, 32, 3) 格式

labels 標簽數組 (N,1) 格式

"""

# 打開 HDF5 文件

file = h6py.File(hdf5_dir / f"{image_id}.h6", "r+")

image = np.array(file["/image"]).astype("uint8")

label = int(np.array(file["/meta"]).astype("uint8"))

return image, labelfrom timeit import timeit

read_single_timings = dict()

for method in ("disk", "lmdb", "hdf5"):

t = timeit(

"_read_single_funcs[method](0)",

setup="image=images[0]; label=labels[0]",

number=1,

globals=globals(),

)

read_single_timings[method] = t

print(f"讀取方法: {method}, 使用耗時: {t}")| 存儲方法 | 存儲耗時 |

|---|---|

| Disk | 1.7 ms |

| LMDB | 4.4 ms |

| HDF5 | 2.3 ms |

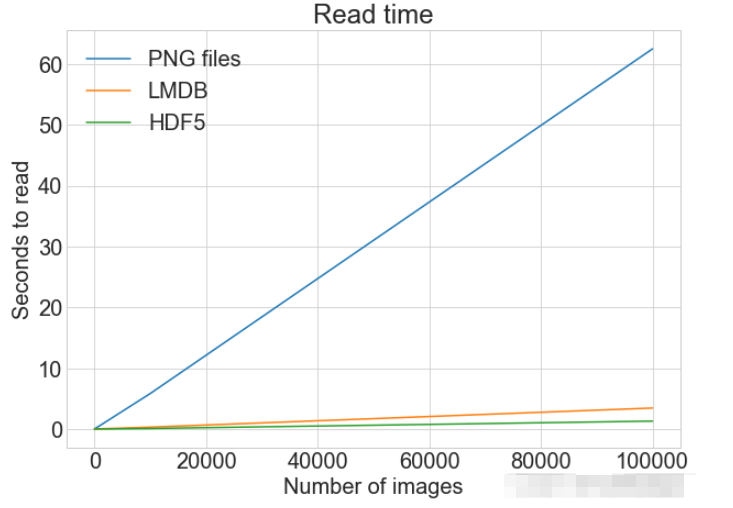

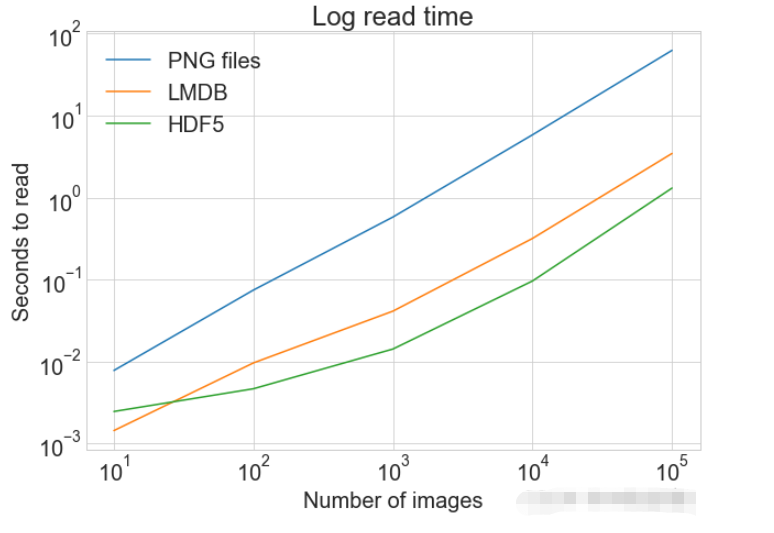

將多個圖像保存為.png文件就可以理解為多次調用 read_single_method() 這樣。但這不適用于 LMDB 或 HDF5,因為每個圖像都有不同的數據庫文件。

從磁盤中讀取多個都圖像

def read_many_disk(num_images):

""" 參數:

---------------

num_images 要讀取的圖像數量

返回結果:

---------------

images 圖像數組 (N, 32, 32, 3) 格式

labels 標簽數組 (N,1) 格式

"""

images, labels = [], []

# 循環遍歷所有ID,一張一張地讀取每張圖片

for image_id in range(num_images):

images.append(np.array(Image.open(disk_dir / f"{image_id}.png")))

with open(disk_dir / f"{num_images}.csv", "r") as csvfile:

reader = csv.reader(

csvfile, delimiter=" ", quotechar="|", quoting=csv.QUOTE_MINIMAL

)

for row in reader:

labels.append(int(row[0]))

return images, labels從LMDB中讀取多個都圖像

def read_many_lmdb(num_images):

""" 參數:

---------------

num_images 要讀取的圖像數量

返回結果:

---------------

images 圖像數組 (N, 32, 32, 3) 格式

labels 標簽數組 (N,1) 格式

"""

images, labels = [], []

env = lmdb.open(str(lmdb_dir / f"{num_images}_lmdb"), readonly=True)

# 開始一個新的事務

with env.begin() as txn:

# 在一個事務中讀取,也可以拆分成多個事務分別讀取

for image_id in range(num_images):

data = txn.get(f"{image_id:08}".encode("ascii"))

# CIFAR_Image 對象,作為值存儲

cifar_image = pickle.loads(data)

# 檢索相關位

images.append(cifar_image.get_image())

labels.append(cifar_image.label)

env.close()

return images, labels從HDF5中讀取多個都圖像

def read_many_hdf5(num_images):

""" 參數:

---------------

num_images 要讀取的圖像數量

返回結果:

---------------

images 圖像數組 (N, 32, 32, 3) 格式

labels 標簽數組 (N,1) 格式

"""

images, labels = [], []

# 打開 HDF5 文件

file = h6py.File(hdf5_dir / f"{num_images}_many.h6", "r+")

images = np.array(file["/images"]).astype("uint8")

labels = np.array(file["/meta"]).astype("uint8")

return images, labels

_read_many_funcs = dict(

disk=read_many_disk, lmdb=read_many_lmdb, hdf5=read_many_hdf5

)創建一個計算方式進行對比

from timeit import timeit

read_many_timings = {"disk": [], "lmdb": [], "hdf5": []}

for cutoff in cutoffs:

for method in ("disk", "lmdb", "hdf5"):

t = timeit(

"_read_many_funcs[method](num_images)",

setup="num_images=cutoff",

number=1,

globals=globals(),

)

read_many_timings[method].append(t)

# Print out the method, cutoff, and elapsed time

print(f"讀取方法: {method}, No. images: {cutoff}, 耗時: {t}")

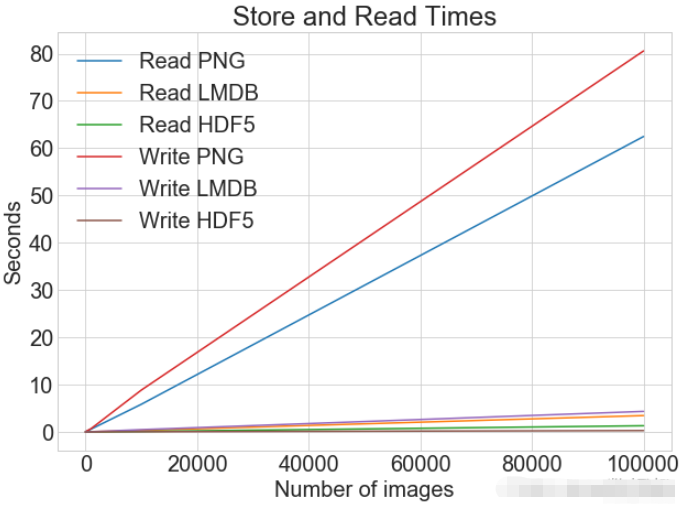

同一張圖表上查看讀取和寫入時間

plot_with_legend( cutoffs, [disk_x_r, lmdb_x_r, hdf5_x_r, disk_x, lmdb_x, hdf5_x], [ "Read PNG", "Read LMDB", "Read HDF5", "Write PNG", "Write LMDB", "Write HDF5", ], "Number of images", "Seconds", "Log Store and Read Times", log=False, )

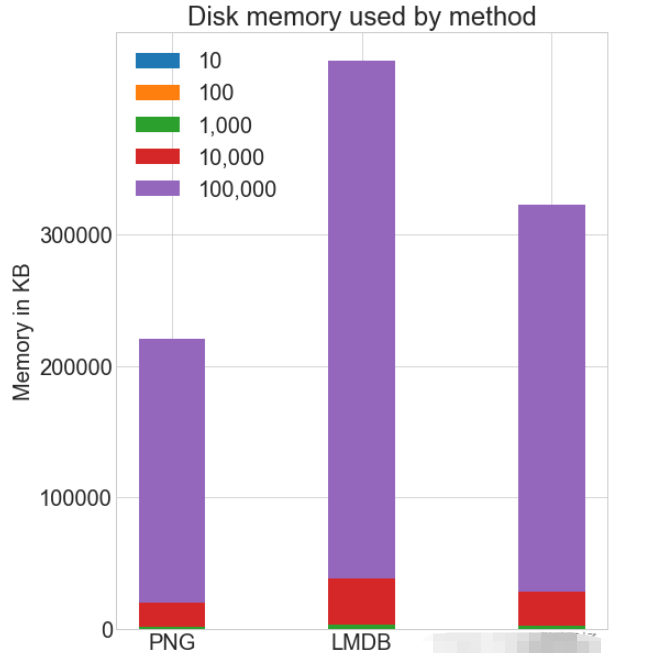

各種存儲方式使用磁盤空間

雖然 HDF5 和 LMDB 都占用更多的磁盤空間。需要注意的是 LMDB 和 HDF5 磁盤的使用和性能在很大程度上取決于各種因素,包括操作系統,更重要的是存儲的數據大小。

通常對于大的數據集,可以通過并行化來加速操作。 也就是我們經常說的并發處理。

作為.png 文件存儲到磁盤實際上允許完全并發。只要圖像名稱不同就可以從不同的線程讀取多個圖像,或一次寫入多個文件。

如果將所有 CIFAR 分成十組,那么可以為一組中的每個讀取設置十個進程,并且相應的處理時間可以減少到原來的10%左右。

以上就是“Python圖片存儲和訪問的三種方式是什么”這篇文章的所有內容,感謝各位的閱讀!相信大家閱讀完這篇文章都有很大的收獲,小編每天都會為大家更新不同的知識,如果還想學習更多的知識,請關注億速云行業資訊頻道。

免責聲明:本站發布的內容(圖片、視頻和文字)以原創、轉載和分享為主,文章觀點不代表本網站立場,如果涉及侵權請聯系站長郵箱:is@yisu.com進行舉報,并提供相關證據,一經查實,將立刻刪除涉嫌侵權內容。