您好,登錄后才能下訂單哦!

您好,登錄后才能下訂單哦!

這篇文章主要介紹“怎么用opencv實現人臉檢測和眼睛檢測功能”,在日常操作中,相信很多人在怎么用opencv實現人臉檢測和眼睛檢測功能問題上存在疑惑,小編查閱了各式資料,整理出簡單好用的操作方法,希望對大家解答”怎么用opencv實現人臉檢測和眼睛檢測功能”的疑惑有所幫助!接下來,請跟著小編一起來學習吧!

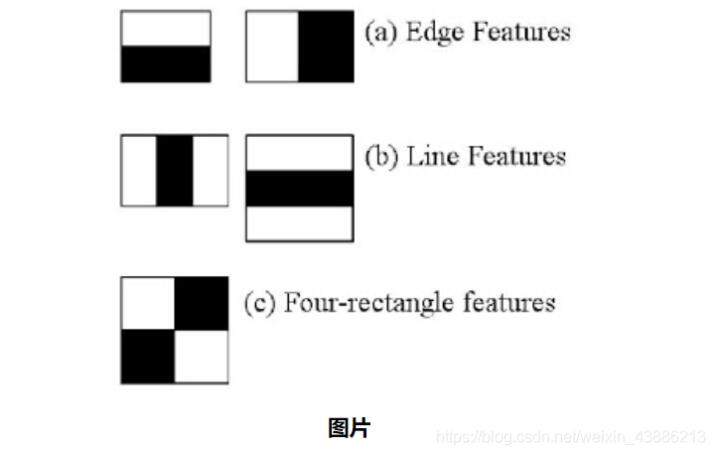

在這里,我們將進行人臉檢測。最初,該算法需要大量正圖像(面部圖像)和負圖像(無面部圖像)來訓練分類器。然后,我們需要從中提取特征。為此,使用下圖所示的Haar功能。它們就像我們的卷積核。每個特征都是通過從黑色矩形下的像素總和中減去白色矩形下的像素總和而獲得的單個值。

現在,每個內核的所有可能大小和位置都用于計算許多功能。(試想一下它需要多少計算?即使是一個24x24的窗口也會產生超過160000個特征)。對于每個特征計算,我們需要找到白色和黑色矩形下的像素總和。為了解決這個問題,他們引入了整體形象。無論您的圖像有多大,它都會將給定像素的計算減少到僅涉及四個像素的操作。很好,不是嗎?它使事情變得超快。

但是在我們計算的所有這些功能中,大多數都不相關。例如,考慮下圖。第一行顯示了兩個良好的功能。選擇的第一個特征似乎著眼于眼睛區域通常比鼻子和臉頰區域更暗的性質。選擇的第二個功能依賴于眼睛比鼻梁更黑的屬性。但是,將相同的窗口應用于臉頰或其他任何地方都是無關緊要的。那么,我們如何從16萬多個功能中選擇最佳功能?它是由Adaboost實現的。

為此,我們將所有功能應用于所有訓練圖像。對于每個功能,它會找到最佳的閾值,該閾值會將人臉分為正面和負面。顯然,會出現錯誤或分類錯誤。我們選擇錯誤率最低的特征,這意味著它們是對人臉和非人臉圖像進行最準確分類的特征。(此過程并非如此簡單。在開始時,每個圖像的權重均相等。在每次分類后,錯誤分類的圖像的權重都會增加。然后執行相同的過程。將計算新的錯誤率。還要計算新的權重。繼續進行此過程,直到達到所需的精度或錯誤率或找到所需的功能數量為止。

最終分類器是這些弱分類器的加權和。之所以稱為弱分類,是因為僅憑它不能對圖像進行分類,而是與其他分類一起形成強分類器。該論文說,甚至200個功能都可以提供95%的準確度檢測。他們的最終設置具有大約6000個功能。(想象一下,從160000多個功能減少到6000個功能。這是很大的收獲)。

因此,現在您拍攝一張照片。取每個24x24窗口。向其應用6000個功能。檢查是否有臉。哇…這不是效率低下又費時嗎?是的。作者對此有一個很好的解決方案。

在圖像中,大多數圖像是非面部區域。因此,最好有一種簡單的方法來檢查窗口是否不是面部區域。如果不是,請一次性丟棄它,不要再次對其進行處理。相反,應將重點放在可能有臉的區域。這樣,我們將花費更多時間檢查可能的面部區域。

為此,他們引入了級聯分類器的概念。不是將所有6000個功能部件應用到一個窗口中,而是將這些功能部件分組到不同階段的分類器中,并一一應用。(通常前幾個階段將包含很少的功能)。如果窗口在第一階段失敗,則將其丟棄。我們不考慮它的其余功能。如果通過,則應用功能的第二階段并繼續該過程。經過所有階段的窗口是一個面部區域。這個計劃怎么樣!

作者的檢測器具有6000多個特征,具有38個階段,在前五個階段具有1、10、25、25和50個特征。(上圖中的兩個功能實際上是從Adaboost獲得的最佳兩個功能)。根據作者的說法,每個子窗口平均評估了6000多個特征中的10個特征。

首先,創建一個cv :: CascadeClassifier并使用cv :: CascadeClassifier :: load方法加載必要的XML文件。然后,使用cv :: CascadeClassifier :: detectMultiScale方法完成檢測,該方法返回檢測到的臉部或眼睛的邊界矩形

from __future__ import print_function

import cv2 as cv

import argparse

def detectAndDisplay(frame):

frame_gray = cv.cvtColor(frame, cv.COLOR_BGR2GRAY)#灰度處理

frame_gray = cv.equalizeHist(frame_gray)#直方圖均衡化

#-- Detect faces

faces = face_cascade.detectMultiScale(frame_gray)

for (x,y,w,h) in faces:

center = (x + w//2, y + h//2)#獲取方框中心位置

frame = cv.ellipse(frame, center, (w//2, h//2), 0, 0, 360, (255, 0, 255), 4)#畫橢圓

faceROI = frame_gray[y:y+h,x:x+w]#獲取感興趣的區域,即人臉矩形

#-- In each face, detect eyes

eyes = eyes_cascade.detectMultiScale(faceROI)

for (x2,y2,w2,h3) in eyes:

eye_center = (x + x2 + w2//2, y + y2 + h3//2)#獲取眼睛中心

radius = int(round((w2 + h3)*0.25))#獲取半徑

frame = cv.circle(frame, eye_center, radius, (255, 0, 0 ), 4)

cv.imshow('Capture - Face detection', frame)

parser = argparse.ArgumentParser(description='Code for Cascade Classifier tutorial.')

parser.add_argument('--face_cascade', help='Path to face cascade.', default='haarcascades/haarcascade_frontalface_alt.xml')

parser.add_argument('--eyes_cascade', help='Path to eyes cascade.', default='haarcascades/haarcascade_eye_tree_eyeglasses.xml')

parser.add_argument('--camera', help='Camera divide number.', type=int, default=0)

args = parser.parse_args()

face_cascade_name = args.face_cascade

eyes_cascade_name = args.eyes_cascade

face_cascade = cv.CascadeClassifier()

eyes_cascade = cv.CascadeClassifier()

#-- 1. Load the cascades

if not face_cascade.load(cv.samples.findFile(face_cascade_name)):

print('--(!)Error loading face cascade')

exit(0)

if not eyes_cascade.load(cv.samples.findFile(eyes_cascade_name)):

print('--(!)Error loading eyes cascade')

exit(0)

camera_device = args.camera

#-- 2. Read the video stream

cap = cv.VideoCapture(camera_device)

if not cap.isOpened:

print('--(!)Error opening video capture')

exit(0)

while True:

ret, frame = cap.read()

if frame is None:

print('--(!) No captured frame -- Break!')

break

detectAndDisplay(frame)

if cv.waitKey(10) == 27:

break到此,關于“怎么用opencv實現人臉檢測和眼睛檢測功能”的學習就結束了,希望能夠解決大家的疑惑。理論與實踐的搭配能更好的幫助大家學習,快去試試吧!若想繼續學習更多相關知識,請繼續關注億速云網站,小編會繼續努力為大家帶來更多實用的文章!

免責聲明:本站發布的內容(圖片、視頻和文字)以原創、轉載和分享為主,文章觀點不代表本網站立場,如果涉及侵權請聯系站長郵箱:is@yisu.com進行舉報,并提供相關證據,一經查實,將立刻刪除涉嫌侵權內容。