您好,登錄后才能下訂單哦!

您好,登錄后才能下訂單哦!

這篇文章主要介紹了如何實現opencv-python圖像配準,具有一定借鑒價值,感興趣的朋友可以參考下,希望大家閱讀完這篇文章之后大有收獲,下面讓小編帶著大家一起了解一下。

圖像配準需是指對不同條件下得到的兩幅或多幅圖像進行匹配、疊加的過程。最簡單的做法就是求得原圖像到目標圖像之間的透視變換矩陣,將原圖像按照矩陣進行變換,就可以得到和目標圖像相似的效果。透視變換是將成像投影到一個新的視平面,也稱作投影映射。

透視變換實質上是將二維的圖片變換到三維的坐標系中之后再變換到另一個二維坐標系,與仿射變換相比透視變換實現的效果要多一些。求解精確矩陣和透視變換可以很容易地在opencv-python中實現。

import cv2 as cv

import numpy as np

import matplotlib.pyplot as plt

original_image = cv.imread("Image A.jpg")

target_image = cv.imread("Image B.jpg")

# 生成透視矩陣

src_points = np.array([[957, 1655], [2177, 1170], [2676, 24], [2487, 1931]], dtype=np.float32)

den_points = np.array([[687, 1150], [2000, 996], [2757, 18], [2098, 1819]], dtype=np.float32)

# getPerspectiveTransform可以得到從點集src_points到點集den_points的透視變換矩陣

T = cv.getPerspectiveTransform(src_points, den_points)

# 進行透視變換

# 注意透視變換第三個參數為變換后圖片大小,格式為(高度,寬度)

warp_imgae = cv.warpPerspective(original_image, T, (target_image.shape[1], target_image.shape[0]))

plt.imshow(warp_imgae)

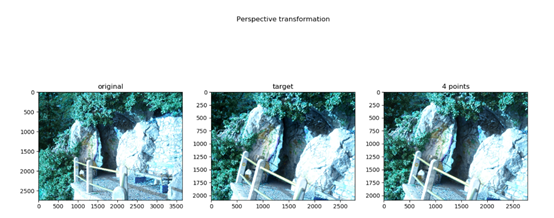

plt.show()進行四點變換前后的結果為

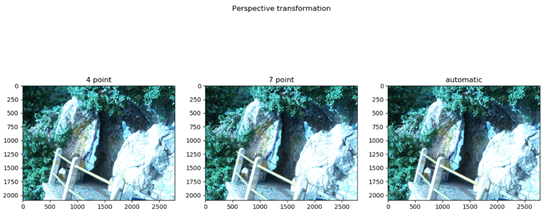

opencv-python也可以計算超過四個點的兩數組點之間的變換矩陣。對原圖像選擇7個點進行透視變換的結果為

# 設置原始和目標特征點 src_more_point = np.float32([[957, 1655], [2177, 1170], [620, 2586], [1280, 2316], [2487, 1931], [937, 758], [2676, 24]]).reshape(-1, 1, 2) den_more_point = np.float32([[687, 1150], [2000, 996], [121, 1974], [927, 1886], [2098, 1819], [899, 280], [2757, 18]]).reshape(-1, 1, 2) # 調用庫函數計算特征矩陣 # cv.findHomography第三個參數為計算單位矩陣所用的方法,0為常規算法,cv.RANSAC為基于RANSAC的魯棒算法,cv.LMEDS為最小中值 # 魯棒算法,cv.RHO基于PROSAC的魯棒算法.第四個參數取值范圍在1到10,絕一個點對的閾值。原圖像的點經過變換后點與目標圖像上對應 # 點的誤差.返回值中H為變換矩陣.mask是掩模,在線的點. H, status = cv.findHomography(src_more_point, den_more_point, cv.RANSAC, 5.0) # 進行透視變換 warped_more_point_image = cv.warpPerspective(original_image, H, (target_image.shape[1], target_image.shape[0]))

對4個點、7個點和opencv-python函數庫自動匹配的效果對比如下

可以看出如果匹配點選擇恰當,三種方法的效果并沒有太大區別。

調用庫函數的圖像自動匹配代碼如下

# 用AKAZE庫函數進行自動特征檢測,AKAZE與SIFT等屬于相似的 特征檢測,但是有一些不同

akaze = cv.AKAZE_create()

# Find the keypoints and descriptors with SIFT

kp1, des1 = akaze.detectAndCompute(original_image_gray, None)

kp2, des2 = akaze.detectAndCompute(target_image_gray, None)

bf = cv.BFMatcher()

matches = bf.knnMatch(des1, des2, k=2)

good_matches = []

for m, n in matches:

if m.distance < 0.75 * n.distance:

good_matches.append([m])

# 畫出符合條件的匹配點的連線

img3 = cv.drawMatchesKnn(original_image_gray, kp1, target_image_gray, kp2, good_matches, None, flags=cv.DrawMatchesFlags_NOT_DRAW_SINGLE_POINTS)

cv.imwrite('matches.jpg', img3)

src_automatic_points = np.float32([kp1[m[0].queryIdx].pt for m in good_matches]).reshape(-1, 1, 2)

den_automatic_points = np.float32([kp2[m[0].trainIdx].pt for m in good_matches]).reshape(-1, 1, 2)

# 調用庫函數計算特征矩陣

H, status = cv.findHomography(src_more_point, den_more_point, cv.RANSAC, 5.0)

# 進行透視變換

warped_automatic_image = cv.warpPerspective(original_image, H, (target_image.shape[1], target_image.shape[0]))

# 繪制圖像

my_draw(warped_automatic_image, tip='automatic')感謝你能夠認真閱讀完這篇文章,希望小編分享的“如何實現opencv-python圖像配準”這篇文章對大家有幫助,同時也希望大家多多支持億速云,關注億速云行業資訊頻道,更多相關知識等著你來學習!

免責聲明:本站發布的內容(圖片、視頻和文字)以原創、轉載和分享為主,文章觀點不代表本網站立場,如果涉及侵權請聯系站長郵箱:is@yisu.com進行舉報,并提供相關證據,一經查實,將立刻刪除涉嫌侵權內容。