溫馨提示×

您好,登錄后才能下訂單哦!

點擊 登錄注冊 即表示同意《億速云用戶服務條款》

您好,登錄后才能下訂單哦!

這篇文章給大家分享的是有關如何使用Selenium操作谷歌瀏覽器抓取多頁的數據并將結果保存到CSV文件中的內容。小編覺得挺實用的,因此分享給大家做個參考,一起跟隨小編過來看看吧。

首先我們查看被抓取的網址中一共包含了5頁內容:

我們修改上一篇文章的代碼來實現今天的功能,接下來開始:

#導入包from selenium import webdriverimport csv#定義分頁總數MAX_PAGE_NUM = 5#定義分頁數字位數MAX_PAGE_DIG = 3#打開谷歌瀏覽器 并訪問要抓取數據的地址#注意:驅動chromedriver.exe與改python文件在同一個目錄driver = webdriver.Chrome('chromedriver.exe')#創建csv文件進行寫入csv_file = open('results.csv', 'w')csv_writer = csv.writer(csv_file)#寫入csv標題頭內容csv_writer.writerow(['購買者', '商品價格'])for i in range(1, MAX_PAGE_NUM + 1):#獲取分頁url中的數字內容:001 002...004 005page_num = (MAX_PAGE_DIG - len(str(i))) * "0" + str(i)url = "http://econpy.pythonanywhere.com/ex/" + page_num + ".html"driver.get(url)# 使用xpath找到購買者和商品價格元素列表buyers = driver.find_elements_by_xpath('//div[@title="buyer-name"]')prices = driver.find_elements_by_xpath('//span[@class="item-price"]')# 打印所有信息num_page_items = len(buyers)for i in range(num_page_items):#數據寫入csv文件csv_writer.writerow([buyers[i].text, prices[i].text])#完成任務后 關閉瀏覽器driver.close()

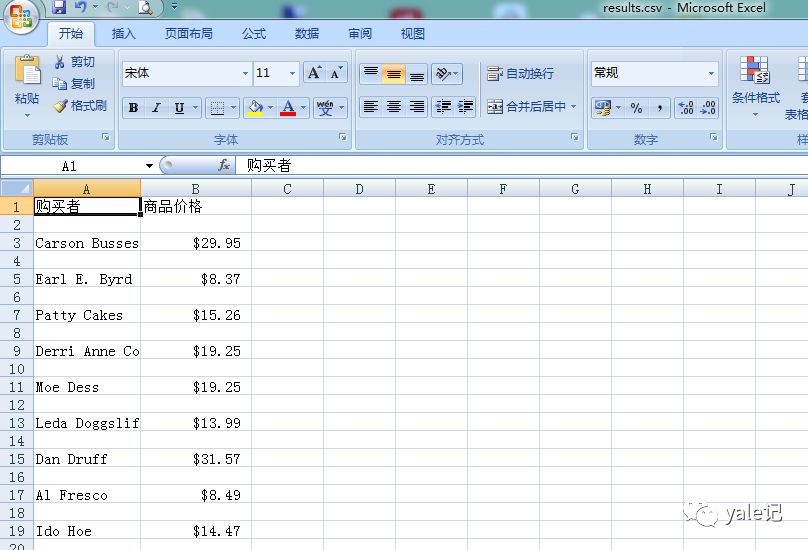

運行后會生成一個results.csv文件內容截圖為:

過程為運行程序-打開谷歌瀏覽器-一次訪問每個分頁的地址然后抓取數據保存到csv文件中-關閉瀏覽器完成。

感謝各位的閱讀!關于“如何使用Selenium操作谷歌瀏覽器抓取多頁的數據并將結果保存到CSV文件中”這篇文章就分享到這里了,希望以上內容可以對大家有一定的幫助,讓大家可以學到更多知識,如果覺得文章不錯,可以把它分享出去讓更多的人看到吧!

免責聲明:本站發布的內容(圖片、視頻和文字)以原創、轉載和分享為主,文章觀點不代表本網站立場,如果涉及侵權請聯系站長郵箱:is@yisu.com進行舉報,并提供相關證據,一經查實,將立刻刪除涉嫌侵權內容。