您好,登錄后才能下訂單哦!

您好,登錄后才能下訂單哦!

本文主要介紹在磁盤 I/O 性能的概念以及相關的指標,并介紹 AIX 系統下,衡量和監控磁盤 I/O 性能的方法,以及在 AIX 下,常見的可調整參數。

I/O 的概念,從字義來理解就是輸入輸出。操作系統從上層到底層,各個層次之間均存在 I/O。比如,CPU 有 I/O,內存有 I/O, VMM 有 I/O, 底層磁盤上也有 I/O,這是廣義上的 I/O. 通常來講,一個上層的 I/O 可能會產生針對磁盤的多個 I/O,也就是說,上層的 I/O 是稀疏的,下層的 I/O 是密集的。

磁盤的 I/O,顧名思義就是磁盤的輸入輸出。輸入指的是對磁盤寫入數據,輸出指的是從磁盤讀出數據。

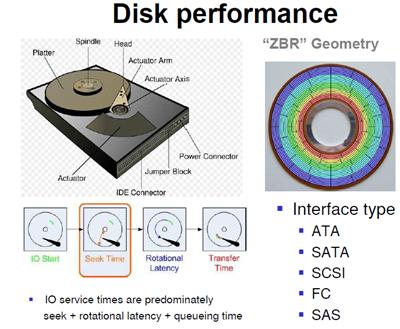

我們常見的磁盤類型有 ATA、SATA、FC、SCSI、SAS。這幾種磁盤中,服務器常用的是 SAS 和 FC 磁盤,一些高端存儲也使用 SSD 盤。每一種磁盤的性能是不一樣的。

我們在測試工作中,衡量磁盤 I/O 性能主要參考 IOPS 和吞吐量兩個參數。下面,將介紹一下這兩個參數的含義。

磁盤的 IOPS,也就是在一秒內,磁盤進行多少次 I/O 讀寫。

磁盤的吞吐量,也就是每秒磁盤 I/O 的流量,即磁盤寫入加上讀出的數據的大小。

每秒 I/O 吞吐量= IOPS* 平均 I/O SIZE。從公式可以看出: I/O SIZE 越大,IOPS 越高,那么每秒 I/O 的吞吐量就越高。因此,我們會認為 IOPS 和吞吐量的數值越高越好。實際上,對于一個磁盤來講,這兩個參數均有其最大值,而且這兩個參數也存在著一定的關系。

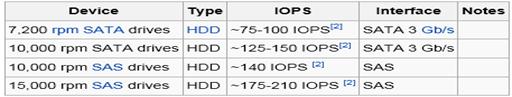

下圖為各種磁盤的 IOPS 極限值。

表 1. 常見磁盤類型及其 IOPS

注:上表源自維基百科 http://en.wikipedia.org/wiki/IOPS

在 AIX 中,對于同一個磁盤(或者 LUN),隨著每次 I/O 讀寫數據的大小不通,IOPS 的數值也不是固定不變的。例如,每次 I/O 寫入或者讀出的都是連續的大數據塊,此時 IOPS 相對會低一些;在不頻繁換道的情況下,每次寫入或者讀出的數據塊小,相對來講 IOPS 就會高一些。

回頁首

大體上講,I/O 的類型可以分為:讀 / 寫 I/O、大 / 小塊 I/O、連續 / 隨機 I/O, 順序 / 并發 I/O。在這幾種類型中,我們主要討論一下:大 / 小塊 I/O、連續 / 隨機 I/O, 順序 / 并發 I/O。

這個數值指的是控制器指令中給出的連續讀出扇區數目的多少。如果數目較多,如 64,128 等,我們可以認為是大塊 I/O;反之,如果很小,比如 4,8,我們就會認為是小塊 I/O,實際上,在大塊和小塊 I/O 之間,沒有明確的界限。

連續 I/O 指的是本次 I/O 給出的初始扇區地址和上一次 I/O 的結束扇區地址是完全連續或者相隔不多的。反之,如果相差很大,則算作一次隨機 I/O

連續 I/O 比隨機 I/O 效率高的原因是:在做連續 I/O 的時候,磁頭幾乎不用換道,或者換道的時間很短;而對于隨機 I/O,如果這個 I/O 很多的話,會導致磁頭不停地換道,造成效率的極大降低。

從概念上講,并發 I/O 就是指向一塊磁盤發出一條 I/O 指令后,不必等待它回應,接著向另外一塊磁盤發 I/O 指令。對于具有條帶性的 RAID(LUN),對其進行的 I/O 操作是并發的,例如:raid 0+1(1+0),raid5 等。反之則為順序 I/O。

回頁首

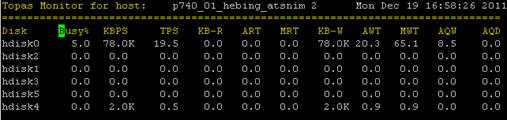

監控磁盤的 I/O 性能,我們可以使用 AIX 的系統命令,例如:sar -d, iostat, topas, nmon 等。下面,我將以 nmon 和 topas 為例,講述在系統中如何觀察磁盤 I/O 的性能。

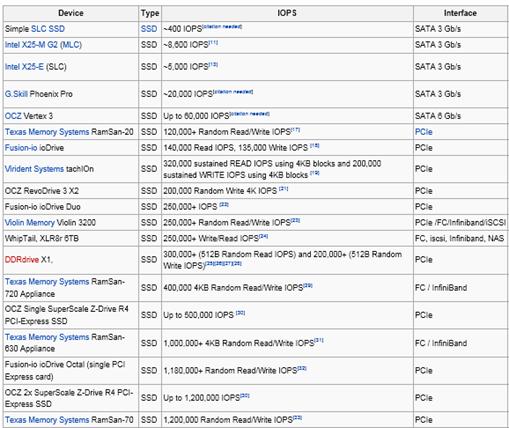

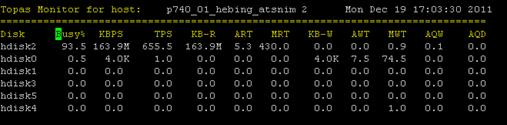

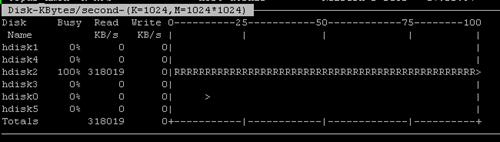

登錄 AIX 操作系統,輸入 topas,然后按 D,會出現如下界面:

在上圖中,TPS 即為磁盤的 IOPS,KBPS 即為磁盤每秒的吞吐量。由于服務器處于空閑的狀態,我們可以看到 IOPS,KBPS 的數據都非常低。

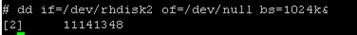

我們使用 dd if 命令向磁盤 hdisk2 發讀 I/O,block 大小為 1MB:

利用 topas 進行監控:

此時,hdisk2 的吞吐量為 163.9M,IOPS 為 655。

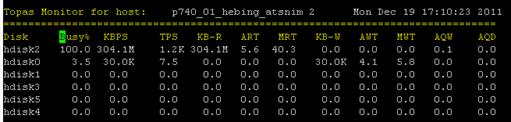

我們再啟動一個 dd if,使 hdisk 的 busy 數值達到 100%:

從上圖可以看出,在磁盤 busy 達到 100% 的時候,其吞吐量為 304.1M,IOPS 為 1200。

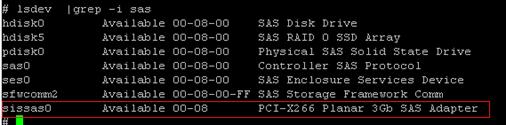

hdisk2 是本地集成的 SAS 盤,我們可以查出本地集成 SAS 通道的帶寬為 3Gb:

對于 3Gb 的 SAS 通道,304.1M 的磁盤吞吐量已經接近其 I/O 帶寬的峰值了。

需要指出的是,使用 dd if 測量磁盤的帶寬是可行的,但是由此來確定業務 I/O 的 IOPS 和吞吐量是不科學的。因為,dd if 所發起的讀寫僅為順序 I/O 讀寫,在 OLTP 的業務中,這種讀寫是不常見的,而是隨機小 I/O 比較多,因此,測量業務的磁盤 I/O 性能,需要在運行業務的時候進行監控。

在系統中輸入 nmon,按 d,可以得到如下界面 :

可以得到此時磁盤 hdisk2 吞吐量為 318M。

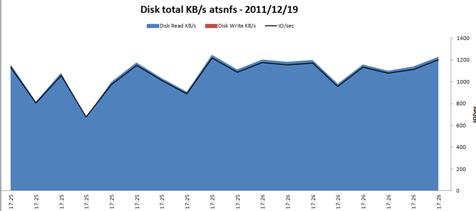

使用 nmon 收集一個時間段的數據,然后使用 nmon analyzer 進行分析,可以得出更為直接的圖表:

將收集好的 nmon 文件使用 nmon analyzer 進行分析,得出如下報表:

圖 2.nmon 圖表顯示磁盤性能

回頁首

對于隨機負載,當遇到余下情況時,我們那通常認為存在 I/O 性能問題:

對于順序負載,當遇到余下情況時,我們那通常認為存在 I/O 性能問題:

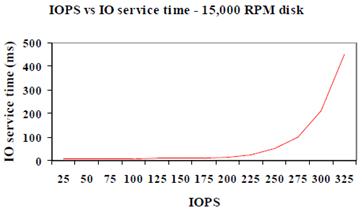

對于一塊磁盤來講,隨著 IOPS 數量的增加,I/O service 也會增加,并且會有一個飽和點,即 IOPS 達到某個點以后,IOPS 再增加將會引起 I/O service time 的顯著增加。

圖 3. 磁盤 IOPS 與 IO service time 關系圖

從經驗上講,我們在測試工作中,我們主要關注 IOPS 和吞吐量以及磁盤的 busy% 這三個數值。如果 IOPS 和吞吐量均很低,磁盤的 busy% 也很低,我們會認為磁盤壓力過小,造成吞吐量和 IOPS 過低;只有在 IOPS 和吞吐量均很低,磁盤的 busy% 很高(接近 100%)的時候,我們才會從磁盤 I/O 方面分析 I/O 性能。

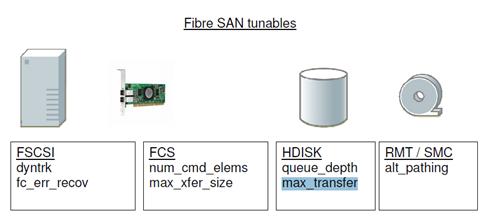

在 AIX 系統中,有關磁盤 I/O 性能相關的參數我們主要調整的參數如下圖:

圖 4.AIX 常見的磁盤 I/O 性能參數

需要注意的是,下面幾個參數的調整值,只是經驗數值;對于不同的應用,不同的場景,應具體情況具體分析。

調整I/O 隊列長度

queue_depth 是 AIX 一次可以傳送到磁盤設備的命令的數量,把命令放在隊列中再傳送給磁盤可以提高 I/O 性能。AIX 中定義的每個磁盤在 ODM 庫中都有 queue_depth 屬性。這個屬性限制了 AIX 可以傳送到設備的最大命令的數量。

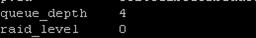

queue_depth 默認數值為 4

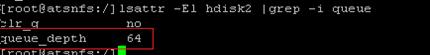

將 hdisk2 的隊列長度從 16 調整為 64:

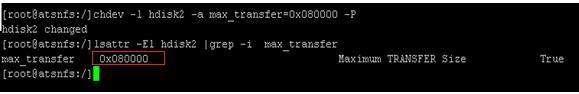

max_transfer 參數

這個參數的含義是,存儲 driver 可以向存儲發的最大的 I/O。通過增加 max_transfer 的數值,我們可以允許 VG 的 LTG 的數值更大。

這個參數我們可以從 64M 調整到 128M。

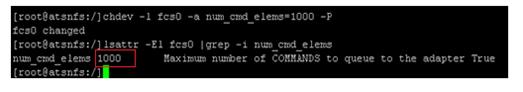

光纖卡num_cmd_elems參數

如果是通過光纖卡連接的外置存儲,可以考慮調整 num_cmd_elems,這個參數的作用是:controls maximum number of in-flight Ios

這個參數的默認值為 500,我們將其修改為 1000:

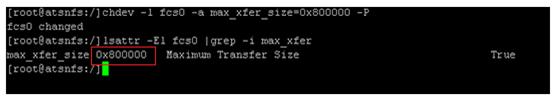

光纖卡 max_xfer_size 參數 : attribute also controls a DMA memory area used to hold data for transfer, and at the default is 16 MB. 這個參數是控制 DMA 區域的,用于保持傳輸的數據的的區域,它的默認值是 16MB,可以把這個數值調整成 128MB,這樣光纖卡的帶寬會高一些 .

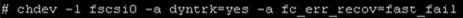

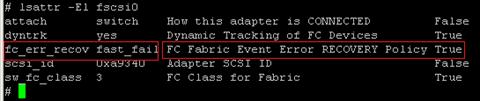

FSCSI 設備

對于 FSCSI 設備而言,我們可以通過設置參數:dyntrk 和 fc_err_recov 來達到路徑快速切換的目的:This sets the adapters to fast fail over and reduces the amount of time required to select a new data path.

修改完畢以后,榮如下命令進行確認:

在 AIX 下調整磁盤 I/O 性能是一個相對復雜的工作,參數的數值往往是根據環境的變化而不通。這就要求我們在熟悉磁盤 I/O 性能架構的基礎上,靈活調整。

免責聲明:本站發布的內容(圖片、視頻和文字)以原創、轉載和分享為主,文章觀點不代表本網站立場,如果涉及侵權請聯系站長郵箱:is@yisu.com進行舉報,并提供相關證據,一經查實,將立刻刪除涉嫌侵權內容。