您好,登錄后才能下訂單哦!

您好,登錄后才能下訂單哦!

作者?| 曾凡松(逐靈)?阿里云容器平臺高級技術專家

本文整理自《CNCF x Alibaba 云原生技術公開課》第 16 講。

導讀:etcd?是用于共享配置和服務發現的分布式、一致性的 KV 存儲系統。本文從 etcd 項目發展所經歷的幾個重要時刻開始,為大家介紹了 etcd 的總體架構及其設計中的基本原理。希望能夠幫助大家更好的理解和使用 etcd。

etcd 誕生于 CoreOS 公司,它最初是用于解決集群管理系統中 OS 升級的分布式并發控制以及配置文件的存儲與分發等問題。基于此,etcd 被設計為提供高可用、強一致的小型 keyvalue 數據存儲服務。

項目當前隸屬于 CNCF 基金會,被 AWS、Google、Microsoft、Alibaba 等大型互聯網公司廣泛使用。

最初,在 2013 年 6 月份由 CoreOS 公司向 GitHub 中提交了第一個版本的初始代碼。

到了 2014 年的 6 月,社區發生了一件事情,Kubernetes v0.4 版本發布。這里有必要介紹一下 Kubernetes 項目,它首先是一個容器管理平臺,由谷歌開發并貢獻給社區,因為它集齊了谷歌在容器調度以及集群管理等領域的多年經驗,從誕生之初就備受矚目。在 Kubernetes v0.4 版本中,它使用了 etcd 0.2 版本作為實驗核心元數據的存儲服務,自此 etcd 社區得到了飛速的發展。

很快,在 2015 年 2 月份,etcd 發布了第一個正式的穩定版本 2.0。在 2.0 版本中,etcd 重新設計了 Raft 一致性算法,并為用戶提供了一個簡單的樹形數據視圖,在 2.0 版本中 etcd 支持每秒超過 1000 次的寫入性能,滿足了當時絕大多數的應用場景需求。2.0 版本發布之后,經過不斷的迭代與改進,其原有的數據存儲方案逐漸成為了新時期的性能瓶頸,之后 etcd 啟動了 v3 版本的方案設計。

2017 年 1 月份的時候,etcd 發布了 3.1 版本,v3 版本方案基本上標志著 etcd 技術上全面成熟。在 v3 版本中 etcd 提供了一套全新的 API,重新實現了更高效的一致性讀取方法,并且提供了一個 gRPC 的 proxy 用于擴展 etcd 的讀取性能。同時,在 v3 版本的方案中包含了大量的 GC 優化,在性能優化方面取得了長足的進步,在該版本中 etcd 可以支持每秒超過 10000 次的寫入。

2018 年,CNCF 基金會下的眾多項目都使用了 etcd 作為其核心的數據存儲。據不完全統計,使用 etcd 的項目超過了 30 個,在同年 11 月份,etcd 項目自身也成為了 CNCF 旗下的孵化項目。進入 CNCF 基金會后,etcd 擁有了超過 400 個貢獻組,其中包含了來自 AWS、Google、Alibaba 等 8 個公司的 9 個項目維護者。

2019 年,etcd 即將發布全新的 3.4 版本,該版本由 Google、Alibaba 等公司聯合打造,將進一步改進 etcd 的性能及穩定性,以滿足在超大型公司使用中苛刻的場景要求。

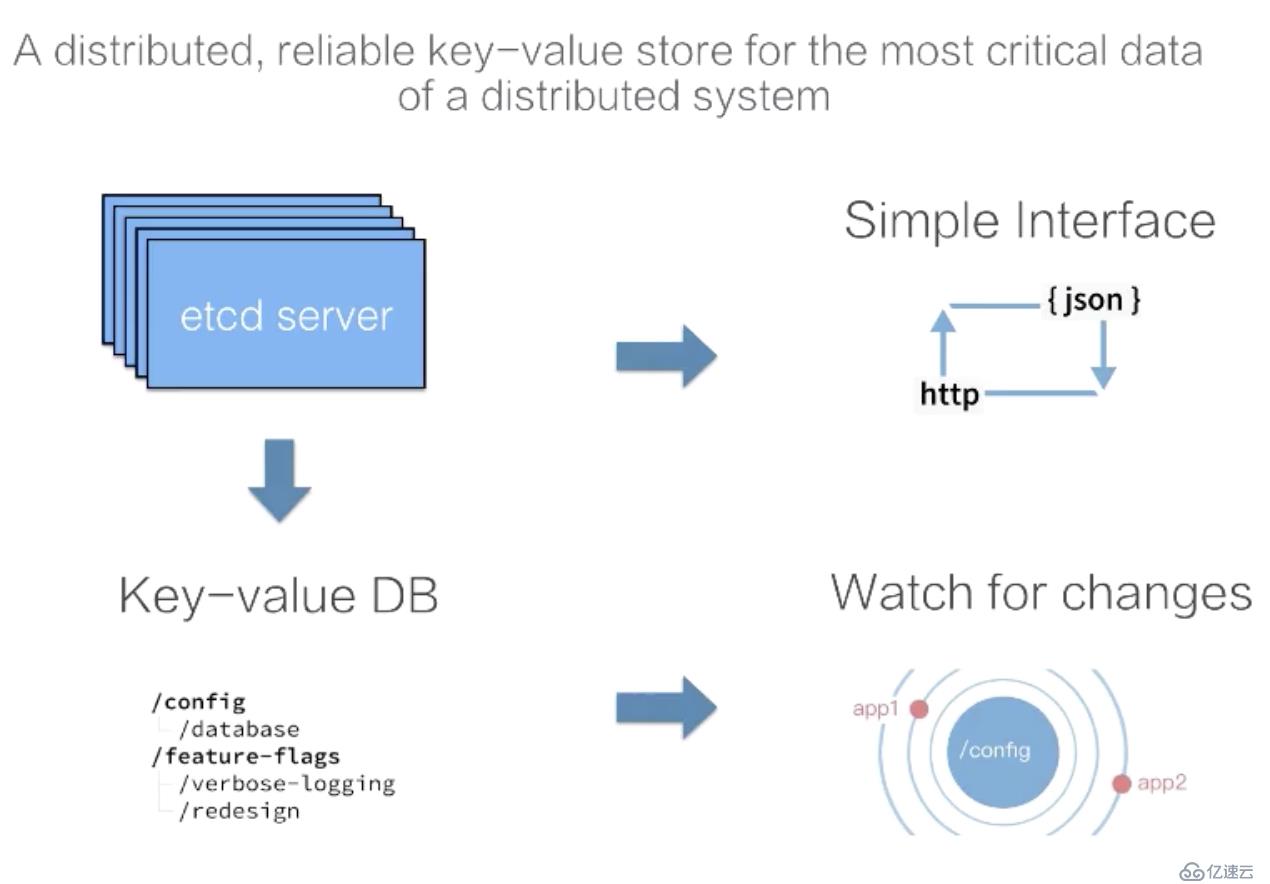

etcd 是一個分布式的、可靠的 key-value 存儲系統,它用于存儲分布式系統中的關鍵數據,這個定義非常重要。

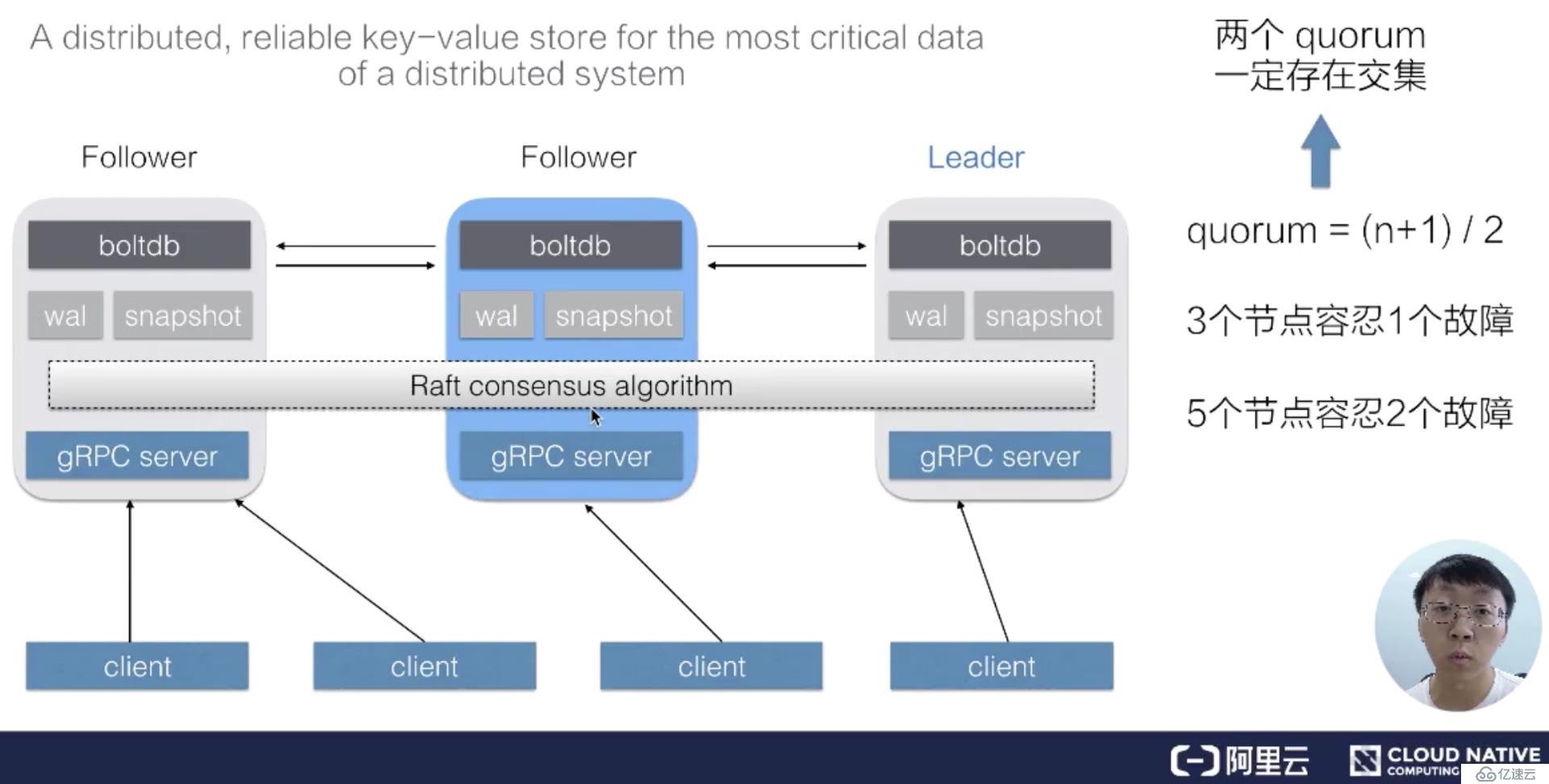

一個 etcd 集群,通常會由 3 個或者 5 個節點組成,多個節點之間通過 Raft 一致性算法的完成分布式一致性協同,算法會選舉出一個主節點作為 leader,由 leader 負責數據的同步與數據的分發。當 leader 出現故障后系統會自動地選取另一個節點成為 leader,并重新完成數據的同步。客戶端在多個節點中,僅需要選擇其中的任意一個就可以完成數據的讀寫,內部的狀態及數據協同由 etcd 自身完成。

在 etcd 整個架構中,有一個非常關鍵的概念叫做 quorum,quorum 的定義是 (n+1)/2,也就是說超過集群中半數節點組成的一個團體,在 3 個節點的集群中,etcd 可以容許 1 個節點故障,也就是只要有任何 2 個節點可用,etcd 就可以繼續提供服務。同理,在 5 個節點的集群中,只要有任何 3 個節點可用,etcd 就可以繼續提供服務,這也是 etcd 集群高可用的關鍵。

在允許部分節點故障之后繼續提供服務,就需要解決一個非常復雜的問題:分布式一致性。在 etcd 中,該分布式一致性算法由 Raft 一致性算法完成,這個算法本身是比較復雜的有機會再詳細展開,這里僅做一個簡單的介紹以方便大家對其有一個基本的認知。Raft 一致性算法能夠工作的一個關鍵點是:任意兩個 quorum 的成員之間一定會有一個交集(公共成員),也就是說只要有任意一個 quorum 存活,其中一定存在某一個節點(公共成員),它包含著集群中所有的被確認提交的數據。正是基于這一原理,Raft 一致性算法設計了一套數據同步機制,在 Leader 任期切換后能夠重新同步上一個 quorum 被提交的所有數據,從而保證整個集群狀態向前推進的過程中保持數據的一致。

etcd 內部的機制比較復雜,但 etcd 給客戶提供的接口是簡單直接的。如上圖所示,我們可以通過 etcd 提供的客戶端去訪問集群的數據,也可以直接通過 http 的方式(類似 curl 命令)直接訪問 etcd。在 etcd 內部,其數據表示也是比較簡單的,我們可以直接把 etcd 的數據存儲理解為一個有序的 map,它存儲著 key-value 數據。同時 etcd 為了方便客戶端去訂閱數據的變更,也支持了一個 watch 機制,通過 watch 實時地拿到 etcd 中數據的增量更新,從而實現與 etcd 中的數據同步等業務邏輯。

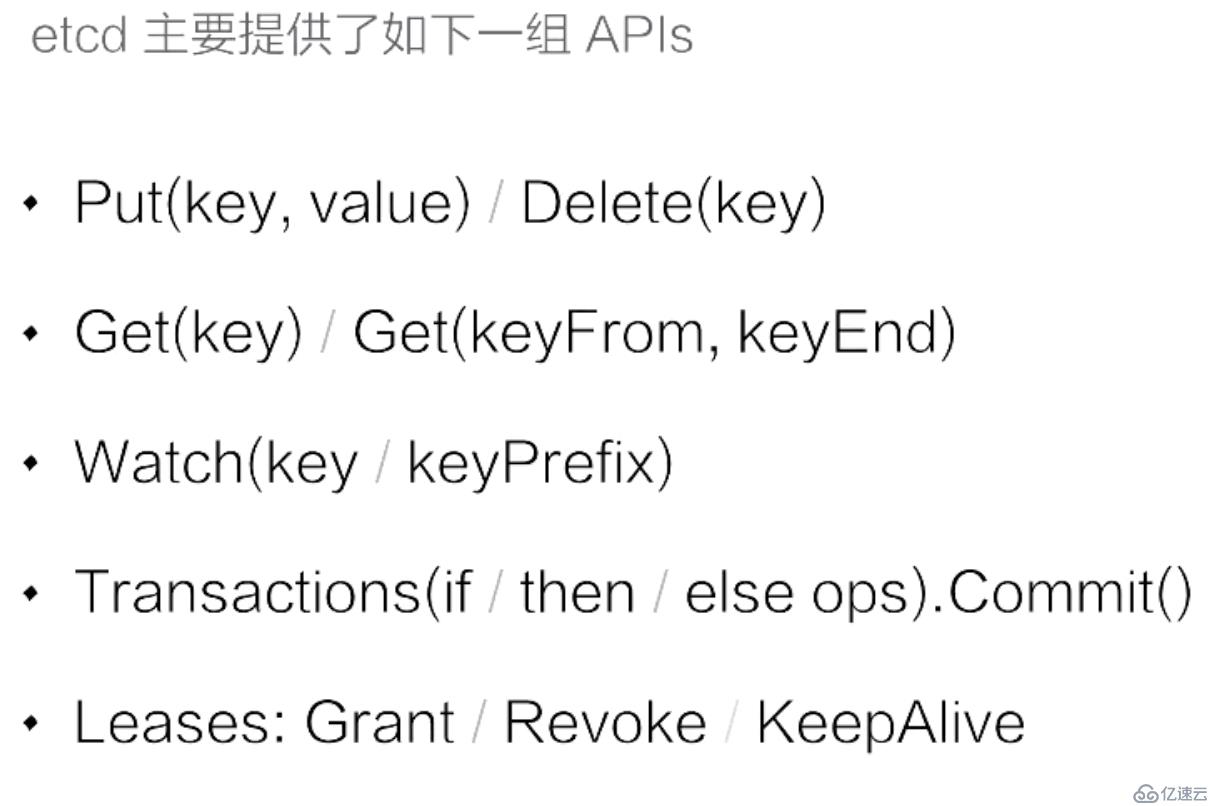

接下來我們看一下 etcd 提供的接口,這里將 etcd 的接口分為了 5 組:

要正確使用 etcd 的 API,必須要知道內部對應數據版本號的基本原理。

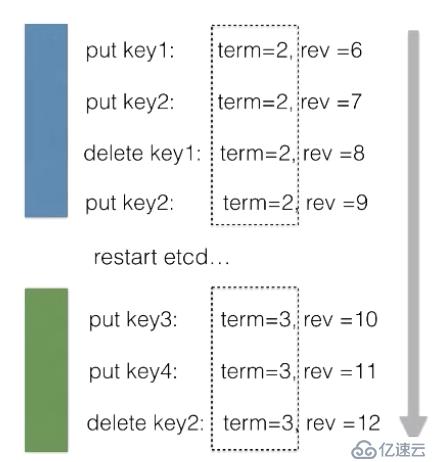

首先 etcd 中有個 term 的概念,代表的是整個集群 Leader 的任期。當集群發生 Leader 切換,term 的值就會 +1。在節點故障,或者 Leader 節點網絡出現問題,再或者是將整個集群停止后再次拉起,都會發生 Leader 的切換。

第二個版本號叫做 revision,revision 代表的是全局數據的版本。當數據發生變更,包括創建、修改、刪除,其 revision 對應的都會 +1。特別的,在集群中跨 Leader 任期之間,revision 都會保持全局單調遞增。正是 revision 的這一特性,使得集群中任意一次的修改都對應著一個唯一的 revision,因此我們可以通過 revision 來支持數據的 MVCC,也可以支持數據的 Watch。

對于每一個 KeyValue 數據節點,etcd 中都記錄了三個版本:

這里可以用圖的方式給大家展示一下:

在同一個 Leader 任期之內,我們發現所有的修改操作,其對應的 term 值始終都等于 2,而 revision 則保持單調遞增。當重啟集群之后,我們會發現所有的修改操作對應的 term 值都變成了 3。在新的 Leader 任期內,所有的 term 值都等于3,且不會發生變化,而對應的 revision 值同樣保持單調遞增。從一個更大的維度去看,可以發現在 term=2 和 term=3 的兩個 Leader 任期之間,數據對應的 revision 值依舊保持了全局單調遞增。

了解 etcd 的版本號控制后,接下來如何使用 etcd 多版本號來實現并發控制以及數據訂閱(Watch)。

在 etcd 中支持對同一個 Key 發起多次數據修改,每次數據修改都對應一個版本號。etcd 在實現上記錄了每一次修改對應的數據,也就就意味著一個 key 在 etcd 中存在多個歷史版本。在查詢數據的時候如果不指定版本號,etcd 會返回 Key 對應的最新版本,當然 etcd 也支持指定一個版本號來查詢歷史數據。

因為 etcd 將每一次修改都記錄了下來,使用 watch 訂閱數據時,可以支持從任意歷史時刻(指定 revision)開始創建一個 watcher,在客戶端與 etcd 之間建立一個數據管道,etcd 會推送從指定 revision 開始的所有數據變更。etcd 提供的 watch 機制保證,該 Key 的數據后續的被修改之后,通過這個數據管道即時的推送給客戶端。

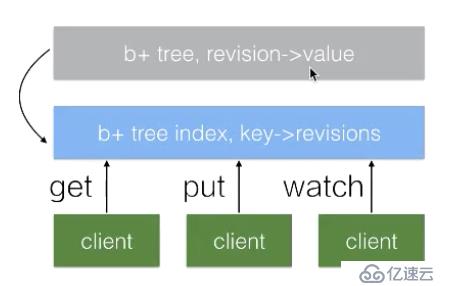

如下圖所示,etcd 中所有的數據都存儲在一個 b+tree 中(灰色),該 b+tree 保存在磁盤中,并通過?mmap 的方式映射到內存用來支持快速的訪問。灰色的 b+tree 中維護著 revision 到 value 的映射關系,支持通過 revision 查詢對應的數據。因為 revision 是單調遞增的,當我們通過 watch 來訂閱指定 revision 之后的數據時,僅需要訂閱該 b+ tree 的數據變化即可。

在 etcd 內部還維護著另外一個 btree(藍色),它管理著 key 到 revision 的映射關系。當客戶端使用 key 查詢數據時,首先需要經過藍色的 btree 將 key 轉化為對應的 revision,再通過灰色的 btree 查詢到對應的數據。

細心的讀者會發現,etcd 將每一次修改都記錄下來會導致數據持續增長,這會帶來內存及磁盤的空間消耗,同時也會影響 b+tree 的查詢效率。為了解決這一問題,在 etcd 中會運行一個周期性的 Compaction 的機制來清理歷史數據,將一段時間之前的同一個 Key 的多個歷史版本數據清理掉。最終的結果是灰色的 b+tree 依舊保持單調遞增,但可能會出現一些空洞。

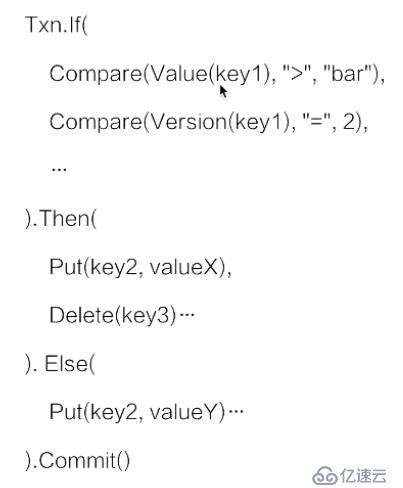

在理解了 mvcc 機制及 watch 機制之后,繼續看 etcd 提供的 mini-transactions 機制。etcd 的 transaction 機制比較簡單,基本可以理解為一段 if-else 程序,在 if 中可以提供多個操作,如下圖所示:

If 里面寫了兩個條件,當 Value(key1) 大于 "bar" 并且 Version(key1) 的版本等于 2 的時候,執行 Then 里面指定的操作:修改 Key2 的數據為 valueX,同時刪除 Key3 的數據。如果不滿足條件,則執行另外一個操作:Key2 修改為 valueY。

在 etcd 內部會保證整個事務操作的原子性。也就是說 If 操作所有的比較條件,其看到的視圖一定是一致的。同時它能夠確保多個操作的原子性不會出現 Then 中的操作僅執行了一半的情況。

通過 etcd 提供的事務操作,我們可以在多個競爭中去保證數據讀寫的一致性,比如說前面已經提到過的 Kubernetes 項目,它正是利用了 etcd 的事務機制,來實現多個 KubernetesAPI server 對同樣一個數據修改的一致性。

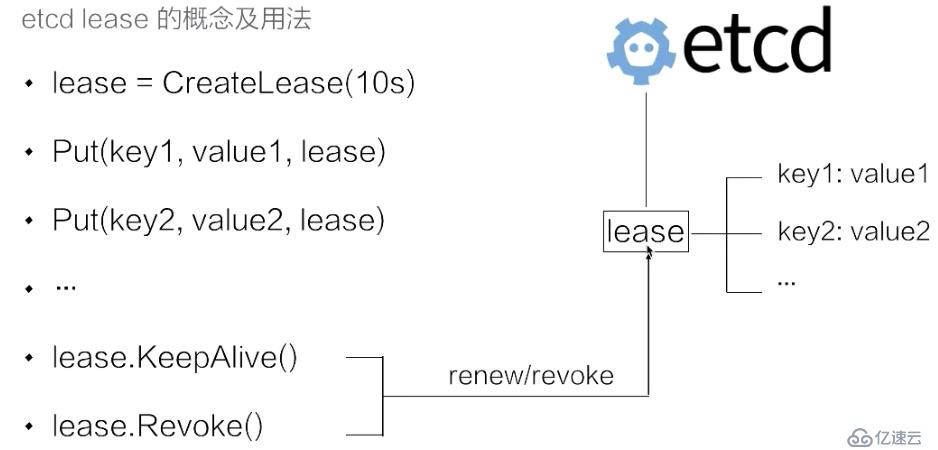

lease 是分布式系統中一個常見的概念,用于代表一個分布式租約。典型情況下,在分布式系統中需要去檢測一個節點是否存活的時,就需要租約機制。

上圖示例中的代碼示例首先創建了一個 10s 的租約,如果創建租約后不做任何的操作,那么 10s 之后,這個租約就會自動過期。接著將 key1 和 key2 兩個 key value 綁定到這個租約之上,這樣當租約過期時 etcd 就會自動清理掉 key1 和 key2,使得節點 key1 和 key2 具備了超時自動刪除的能力。

如果希望這個租約永不過期,需要周期性的調用 KeeyAlive 方法刷新租約。比如說需要檢測分布式系統中一個進程是否存活,可以在進程中去創建一個租約,并在該進程中周期性的調用 KeepAlive 的方法。如果一切正常,該節點的租約會一致保持,如果這個進程掛掉了,最終這個租約就會自動過期。

在 etcd 中,允許將多個 key 關聯在同一個 lease 之上,這個設計是非常巧妙的,可以大幅減少 lease 對象刷新帶來的開銷。試想一下,如果有大量的 key 都需要支持類似的租約機制,每一個 key 都需要獨立的去刷新租約,這會給? etcd 帶來非常大的壓力。通過多個 key 綁定在同一個 lease 的模式,我們可以將超時間相似的 key 聚合在一起,從而大幅減小租約刷新的開銷,在不失靈活性同時能夠大幅提高 etcd 支持的使用規模。

Kubernetes 將自身所用的狀態存儲在 etcd 中,其狀態數據的高可用交給 etcd 來解決,Kubernetes 系統自身不需要再應對復雜的分布式系統狀態處理,自身的系統架構得到了大幅的簡化。

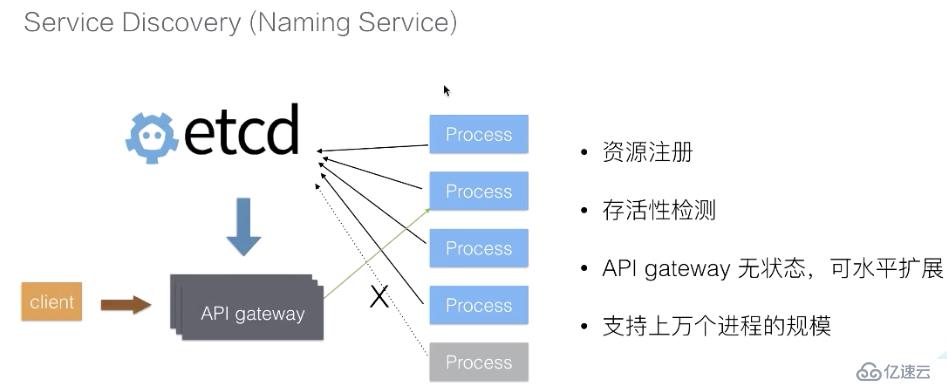

第二個場景是 Service Discovery,也叫做名字服務。在分布式系統中,通常會出現的一個模式就是需要多個后端(可能是成百上千個進程)來提供一組對等的服務,比如說檢索服務、推薦服務。

對于這樣一種后端服務,通常情況下為了簡化后端服務的運維成本(節點故障時隨時被替換),后端的這一進程會被類似 Kubernetes 這樣的集群管理系統所調度,這樣當用戶(或上游服務)調用過來時,我們就需要一個服務發現機制來解決服務路由問題。這一服務發現問題可以利用 etcd 來高效解決,方式如下:

在這一架構中,服務狀態數據被 etcd 接管,API 網關本身也是無狀態的,可以水平地擴展來服務更多的客戶。同時得益于 etcd 的良好性能,可以支持上萬個后端進程的節點,使得這一架構可以服務于大型的企業。

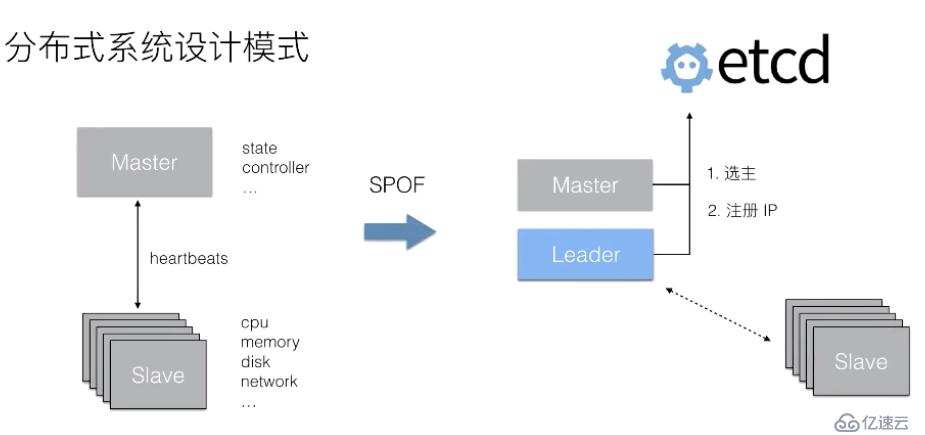

在分布式系統中,有一種典型的設計模式就是 Master+Slave。通常情況下,Slave 提供了 CPU、內存、磁盤以及網絡等各種資源 ,而 Master 用來調和這些節點以使其對外提供一個服務(比如分布式存儲,分布式計算)。典型的分布式存儲服務(HDFS)以及分布式計算服務(Hadoop)它們都是采用了類似這樣的設計模式。這樣的設計模式會有一個典型的問題:Master 節點的可用性。當 Master 故障以后,整個集群的服務就掛掉了,沒有辦法再服務用戶的請求。

為了解決這個問題,典型的做法就是啟動多個 Master 節點。因為 Master 節點內會包含控制邏輯,多個節點之間的狀態同步是非常復雜的,這里最典型的做法就是通過選主的方式,選出其中一個節點作為主節點來提供服務,另一個節點處于等待狀態。

通過 etcd 提供的機制可以很容易的實現分布式進程的選主功能,比如可以通過對同一個 key 的事務寫來實現搶主的邏輯。一般而言,被選主的 Leader 會將自己的 IP 注冊到 etcd 中,使得 Slave 節點能夠及時獲取到當前的 Leader 地址,從而使得系統按照之前單個 Master 節點的方式繼續工作。當 Leader 節點發生異常之后,通過 etcd 能夠選取出一個新的節點成為主節點,并且注冊新的 IP 之后,Slave 又能夠拉取新的主節點的 IP,繼續恢復服務。

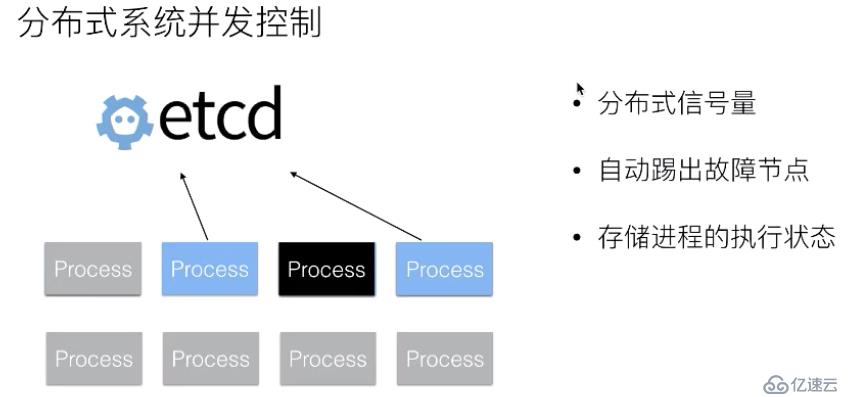

在分布式系統中,當我們去執行一些任務,比如說去升級 OS、或者說升級 OS 上的軟件的時候、又或者去執行一些計算任務的時候,出于對后端服務的瓶頸或者是業務穩定性的考慮,通常情況下需要控制任務的并發度。如果該任務缺少一個調和的 Master 節點,可以通過 etcd 來完成這樣的分布式系統工作。

在這個模式中通過 etcd 去實現一個分布式的信號量,并且可以利用 etcd leases 機制來實現自動地剔除掉故障節點。在進程執行過程中,如果進程的運行周期比較長,我們可以將進程運行過程中的一些狀態數據存儲到 etcd,從而使得當進程故障之后且需要恢復到其他地方時,能夠從 etcd 中去恢復一些執行狀態,而不需要重新去完成整個的計算邏輯,以此來加速整個任務的執行效率。

本文分享的主要內容就到此為止了,這里為大家簡單總結一下:

“ 阿里巴巴云原生微信公眾號(ID:Alicloudnative)關注微服務、Serverless、容器、Service Mesh等技術領域、聚焦云原生流行技術趨勢、云原生大規模的落地實踐,做最懂云原生開發者的技術公眾號。”

?

免責聲明:本站發布的內容(圖片、視頻和文字)以原創、轉載和分享為主,文章觀點不代表本網站立場,如果涉及侵權請聯系站長郵箱:is@yisu.com進行舉報,并提供相關證據,一經查實,將立刻刪除涉嫌侵權內容。