您好,登錄后才能下訂單哦!

您好,登錄后才能下訂單哦!

這期內容當中小編將會給大家帶來有關如何用python和OpenCV制作目標檢測功能,文章內容豐富且以專業的角度為大家分析和敘述,閱讀完這篇文章希望大家可以有所收獲。

環境安裝

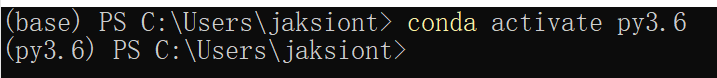

conda create -n py3.6 python=3.6 //創建 conda activate py3.6 //激活

3.安裝依賴numpy和imutils

//用鏡像安裝 pip install -i https://pypi.tuna.tsinghua.edu.cn/simple numpy pip install -i https://pypi.tuna.tsinghua.edu.cn/simple imutils

4.安裝opencv

(1)首先下載opencv(網址:opencv),在這里我選擇的是opencv_python‑4.1.2+contrib‑cp36‑cp36m‑win_amd64.whl 。

(2)下載好后,把它放到任意盤中(這里我放的是D盤),切換到安裝目錄,執行安裝命令:pip install opencv_python‑4.1.2+contrib‑cp36‑cp36m‑win_amd64.whl

代碼

首先打開一個空文件命名為real_time_object_detection.py,加入以下代碼,導入你所需要的包。

# import the necessary packages from imutils.video import VideoStream from imutils.video import FPS import numpy as np import argparse import imutils import time import cv2

2.我們不需要圖像參數,因為在這里我們處理的是視頻流和視頻——除了以下參數保持不變:

–prototxt:Caffe prototxt 文件路徑。

–model:預訓練模型的路徑。

–confidence:過濾弱檢測的最小概率閾值,默認值為 20%。

# construct the argument parse and parse the arguments

ap = argparse.ArgumentParser()

ap.add_argument("-p", "--prototxt", required=True,

help="path to Caffe 'deploy' prototxt file")

ap.add_argument("-m", "--model", required=True,

help="path to Caffe pre-trained model")

ap.add_argument("-c", "--confidence", type=float, default=0.2,

help="minimum probability to filter weak detections")

args = vars(ap.parse_args())3.初始化類列表和顏色集,我們初始化 CLASS 標簽,和相應的隨機 COLORS。

# initialize the list of class labels MobileNet SSD was trained to # detect, then generate a set of bounding box colors for each class CLASSES = ["background", "aeroplane", "bicycle", "bird", "boat", "bottle", "bus", "car", "cat", "chair", "cow", "diningtable", "dog", "horse", "motorbike", "person", "pottedplant", "sheep", "sofa", "train", "tvmonitor"] COLORS = np.random.uniform(0, 255, size=(len(CLASSES), 3))

4.加載自己的模型,并設置自己的視頻流。

# load our serialized model from disk

print("[INFO] loading model...")

net = cv2.dnn.readNetFromCaffe(args["prototxt"], args["model"])

# initialize the video stream, allow the cammera sensor to warmup,

# and initialize the FPS counter

print("[INFO] starting video stream...")

vs = VideoStream(src=0).start()

time.sleep(2.0)

fps = FPS().start()首先我們加載自己的序列化模型,并且提供對自己的 prototxt文件 和模型文件的引用net = cv2.dnn.readNetFromCaffe(args["prototxt"], args["model"])。

下一步,我們初始化視頻流(來源可以是視頻文件或攝像頭)。首先,我們啟動 VideoStreamvs = VideoStream(src=0).start(),隨后等待相機啟動time.sleep(2.0),最后開始每秒幀數計算fps = FPS().start()。VideoStream 和 FPS 類是 imutils 包的一部分。

5.遍歷每一幀

# loop over the frames from the video stream while True: # grab the frame from the threaded video stream and resize it # to have a maximum width of 400 pixels frame = vs.read() frame = imutils.resize(frame, width=400) # grab the frame from the threaded video file stream (h, w) = frame.shape[:2] blob = cv2.dnn.blobFromImage(cv2.resize(frame, (300, 300)), 0.007843, (300, 300), 127.5) # pass the blob through the network and obtain the detections and # predictions net.setInput(blob) detections = net.forward()

首先,從視頻流中讀取一幀frame = vs.read(),隨后調整它的大小imutils.resize(frame, width=400)。由于我們隨后會需要寬度和高度,接著進行抓取(h, w) = frame.shape[:2]。最后將 frame 轉換為一個有 dnn 模塊的 blob,cv2.dnn.blobFromImage(cv2.resize(frame, (300, 300)),0.007843, (300, 300), 127.5)。

現在,我們設置 blob 為神經網絡的輸入net.setInput(blob),通過 net 傳遞輸入detections = net.forward()。

6.這時,我們已經在輸入幀中檢測到了目標,現在看看置信度的值,來判斷我們能否在目標周圍繪制邊界框和標簽。

# loop over the detections

for i in np.arange(0, detections.shape[2]):

# extract the confidence (i.e., probability) associated with

# the prediction

confidence = detections[0, 0, i, 2]

# filter out weak detections by ensuring the `confidence` is

# greater than the minimum confidence

if confidence > args["confidence"]:

# extract the index of the class label from the

# `detections`, then compute the (x, y)-coordinates of

# the bounding box for the object

idx = int(detections[0, 0, i, 1])

box = detections[0, 0, i, 3:7] * np.array([w, h, w, h])

(startX, startY, endX, endY) = box.astype("int")

# draw the prediction on the frame

label = "{}: {:.2f}%".format(CLASSES[idx],

confidence * 100)

cv2.rectangle(frame, (startX, startY), (endX, endY),

COLORS[idx], 2)

y = startY - 15 if startY - 15 > 15 else startY + 15

cv2.putText(frame, label, (startX, y),

cv2.FONT_HERSHEY_SIMPLEX, 0.5, COLORS[idx], 2)在 detections 內循環,一個圖像中可以檢測到多個目標。因此我們需要檢查置信度。如果置信度足夠高(高于閾值),那么將在終端展示預測,并以文本和彩色邊界框的形式對圖像作出預測。

在 detections 內循環,首先我們提取 confidence 值,confidence = detections[0, 0, i, 2]。如果 confidence 高于最低閾值(if confidence > args["confidence"]:),那么提取類標簽索引(idx = int(detections[0, 0, i, 1])),并計算檢測到的目標的坐標(box = detections[0, 0, i, 3:7] * np.array([w, h, w, h]))。然后,我們提取邊界框的 (x, y) 坐標((startX, startY, endX, endY) = box.astype("int")),將用于繪制矩形和文本。接著構建一個文本 label,包含 CLASS 名稱和 confidence(label = "{}: {:.2f}%".format(CLASSES[idx],confidence * 100))。還要使用類顏色和之前提取的 (x, y) 坐標在物體周圍繪制彩色矩形(cv2.rectangle(frame, (startX, startY), (endX, endY),COLORS[idx], 2))。如果我們希望標簽出現在矩形上方,但是如果沒有空間,我們將在矩形頂部稍下的位置展示標簽(y = startY - 15 if startY - 15 > 15 else startY + 15)。最后,我們使用剛才計算出的 y 值將彩色文本置于幀上(cv2.putText(frame, label, (startX, y),cv2.FONT_HERSHEY_SIMPLEX, 0.5, COLORS[idx], 2))。

7.幀捕捉循環剩余的步驟還包括:展示幀;檢查 quit 鍵;更新 fps 計數器。

# show the output frame

cv2.imshow("Frame", frame)

key = cv2.waitKey(1) & 0xFF

# if the `q` key was pressed, break from the loop

if key == ord("q"):

break

# update the FPS counter

fps.update()上述代碼塊簡單明了,首先我們展示幀(cv2.imshow("Frame", frame)),然后找到特定按鍵(key = cv2.waitKey(1) & 0xFF),同時檢查「q」鍵(代表「quit」)是否按下。如果已經按下,則我們退出幀捕捉循環(if key == ord("q"):break),最后更新 fps 計數器(fps.update())。

8.退出了循環(「q」鍵或視頻流結束),我們還要處理以下。

# stop the timer and display FPS information

fps.stop()

print("[INFO] elapsed time: {:.2f}".format(fps.elapsed()))

print("[INFO] approx. FPS: {:.2f}".format(fps.fps()))

# do a bit of cleanup

cv2.destroyAllWindows()

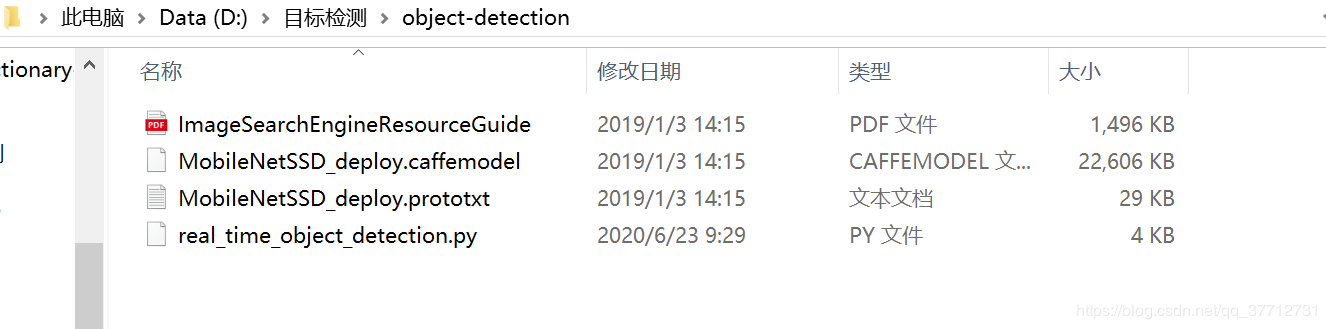

vs.stop()運行文件目錄有以下文件:

到文件相應的目錄下:cd D:\目標檢測\object-detection執行命令:python real_time_object_detection.py --prototxt MobileNetSSD_deploy.prototxt.txt --model MobileNetSSD_deploy.caffemodel

補充

項目github地址object_detection鏈接。

本項目要用到MobileNetSSD_deploy.prototxt.txt和MobileNetSSD_deploy.caffemodel,可以去github上下載項目運行。

上述就是小編為大家分享的如何用python和OpenCV制作目標檢測功能了,如果剛好有類似的疑惑,不妨參照上述分析進行理解。如果想知道更多相關知識,歡迎關注億速云行業資訊頻道。

免責聲明:本站發布的內容(圖片、視頻和文字)以原創、轉載和分享為主,文章觀點不代表本網站立場,如果涉及侵權請聯系站長郵箱:is@yisu.com進行舉報,并提供相關證據,一經查實,將立刻刪除涉嫌侵權內容。