您好,登錄后才能下訂單哦!

您好,登錄后才能下訂單哦!

小編給大家分享一下Python爬蟲中流程框架和常用模塊是什么,相信大部分人都還不怎么了解,因此分享這篇文章給大家參考一下,希望大家閱讀完這篇文章后大有收獲,下面讓我們一起去了解一下吧!

一、簡單爬蟲架構

首先學習爬蟲之前呢,要知道爬蟲的一個基本架構,也就是寫代碼得有層次結構吧?不然擠牙膏么?

爬蟲調度器 -> URL管理器 -> 網頁下載器() -> 網頁解析器() -> 價值數據

其中最重要地方,莫過于三君子-管理,下載,解析器。

這就是個初代版本的簡單爬蟲架構,一個基本的架構。

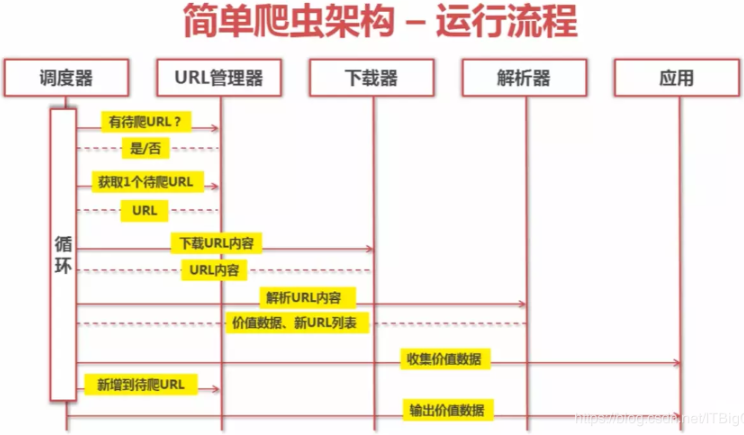

二、運行流程

實際上對于一些有開發基礎的人來看,這個東西已經一目了然了,具體內容我不說了。

具體過程:(細品,你細品~)

1、調度器詢問URL管理器,是否有待爬URL?URL管理器返回是/否?

2、如果是,調度器會從URL管理器中取出一個待爬URL;

3、調度器將URL傳給下載器,下載網頁內容后返回給調度器;

4、調度器再將返回的網頁內容發送到解析器,解析URL內容,解析完成后返回有價值的數據和新的URL;

5、一方面,調度器將數據傳遞給應用進行數據的收集;另一方面,會將新的URL補充進URL管理器,若有URL管理器中含有新的URL,則重復上述步驟,直到爬取完所有的URL

6、最后,調度器會調動應用的方法,將價值數據輸出到需要的格式。

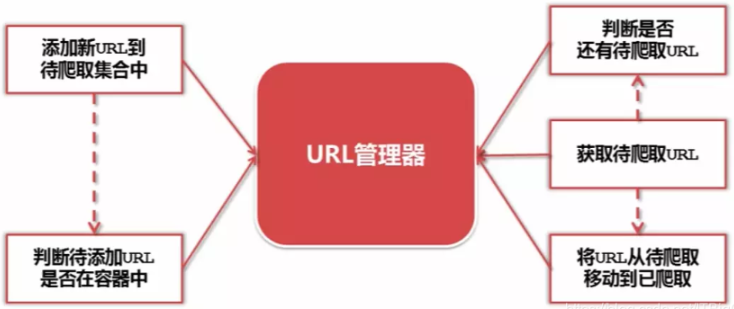

三、URL管理器和實現方法

定義:管理帶抓取URL集合和已抓取URL集合,

作用:防止重復抓取、防止循環抓取

URL管理器功能:

支持的功能

添加新URL到待爬取集合中

判斷待添加的URL是否在容器中

判斷是否還有帶待爬取URL

獲取待爬取URL

將URL從待爬取移動到已爬取

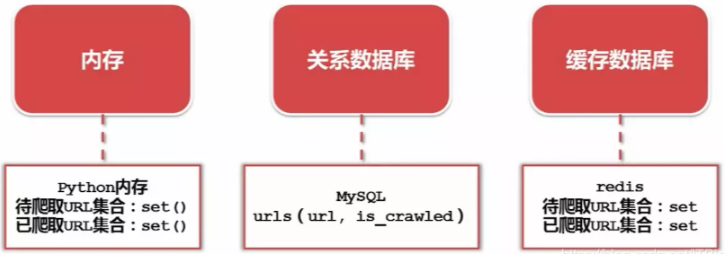

實現方式

1、適合個人的:內存(計算機或服務器內存)

2、小型企業或個人:關系數據庫(永久存儲或內存不夠用,如 MySQL)

3、大型互聯網公司:緩存數據庫(高性能,如支持 set() 的 redis)

四、網頁下載器和urllib2模塊

將互聯網上URL對應的網頁下載到本地的工具。

作用:網頁下載器類似于瀏覽器,會將互聯網對應的網頁以HTML的形式下載到本地,存儲成本地文件或內存字符串,然后進行后續的分析。

Python的網頁下載器種類

urllib / urllib2 (Python官方提供的基礎模塊)

requests(第三方插件,提供更為強大的功能)

(注意:python 3.x 以上版本把urllib2 和 urllib 整合到一起。所以引入模塊變成一個,只有 import urllib,以后你在python2中看到的urllib2在python3中用urllib.request替換~ )

舉例:

#py2 import urllib2 response = urllib2.urlopen(url) # 報錯NameError: name 'urllib2' is not defined,要改為 # py3 import urllib.request response = urllib.request.urlopen(url)

個人覺得Urllib庫不好用,requests庫更好用。

urllib2抓取網頁的三種方法(以后用requests)

當然,雖然urllib2用的要少一些了,但是還是要了解一下的

方法1:給定url,使用urllib 模塊的urlopen方法獲取網頁內容

舉例:

這里我用的python3.x版本的urllib庫。

get請求:發送一個GET請求到指定的頁面,然后返回HTTP的響應。

from urllib import request

print('第一種方法get請求')

url = 'http://www.baidu.com'

# 直接請求

response = request.urlopen(url)

# 獲取狀態碼,如果是200表示成功

print(response.status)

# 讀取網頁內容

print(response.read().decode('utf-8')因為read獲取到的byte編碼,改為decode(‘utf-8’)。

方法2:添加data,http header

模擬瀏覽器發送GET請求,就需要使用Request對象,通過往Request對象添加HTTP頭,我們就可以把請求偽裝成瀏覽器進行訪問:

User-Agent 有些 Server 或 Proxy 會檢查該值,用來判斷是否是瀏覽器發起的 Request .Content-Type

在使用 REST 接口時,Server 會檢查該值,用來確定 HTTP Body 中的內容該怎樣解析。

添加頭信息舉例:

import urllib2

print "第二種方法"

from urllib import request

req = request.Request('http://www.baidu.com')

req.add_header('User-Agent', 'Mozilla/6.0')

response = request.urlopen(req)

# 獲取狀態碼,如果是200表示成功

print(response.status)

# 讀取網頁內容

print(response.read().decode('utf-8'))方法3:添加特殊情景的處理器

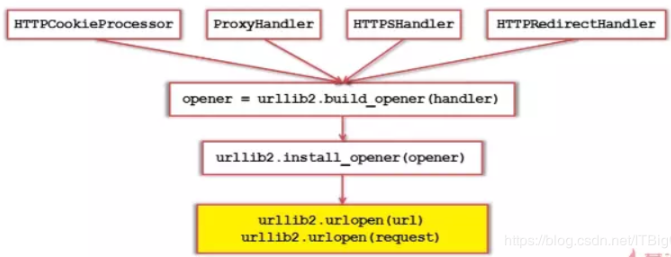

模擬瀏覽器發送POST請求。

需要登錄才能訪問的網頁,要添加cookie的處理。使用HTTPCookieProcessor;

需要代理才能訪問的網頁使用ProxyHandler;

需要HTTPS加密訪問的網站使用HTTPSHandler;

有些URL存在相互自動跳轉的關系使用HTTPRedirectHandler進行處理。

圖示:

HTTPCookieProcessor的使用:

cookie中保存中我們常見的登錄信息,有時候爬取網站需要攜帶cookie信息訪問,這里用到了http.cookijar,用于獲取cookie以及存儲cookie,同時cookie可以寫入到文件中保存,一般有兩種方式http.cookiejar.MozillaCookieJar和http.cookiejar.LWPCookieJar()。

舉例:

import urllib2, cookielib

print "第三種方法"

# 創建cookie容器

cj = cookielib.CookieJar()

# 創建1個opener

opener = urllib2.build_opener(urllib2.HTTPCookieProcessor(cj))

# 給urllib2安裝opener

urllib2.install_opener(opener)

# 使用帶有cookie的urllib2訪問網頁

response = urllib2.urlopen('http://www.baidu.com/')上面都是對urllib2模塊來寫的,但是實戰中往往用requests,這個放到后面文章來說。

注意: python3用cookielib 模塊改名為 http.cookiejar,帶cookie的打印出來必須用opener.open(req).read().decode(‘utf-8’)來發送的請求才會帶上cookie,如果用urllib.request.urlopen()是不帶cookie的。

ProxyHandler代理的使用:

網站它會檢測某一段時間某個IP 的訪問次數,如果訪問次數過多,它會禁止你的訪問,所以這個時候需要通過設置代理來爬取數據

import urllib.request

url = 'http://www.baidu.com'

proxy_handler = urllib.request.ProxyHandler({

#代理服務器IP地址

'http': 'http://111.13.100.91:80',

'https': 'https://111.13.100.91:443'

})

opener = urllib.request.build_opener(proxy_handler)

response = opener.open(url)

# 獲取狀態碼,如果是200表示成功

print(response.status)

# 讀取網頁內容

print(response.read().decode('utf-8'))四、網頁解析器和使用

網頁解析器從HTML網頁字符串中提取出價值數據和新URL對象

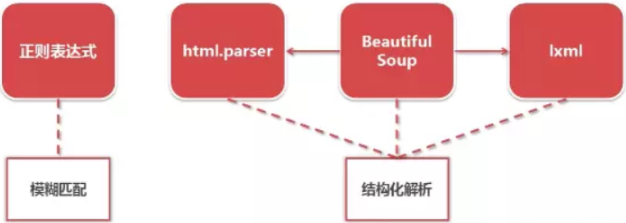

Python網頁解析器種類

正則表達式(re模糊匹配)

html.parser (Python自帶)

BeautifulSoup (第三方插件)

lxml (第三方解析器)

后面三種是以結構化解析的方式進行解析DOM(Document Object Model)樹,

【也就是按照html的節點路徑一級一級來解析的。】

下面挨個介紹一下最常用的兩個。

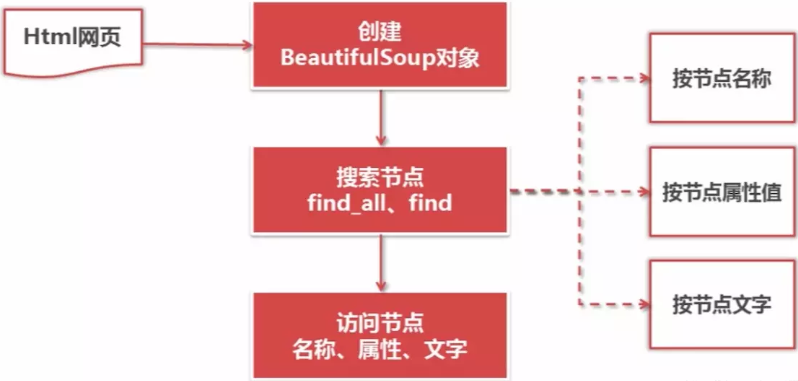

常用的BeautifulSoup介紹!!!

bs4主要使用find()方法和find_all()方法來搜索文檔。

find()用來搜索單一數據,find_all()用來搜索多個數據。

它是Python第三方庫,用于從HTML或XML中提取數據

官網:https://www.crummy.com/software/BeautifulSoup/

中文文檔:https://www.crummy.com/software/BeautifulSoup/bs4/doc/index.zh.html

需要安裝和測試:

方法一,在cmd窗口中:

安裝:pip install beautifulsoup4 測試:import bs4

方法2:在pycharm中:File–settings–Project Interpreter–添加beautifulsoup4(簡寫bs4)

語法:

舉個例子:

from bs4 import BeautifulSoup

# 根據HTML網頁字符串創建BeautifulSoup對象

soup = BeautifulSoup(html_doc, 'html.parser', from_encoding='utf-8')

# 搜索節點 查找所有標簽為a的節點

soup.find_all('a')

# 查找所有標簽為a,連接符合/view/123.html形式的節點

soup.find_all('a', href='/view/123.html')

soup.find_all('a', href=re.compile(r'/view/\d+\.html'))

# 查找所有標簽為div,class為abc,文字為Python的節點

soup.find_all('div', class_='abc', string='Python')訪問節點信息

# 舉例節點:<a href='1.html'>Python</a> # 獲取查找到的節點的標簽名稱 node.name # 獲取查找到的a節點的href屬性 node['href'] # 獲取查找到的a節點的鏈接文字 node.get_text()

上面就是bs4在解析模塊的相關使用,更多方式查看官方文檔即可。

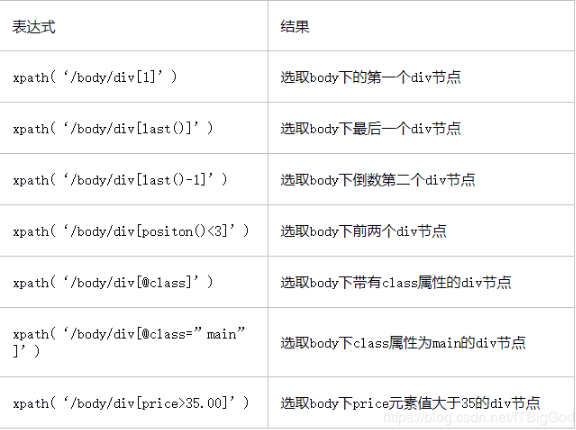

常用的lxml介紹

Xpath是一門在XML文檔中查找信息的語言。Xpath可用來在XML文檔中對元素和屬性進行遍歷。Xpath是W3C XSLT標準的主要元素,并且XQuery和XPointer都構建于XPath表達之上。

安裝:

pip install lxml

語法:

選取節點

XPath 使用路徑表達式在 XML 文檔中選取節點。節點是通過沿著路徑或者 step 來選取的。

在使用 xpath之前,先導入 etree類,對原始的 html頁面進行處理獲得一個_Element對象。

舉個例子:

#導入 etree類

from lxml import etree

# html文本

html = '''<div class="container">

<div class="row">

<div class="col">

<div class="card">

<div class="card-content">

<a href="#123333" class="box">

好麻煩喲!!!~~~

</a>

</div>

</div>

</div>

</div>

</div>'''

#對 html文本進行處理 獲得一個_Element對象

dom = etree.HTML(html)

#獲取 a標簽下的文本

a_text = dom.xpath('//div/div/div/div/div/a/text()')

print(a_text)我們通過 etree.HTML( )來生成一個_Element對象,etree.HTML() 會將傳入的文本處理成一個 html文檔節點。這樣就能保證我們總是能獲得一個包含文檔節點的_Element對象。

以上是Python爬蟲中流程框架和常用模塊是什么的所有內容,感謝各位的閱讀!相信大家都有了一定的了解,希望分享的內容對大家有所幫助,如果還想學習更多知識,歡迎關注億速云行業資訊頻道!

免責聲明:本站發布的內容(圖片、視頻和文字)以原創、轉載和分享為主,文章觀點不代表本網站立場,如果涉及侵權請聯系站長郵箱:is@yisu.com進行舉報,并提供相關證據,一經查實,將立刻刪除涉嫌侵權內容。