您好,登錄后才能下訂單哦!

您好,登錄后才能下訂單哦!

selenium如何 在python中使用?針對這個問題,這篇文章詳細介紹了相對應的分析和解答,希望可以幫助更多想解決這個問題的小伙伴找到更簡單易行的方法。

python的五大特點:1.簡單易學,開發程序時,專注的是解決問題,而不是搞明白語言本身。2.面向對象,與其他主要的語言如C++和Java相比, Python以一種非常強大又簡單的方式實現面向對象編程。3.可移植性,Python程序無需修改就可以在各種平臺上運行。4.解釋性,Python語言寫的程序不需要編譯成二進制代碼,可以直接從源代碼運行程序。5.開源,Python是 FLOSS(自由/開放源碼軟件)之一。

1.案例分析:

- 需求:爬取網易新聞的國內、國際、軍事、無人機板塊下的新聞數據

- 需求分析:當點擊國內超鏈進入國內對應的頁面時,會發現當前頁面展示的新聞數據是被動態加載出來的,如果直接通過程序對url進行請求,是獲取不到動態加載出的新聞數據的。則需要我們使用selenium實例化一個瀏覽器對象,在該對象中進行url的請求,獲取動態加載的新聞數據。

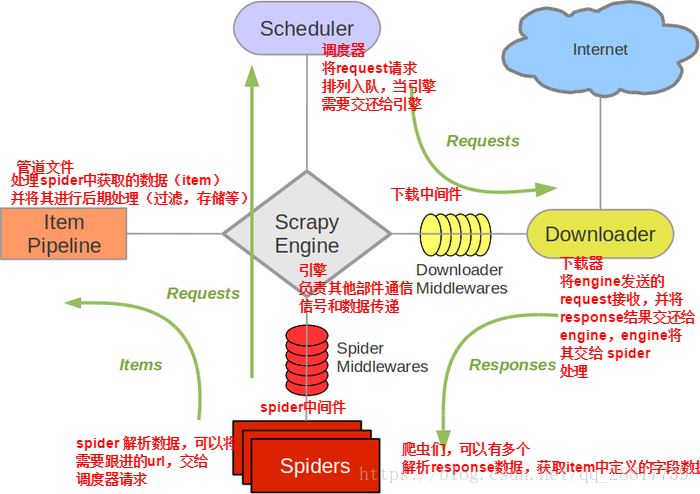

2.selenium在scrapy中使用的原理分析:

當引擎將國內板塊url對應的請求提交給下載器后,下載器進行網頁數據的下載,然后將下載到的頁面數據,封裝到response中,提交給引擎,引擎將response再轉交給Spiders。Spiders接受到的response對象中存儲的頁面數據里是沒有動態加載的新聞數據的。要想獲取動態加載的新聞數據,則需要在下載中間件中對下載器提交給引擎的response響應對象進行攔截,切對其內部存儲的頁面數據進行篡改,修改成攜帶了動態加載出的新聞數據,然后將被篡改的response對象最終交給Spiders進行解析操作。

3.selenium在scrapy中的使用流程:

重寫爬蟲文件的構造方法,在該方法中使用selenium實例化一個瀏覽器對象(因為瀏覽器對象只需要被實例化一次)

重寫爬蟲文件的closed(self,spider)方法,在其內部關閉瀏覽器對象。該方法是在爬蟲結束時被調用

重寫下載中間件的process_response方法,讓該方法對響應對象進行攔截,并篡改response中存儲的頁面數據

在配置文件中開啟下載中間件

4.實例:

# 1.spider文件

import scrapy

from wangyiPro.items import WangyiproItem

from selenium import webdriver

class WangyiSpider(scrapy.Spider):

name = 'wangyi'

# allowed_domains = ['www.xxx.con']

start_urls = ['https://news.163.com/']

# 瀏覽器實例化的操作只會被執行一次

bro = webdriver.Chrome(executable_path='chromedriver.exe')

urls = []# 最終存放的就是5個板塊對應的url

def parse(self, response):

li_list = response.xpath('//*[@id="index2016_wrap"]/div[1]/div[2]/div[2]/div[2]/div[2]/div/ul/li')

for index in [3,4,6,7,8]:

li = li_list[index]

new_url = li.xpath('./a/@herf').extract_first()

self.urls.append(new_url)

# 對5大板塊對應的url進行請求發送

yield scrapy.Request(url=new_url,callback=self.parse_news)

# 用來解析每一個板塊對應的新聞數據【只能解析到新聞的標題】

def parse_news(self,response):

div_list = response.xpath('//div[@class="ndi_main"]/div')

for div in div_list:

title = div.xpath('./div/div[1]/h4/a/text()').extract_first()

news_detail_url = div.xpath('./div/div[1]/h4/a/@href').extract_first()

# 實例化item對象,將解析到的標題和內容存儲到item對象中

item = WangyiproItem()

item['title'] = title

# 對詳情頁的url進行手動請求發送獲得新聞內容

yield scrapy.Request(url=news_detail_url,callback=self.parse_detail,meta={'item':item})

def parse_detail(self,response):

item = response.meta['item']

# 通過response解析出新聞內容

content = response.xpath('//div[@id="endText"]//text()').extract()

content = ''.join(content)

item['content'] = content

yield item

def close(self,spider):

# 當爬蟲結束之后,調用關閉瀏覽器方法

print('爬蟲整體結束~~~~~~~~~~~~~~~~~~~')

self.bro.quit()

----------------------------------------------------------------------------------------

# 2.items文件

import scrapy

class WangyiproItem(scrapy.Item):

# define the fields for your item here like:

# name = scrapy.Field()

title = scrapy.Field()

content = scrapy.Field()

----------------------------------------------------------------------------------------

# 3.middlewares文件

from scrapy import signals

from scrapy.http import HtmlResponse

from time import sleep

class WangyiproDownloaderMiddleware(object):

def process_request(self, request, spider):

return None

def process_response(self, request, response, spider):

# 判斷哪些響應對象是5個板塊的,如果在就對響應對象進行處理

if response.url in spider.urls:

# 獲取在爬蟲類中定義好的瀏覽器

bro = spider.bro

bro.get(response.url)

bro.execute_script('window.scrollTo(0,document.body.scrollHeight)')

sleep(1)

bro.execute_script('window.scrollTo(0,document.body.scrollHeight)')

sleep(1)

bro.execute_script('window.scrollTo(0,document.body.scrollHeight)')

sleep(1)

bro.execute_script('window.scrollTo(0,document.body.scrollHeight)')

sleep(1)

# 獲取攜帶了新聞數據的頁面源碼數據

page_text = bro.page_source

# 實例化一個新的響應對象

new_response = HtmlResponse(url=response.url,body=page_text,encoding='utf-8',request=request)

return new_response

else:

return response

def process_exception(self, request, exception, spider):

pass

----------------------------------------------------------------------------------------

# 4.pipelines文件

class WangyiproPipeline(object):

def process_item(self, item, spider):

print(item)

return item

----------------------------------------------------------------------------------------

# 5.setting文件

BOT_NAME = 'wangyiPro'

SPIDER_MODULES = ['wangyiPro.spiders']

NEWSPIDER_MODULE = 'wangyiPro.spiders'

USER_AGENT = 'Mozilla/5.0 (Windows NT 10.0; Win64; x64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/76.0.3809.132 Safari/537.36'

ROBOTSTXT_OBEY = False

DOWNLOADER_MIDDLEWARES = {

'wangyiPro.middlewares.WangyiproDownloaderMiddleware': 543,

}

ITEM_PIPELINES = {

'wangyiPro.pipelines.WangyiproPipeline': 300,

}

LOG_LEVEL = 'ERROR'關于selenium如何 在python中使用問題的解答就分享到這里了,希望以上內容可以對大家有一定的幫助,如果你還有很多疑惑沒有解開,可以關注億速云行業資訊頻道了解更多相關知識。

免責聲明:本站發布的內容(圖片、視頻和文字)以原創、轉載和分享為主,文章觀點不代表本網站立場,如果涉及侵權請聯系站長郵箱:is@yisu.com進行舉報,并提供相關證據,一經查實,將立刻刪除涉嫌侵權內容。